Depth-Anything-V2

单目深度估计新突破,高精度与快速推理并重

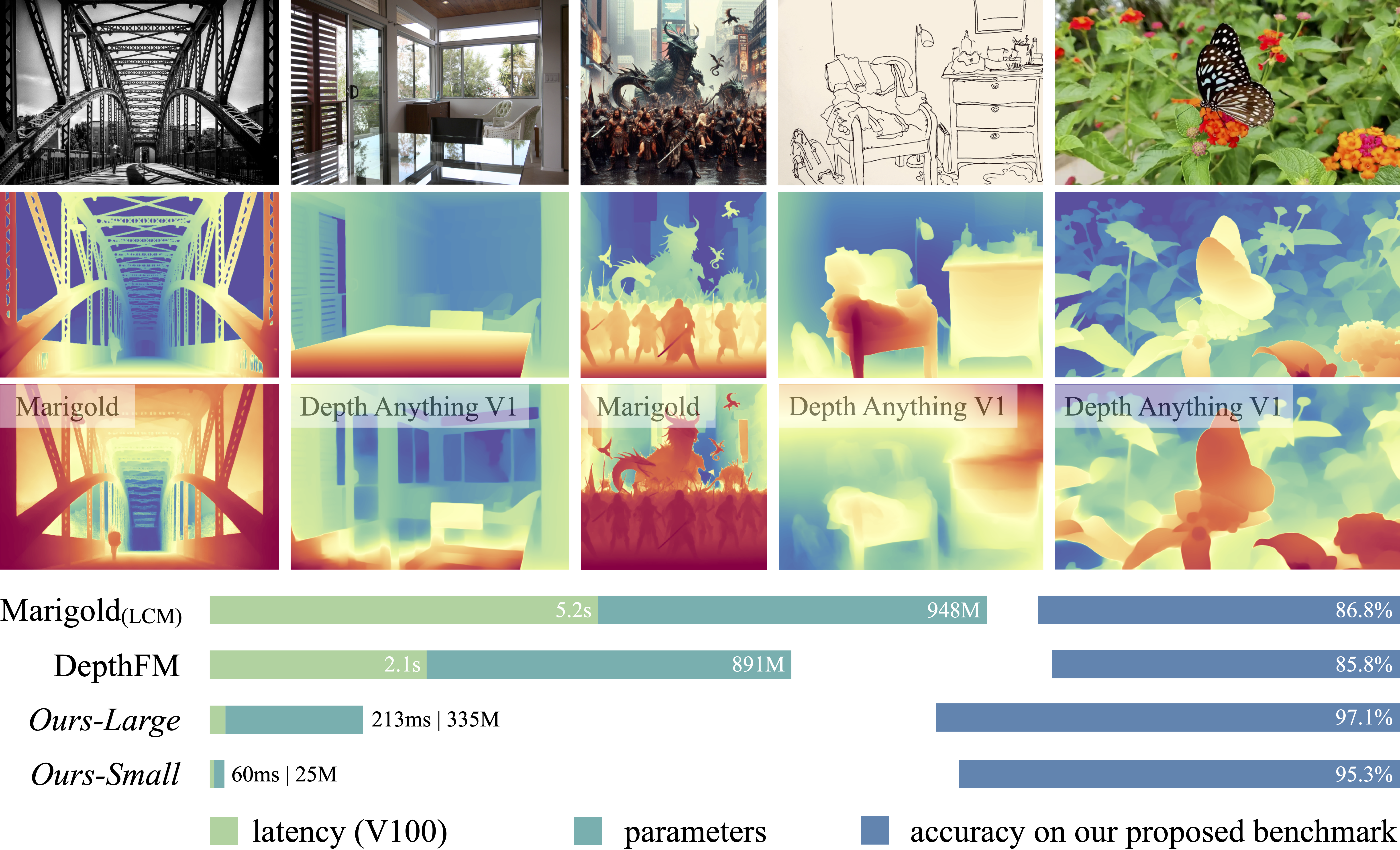

Depth-Anything-V2是单目深度估计领域的新进展。该模型在细节表现和鲁棒性上显著优于V1版本,并在推理速度、参数量和深度精度方面超越了基于SD的模型。项目提供四种预训练模型,适用于相对和度量深度估计,可处理图像和视频。此外,发布的DA-2K基准为深度估计研究设立了新标准。

杨理赫<sup>1</sup> · 康冰毅<sup>2†</sup> · 黄子龙<sup>2</sup> <br> 赵震 · 徐晓刚 · 冯佳时<sup>2</sup> · 赵恒双<sup>1*</sup>

<sup>1</sup>香港大学 <sup>2</sup>字节跳动 <br> †项目负责人 *通讯作者

<a href="https://arxiv.org/abs/2406.09414"><img src='https://img.shields.io/badge/arXiv-Depth Anything V2-red' alt='论文PDF'></a> <a href='https://depth-anything-v2.github.io'><img src='https://img.shields.io/badge/项目主页-Depth Anything V2-green' alt='项目主页'></a> <a href='https://huggingface.co/spaces/depth-anything/Depth-Anything-V2'><img src='https://img.shields.io/badge/%F0%9F%A4%97%20Hugging%20Face-演示-blue'></a> <a href='https://huggingface.co/datasets/depth-anything/DA-2K'><img src='https://img.shields.io/badge/基准测试-DA--2K-yellow' alt='基准测试'></a>

</div>本文介绍了Depth Anything V2。与V1相比,它在细节处理和鲁棒性方面有显著提升。相比于基于SD的模型,它具有更快的推理速度、更少的参数量和更高的深度精度。

新闻

- 2024年7月6日: Depth Anything V2已在Transformers中得到支持。请参阅使用说明以方便使用。

- 2024年6月25日: Depth Anything已集成到Apple Core ML Models中。请参阅使用说明(V1,V2)。

- 2024年6月22日: 我们发布了基于Depth-Anything-V2-Small和Base的较小的度量深度模型。

- 2024年6月20日: 我们的仓库和项目页面被GitHub标记并从公众视野中移除了6天。对此造成的不便我们深表歉意。

- 2024年6月14日: 论文、项目页面、代码、模型、演示和基准测试全部发布。

预训练模型

我们提供了四个不同规模的模型用于稳健的相对深度估计:

| 模型 | 参数量 | 检查点 |

|---|---|---|

| Depth-Anything-V2-Small | 24.8M | 下载 |

| Depth-Anything-V2-Base | 97.5M | 下载 |

| Depth-Anything-V2-Large | 335.3M | 下载 |

| Depth-Anything-V2-Giant | 1.3B | 即将推出 |

使用方法

准备工作

git clone https://github.com/DepthAnything/Depth-Anything-V2 cd Depth-Anything-V2 pip install -r requirements.txt

下载这里列出的检查点并将它们放在checkpoints目录下。

使用我们的模型

import cv2 import torch from depth_anything_v2.dpt import DepthAnythingV2 DEVICE = 'cuda' if torch.cuda.is_available() else 'mps' if torch.backends.mps.is_available() else 'cpu' model_configs = { 'vits': {'encoder': 'vits', 'features': 64, 'out_channels': [48, 96, 192, 384]}, 'vitb': {'encoder': 'vitb', 'features': 128, 'out_channels': [96, 192, 384, 768]}, 'vitl': {'encoder': 'vitl', 'features': 256, 'out_channels': [256, 512, 1024, 1024]}, 'vitg': {'encoder': 'vitg', 'features': 384, 'out_channels': [1536, 1536, 1536, 1536]} } encoder = 'vitl' # 或 'vits', 'vitb', 'vitg' model = DepthAnythingV2(**model_configs[encoder]) model.load_state_dict(torch.load(f'checkpoints/depth_anything_v2_{encoder}.pth', map_location='cpu')) model = model.to(DEVICE).eval() raw_img = cv2.imread('你的图像路径') depth = model.infer_image(raw_img) # HxW 原始深度图(numpy格式)

如果你不想克隆这个仓库,你也可以通过Transformers加载我们的模型。以下是一个简单的代码片段。更多详情请参考官方页面。

- 注意1:确保你能连接到Hugging Face并已安装最新版的Transformers。

- 注意2:由于OpenCV(我们使用的)和Pillow(HF使用的)之间的上采样差异,预测结果可能会略有不同。因此,我们更推荐你通过上面介绍的方式使用我们的模型。

from transformers import pipeline from PIL import Image pipe = pipeline(task="depth-estimation", model="depth-anything/Depth-Anything-V2-Small-hf") image = Image.open('你的图像路径') depth = pipe(image)["depth"]

在图像上运行脚本

python run.py \ --encoder <vits | vitb | vitl | vitg> \ --img-path <路径> --outdir <输出目录> \ [--input-size <大小>] [--pred-only] [--grayscale]

选项:

--img-path: 你可以1)指向存储所有感兴趣图像的目录,2)指向单张图像,或3)指向存储所有图像路径的文本文件。--input-size(可选):默认情况下,我们使用输入大小518进行模型推理。你可以增加大小以获得更加精细的结果。--pred-only(可选):仅保存预测的深度图,不保存原始图像。--grayscale(可选):保存灰度深度图,不应用色彩调色板。

例如:

python run.py --encoder vitl --img-path assets/examples --outdir depth_vis

在视频上运行脚本

python run_video.py \ --encoder <vits | vitb | vitl | vitg> \ --video-path assets/examples_video --outdir video_depth_vis \ [--input-size <大小>] [--pred-only] [--grayscale]

我们的更大模型在视频上有更好的时间一致性。

Gradio演示

要在本地使用我们的Gradio演示:

python app.py

你也可以尝试我们的在线演示。

注意:相比V1,我们对DINOv2-DPT架构做了一个小修改(源自这个问题)。 在V1中,我们无意中使用了DINOv2最后四层的特征进行解码。在V2中,我们改为使用中间特征。尽管这个修改并未改善细节或准确性,但我们决定遵循这一常见做法。

微调到度量深度估计

请参考度量深度估计。

DA-2K评估基准

请参考DA-2K基准。

社区支持

我们衷心感谢社区对我们Depth Anything系列的所有支持。非常感谢!

- Apple Core ML:

- Transformers:

- TensorRT:

- ONNX: https://github.com/fabio-sim/Depth-Anything-ONNX

- ComfyUI: https://github.com/kijai/ComfyUI-DepthAnythingV2

- Transformers.js(网页实时深度): https://huggingface.co/spaces/Xenova/webgpu-realtime-depth-estimation

- Android:

致谢

我们衷心感谢出色的Hugging Face团队(@Pedro Cuenca、@Niels Rogge、@Merve Noyan、@Amy Roberts等)在Transformers和Apple Core ML中支持我们模型的巨大努力。

我们还要感谢DINOv2团队为我们的社区贡献了如此令人印象深刻的模型。

许可证

Depth-Anything-V2-Small模型使用Apache-2.0许可证。Depth-Anything-V2-Base/Large/Giant模型使用CC-BY-NC-4.0许可证。

引用

如果您发现这个项目有用,请考虑引用:

@article{depth_anything_v2, title={Depth Anything V2}, author={Yang, Lihe and Kang, Bingyi and Huang, Zilong and Zhao, Zhen and Xu, Xiaogang and Feng, Jiashi and Zhao, Hengshuang}, journal={arXiv:2406.09414}, year={2024} } @inproceedings{depth_anything_v1, title={Depth Anything: Unleashing the Power of Large-Scale Unlabeled Data}, author={Yang, Lihe and Kang, Bingyi and Huang, Zilong and Xu, Xiaogang and Feng, Jiashi and Zhao, Hengshuang}, booktitle={CVPR}, year={2024} }

编辑推荐精选

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

Refly.AI

最适合小白的AI自动化工作流平台

无需编码,轻松生成可复用、可变现的AI自动化工作流

酷表ChatExcel

大模型驱动的Excel数据处理工具

基于大模型交互的表格处理系统,允许用户通过对话方式完成数据整理和可视化分析。系统采用机器学习算法解析用户指令,自动执行排序、公式计算和数据透视等操作,支持多种文件格式导入导出。数据处理响应速度保持在0.8秒以内,支持超过100万行数据的即时分析。

TRAE编程

AI辅助编程,代码自动修复

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

AIWritePaper论文写作

AI论文写作指导平台

AIWritePaper论文写作是一站式AI论文写作辅助工具,简化了选题、文献检索至论文撰写的整个过程。通过简单设定,平台可快速生成高质量论文大纲和全文,配合图表、参考文献等一应俱全,同时提供开题报告和答辩PPT等增值服务,保障数据安全,有效提升写作效率和论文质量。

博思AIPPT

AI一键生成PPT,就用博思AIPPT!

博思AIPPT,新一代的AI生成PPT平台,支持智能生成PPT、AI美化PPT、文本&链接生成PPT、导入Word/PDF/Markdown文档生成PPT等,内置海量精美PPT模板,涵盖商务、教育、科技等不同风格,同时针对每个页面提供多种版式,一键自适应切换,完美适配各种办公场景。

潮际好麦

AI赋能电商视觉革命,一站式智能商拍平台

潮际好麦深耕服装行业,是国内AI试衣效果最好的软件。使用先进AIGC能力为电商卖家批量提供优质的、低成本的商拍图。合作品牌有Shein、Lazada、安踏、百丽等65个国内外头部品牌,以及国内10万+淘宝、天猫、京东等主流平台的品牌商家,为卖家节省将近85%的出图成本,提升约3倍出图效率,让品牌能够快速上架。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号