视觉语言模型(VLM)在视觉任务中的应用:综述与展望

引言

近年来,视觉语言模型(Vision-Language Models, VLMs)在计算机视觉领域引起了广泛关注。VLMs通过学习图像和文本之间的关联,可以实现零样本预测,在多种视觉任务上取得了令人瞩目的成果。本文将对VLMs在视觉任务中的应用进行全面综述,包括VLM的预训练方法、迁移学习方法和知识蒸馏方法,并对未来研究方向进行展望。

VLM预训练方法

VLM的预训练通常采用大规模的图文对数据集,主要包括以下三类方法:

对比学习预训练

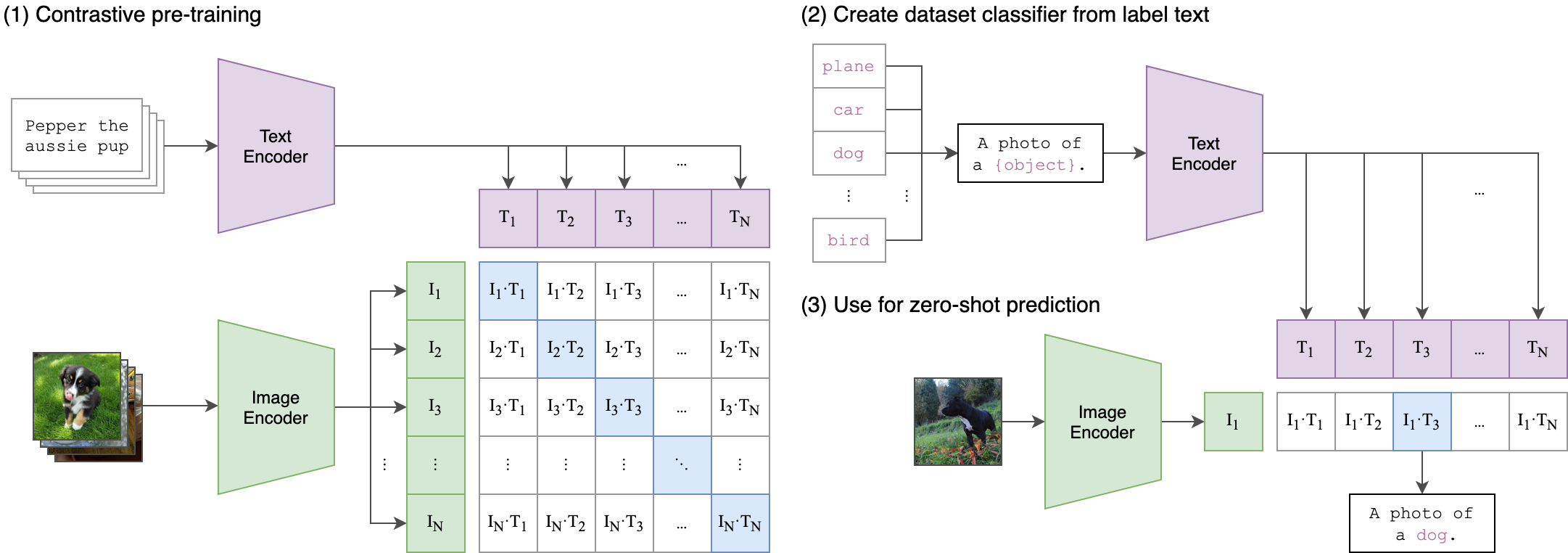

对比学习是VLM预训练的主流方法之一。其核心思想是最大化匹配的图文对的相似度,同时最小化不匹配图文对的相似度。代表性工作包括:

-

CLIP (Contrastive Language-Image Pre-training): 使用4亿个图文对进行预训练,在多个下游任务上实现了零样本迁移。

-

ALIGN: 使用18亿个图文对进行预训练,进一步扩大了数据规模。

-

FILIP: 引入细粒度的图像-文本交互,提高了模型性能。

-

PyramidCLIP: 利用多尺度特征对齐提升模型表达能力。

生成式预训练

生成式预训练通过重建图像或文本来学习多模态表示。代表性工作包括:

-

FLAVA: 同时进行图像重建、文本重建和图文匹配预训练。

-

CoCa: 结合对比学习和生成式预训练,实现了更好的性能。

-

SAM (Segment Anything Model): 通过图像分割任务进行预训练,可以实现零样本分割。

对齐式预训练

对齐式预训练旨在学习图像区域与文本之间的细粒度对应关系。代表性工作包括:

-

GLIP: 通过目标检测任务学习图像区域与文本的对齐。

-

DetCLIP: 引入词典增强的视觉概念并行预训练。

VLM迁移学习方法

为了将预训练的VLM应用到下游任务,研究人员提出了多种迁移学习方法:

提示调优

提示调优通过学习任务相关的提示来适应下游任务,主要包括:

- 文本提示调优:

- CoOp: 学习连续的文本提示嵌入。

- CoCoOp: 引入实例级的文本提示。

- CLIP-Adapter: 使用轻量级adapter进行提示调优。

- 视觉提示调优:

- VPT: 在图像编码器中插入可学习的提示tokens。

- VL-Prompt: 同时学习视觉和语言提示。

- 文本-视觉联合提示调优:

- UPT: 统一的提示调优框架,同时学习文本和视觉提示。

特征适配

特征适配通过在原有模型基础上添加少量可训练参数来实现迁移学习:

- CLIP-Adapter: 使用轻量级的adapter模块进行特征适配。

- Tip-Adapter: 基于近邻学习的快速适配方法。

- VL-Adapter: 结合视觉和语言适配器的多模态适配方法。

其他方法

- CLIP-ViL: 将CLIP特征与任务特定模型结合。

- CLIP-Adapter++: 引入对抗训练和知识蒸馏的适配方法。

- VLMo: 多任务训练的统一视觉语言模型。

VLM知识蒸馏方法

为了将VLM的知识迁移到下游任务专用模型中,研究人员提出了多种知识蒸馏方法:

目标检测知识蒸馏

- ViLD: 使用CLIP蒸馏目标检测模型。

- YOLO-World: 基于CLIP的开放词汇目标检测模型。

- RegionCLIP: 区域级的CLIP知识蒸馏。

语义分割知识蒸馏

- CLIPSeg: 使用CLIP特征进行零样本语义分割。

- ZegCLIP: 基�于CLIP的零样本语义分割方法。

- MaskCLIP: 结合掩码预测的CLIP知识蒸馏。

其他任务知识蒸馏

- ActionCLIP: 基于CLIP的动作识别方法。

- CLIP-Event: 使用CLIP进行事件检测。

- CLIPScore: 基于CLIP的图像-文本相关性评估指标。

未来研究方向

尽管VLM在视觉任务中取得了显著进展,但仍存在一些挑战和潜在的研究方向:

-

大规模多模态预训练:如何更有效地利用大规模图文数据进行预训练,是未来研究的重要方向。

-

模型压缩与加速:如何在保持性能的同时,减小模型规模、提高推理速度,是VLM实际应用的关键问题。

-

跨语言跨模态迁移:如何实现VLM在不同语言和模态之间的高效迁移,值得进一步探索。

-

细粒度视觉-语言对齐:如何学习更精确的视觉区域与文本的对应关系,是提升VLM性能的重要途径。

-

可解释性与鲁棒性:如何提高VLM的可解释性和对抗攻击的鲁棒性,是保证模型可靠性的关键。

-

多模态融合:如何更好地融合视觉、语言等多种模态的信息,是未来多模态智能的重要研究方向。

结论

本文全面综述了视觉语言模型(VLM)在视觉任务中的应用现状,包括VLM的预训练方法、迁移学习方法和知识蒸馏方法。VLM通过学习图像和文本之间的关联,在多种视觉任务上取得了显著成果,为计算机视觉领域带来了新的研究范式。未来,大规模多模态预训练、模型压缩与加速、跨语言跨模态迁移等方向将是VLM研究的重点。相信随着研究的深入,VLM将在更多视觉任务中发挥重要作用,推动人工智能向着更高水平发展。

参考文献

-

Radford, A., Kim, J. W., Hallacy, C., Ramesh, A., Goh, G., Agarwal, S., ... & Sutskever, I. (2021). Learning transferable visual models from natural language supervision. In International Conference on Machine Learning (pp. 8748-8763). PMLR.

-

Jia, C., Yang, Y., Xia, Y., Chen, Y. T., Parekh, Z., Pham, H., ... & Le, Q. V. (2021). Scaling up visual and vision-language representation learning with noisy text supervision. In International Conference on Machine Learning (pp. 4904-4916). PMLR.

-

Zhang, J., Huang, J., Jin, S., & Lu, S. (2024). Vision-language models for vision tasks: A survey. IEEE Transactions on Pattern Analysis and Machine Intelligence.

-

Zhou, K., Yang, J., Loy, C. C., & Liu, Z. (2022). Learning to prompt for vision-language models. International Journal of Computer Vision, 130(9), 2337-2348.

-

Gao, P., Geng, S., Zhang, R., Ma, T., Fang, R., Zhang, Y., ... & Lin, D. (2022). CLIP-Adapter: Better vision-language models with feature adapters. arXiv preprint arXiv:2110.04544.

-

Kirillov, A., Mintun, E., Ravi, N., Mao, H., Rolland, C., Gustafson, L., ... & Girshick, R. (2023). Segment anything. arXiv preprint arXiv:2304.02643.

编辑推荐精选

GPT Plus|Pro充值

GPT充值

支持 ChatGPT Plus / Pro 充值服务,支付便捷,自动发货,售后可查。

GPT Image 2中文站

AI 图片生成平台

GPT Image 2 是面向用户的 AI 图片生成平台,支持文生图、图生图及多模型创意工作流。

Vecbase

你的AI Agent团队

Vecbase 是专为 AI 团队打造的智能工作空间,将数据管理、模型协作与知识沉淀整合于一处。算法、产品与业务在同一平台无缝协同,让从数据到 AI 应用的落地更快一步。

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

QoderWork

阿里Qoder团队推出的桌面端AI智能体

QoderWork 是阿里推出的本地优先桌面 AI 智能体,适配 macOS14+/Windows10+,以自然语言交互实现文件管理、数据分析、AI 视觉生成、浏览器自动化等办公任务,自主拆解执行复杂工作流,数据本地运行零上传,技能市场可无限扩展,是高效的 Agentic 生产力办公助手。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号