OpenCLIP: 开源实现的CLIP模型

OpenCLIP简介

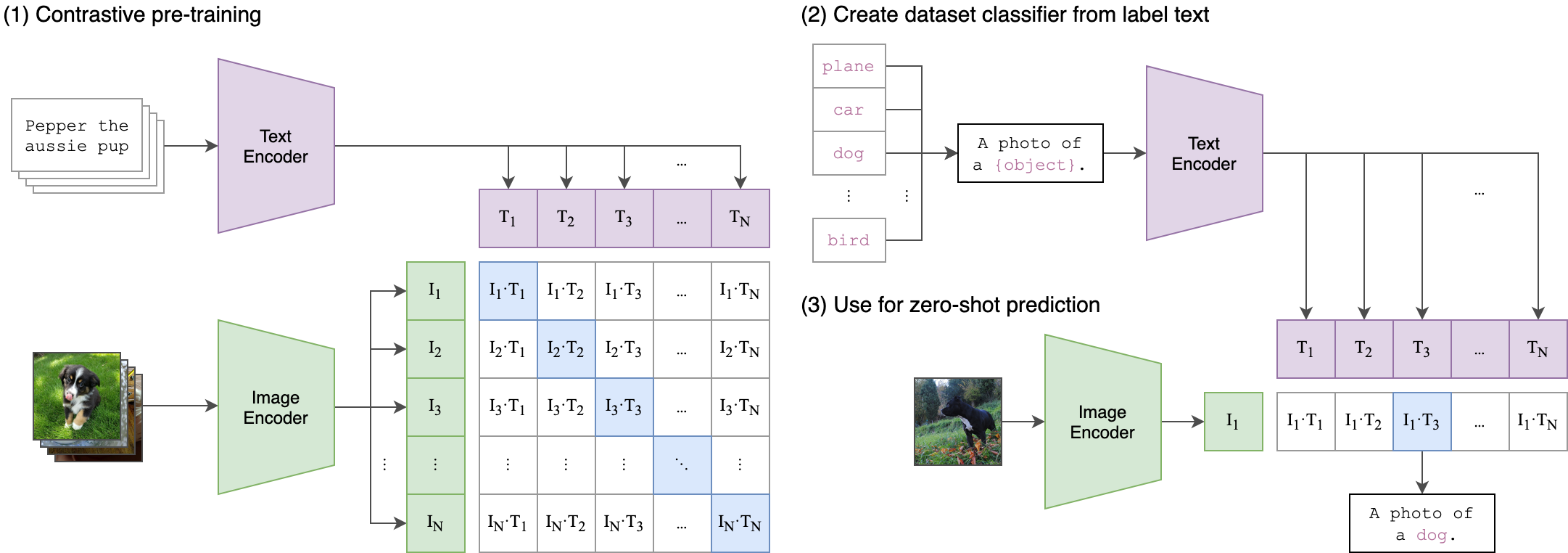

OpenCLIP是OpenAI CLIP(Contrastive Language-Image Pre-training)模型的开源实现。CLIP是一种强大的视觉-语言预训练模型,可以通过自然语言描述来理解图像内容。OpenCLIP项目旨在提供CLIP的开源复现,并在此基础上进行改进和扩展。

OpenCLIP的主要特点包括:

-

提供多种预训练模型,包括在LAION-400M、LAION-2B等大规模数据集上训练的模型。

-

支持多种模型架构,如ViT、ResNet等。

-

实现了CLIP的训练和评估代码,支持分布式训练。

-

提供了详细的使用文档和示例代码。

-

支持在自定义数据集上进行微调。

-

实现了一些CLIP的改进版本,如CoCa等。

OpenCLIP为研究人员和开发者提供了一个灵活的CLIP实现,可以用于各种视觉-语言任务。

模型性能

OpenCLIP训练了多个模型,在ImageNet零样本分类任务上取得了优秀的性能。以下是部分模型的性能对比:

| 模型 | 训练数据 | 分辨率 | 样本数 | ImageNet零样本准确率 |

|---|---|---|---|---|

| ConvNext-XXLarge | LAION-2B | 256px | 34B | 79.5% |

| ViT-L/14 | DataComp-1B | 224px | 13B | 79.2% |

| ViT-G/14 | LAION-2B | 224px | 34B | 80.1% |

| ViT-L/14 (原始CLIP) | WIT | 224px | 13B | 75.5% |

可以看到,OpenCLIP训练的模型性能已经超过了原始CLIP模型。

使用方法

安装

可以通过pip安装OpenCLIP:

pip install open_clip_torch

加载预训练模型

使用以下代码可以加载预训练模型:

import open_clip model, _, preprocess = open_clip.create_model_and_transforms('ViT-B-32', pretrained='laion2b_s34b_b79k') tokenizer = open_clip.get_tokenizer('ViT-B-32')

图像-文本相似度计算

import torch from PIL import Image image = preprocess(Image.open("image.jpg")).unsqueeze(0) text = tokenizer(["a diagram", "a dog", "a cat"]) with torch.no_grad(): image_features = model.encode_image(image) text_features = model.encode_text(text) image_features /= image_features.norm(dim=-1, keepdim=True) text_features /= text_features.norm(dim=-1, keepdim=True) text_probs = (100.0 * image_features @ text_features.T).softmax(dim=-1) print("Label probs:", text_probs)

这段代码展示了如何使用OpenCLIP计算图像和文本之间的相似度。

训练技巧

OpenCLIP提供了丰富的训练选项和技巧,以下是一些重要的训练技巧:

-

多GPU训练:支持使用torchrun进行多GPU分布式训练。

-

梯度累积:使用

--accum-freq参数可以模拟更大的batch size。 -

混合精度训练:使用

--precision amp启用混合精度训练。 -

数据并行:支持使用多个数据源进行训练,可以通过

::分隔不同的数据路径。 -

Patch Dropout:可以通过设置

patch_dropout参数来提高训练速度。 -

模型蒸馏:支持从预训练模型进行知识蒸馏。

-

Int8量化:支持Int8训练和推理,可以提高训练速度。

-

远程训练:支持从S3等远程存储加载和保存模型。

CoCa模型

OpenCLIP还实现了CoCa(Contrastive Captioners)模型,这是CLIP的一个改进版本。CoCa在CLIP的基础上增加了一个生成式解码器,可以同时进行对比学习和图像描述生成。

使用CoCa生成图像描述的示例代码:

import open_clip import torch from PIL import Image model, _, transform = open_clip.create_model_and_transforms( model_name="coca_ViT-L-14", pretrained="mscoco_finetuned_laion2B-s13B-b90k" ) im = Image.open("cat.jpg").convert("RGB") im = transform(im).unsqueeze(0) with torch.no_grad(): generated = model.generate(im) print(open_clip.decode(generated[0]).split("<end_of_text>")[0].replace("<start_of_text>",

编辑推荐精选

GPT Plus|Pro充值

GPT充值

支持 ChatGPT Plus / Pro 充值服务,支付便捷,自动发货�,售后可查。

GPT Image 2中文站

AI 图片生成平台

GPT Image 2 是面向用户的 AI 图片生成平台,支持文生图、图生图及多模型创意工作流。

Vecbase

你的AI Agent团队

Vecbase 是专为 AI 团队打造的智能工作空间,将数据管理、模型协作与知识沉淀整合于一处。算法、产品与业务在同一平台无缝协同,让从数据到 AI 应用的落地更快一步。

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

QoderWork

阿里Qoder团队推出的桌面端AI智能体

QoderWork 是阿里推出的本地优先桌面 AI 智能体,适配 macOS14+/Windows10+,以自然语言交互实现文件管理、数据分析、AI 视觉生成、浏览器自动化等办公任务,自主拆解执行复杂工作流,数据本地运行零上传,技能市场可无限扩展,是高效的 Agentic 生产力办公助手。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号