ppl.llm.serving: 高性能大语言模型推理服务框架

ppl.llm.serving 简介

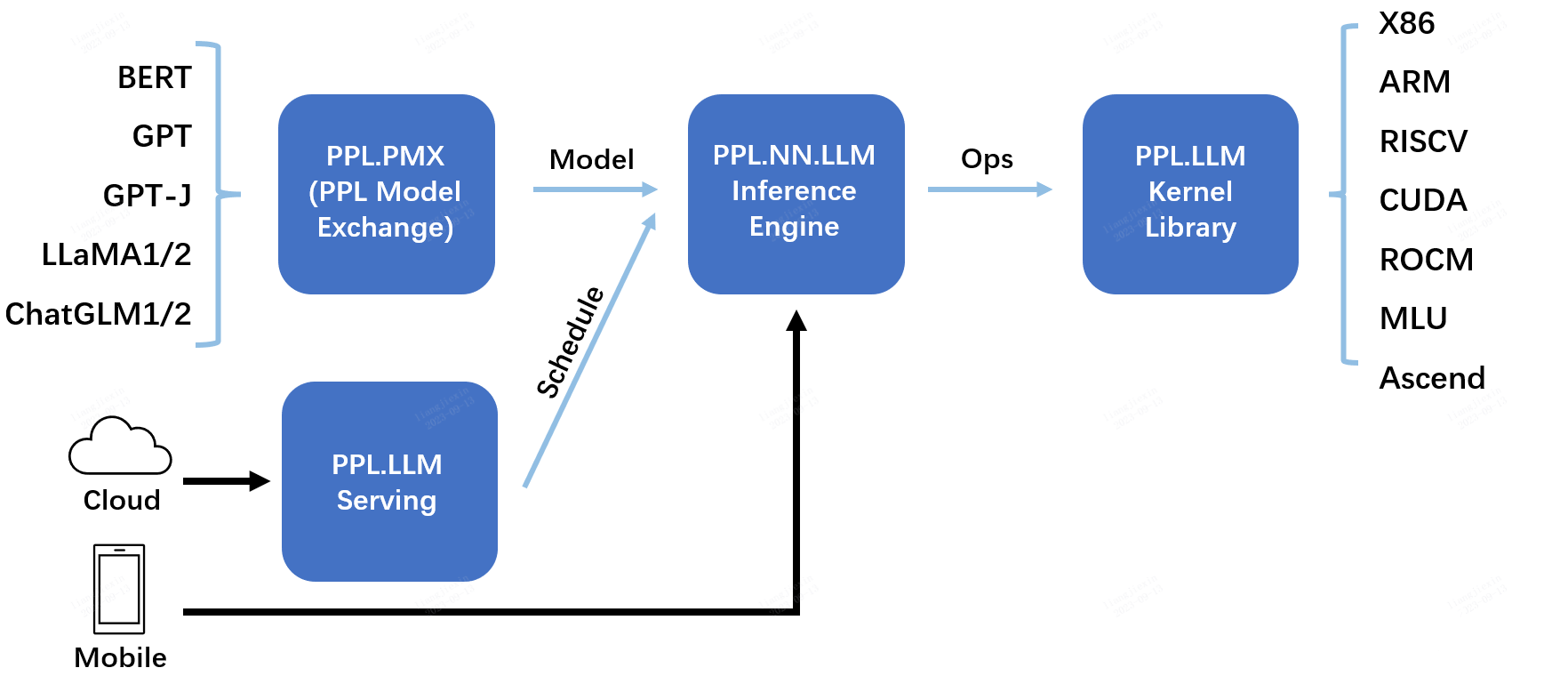

ppl.llm.serving 是 PPL.LLM 系统的重要组成部分,是一个基于 ppl.nn 的大语言模型推理服务框架。它为各种大型语言模型(LLMs)提供高性能的推理和服务能力,目前主要支持 LLaMA 模型。

ppl.llm.serving 的主要特点包括:

- 基于 gRPC 构建高性能服务

- 支持 LLaMA 等多种大语言模型

- 提供异步编码和异步解码,降低服务开销

- KV Cache 分配管理优化

- 调度优化,减少硬件满载时的不必要请求队列查询

系统要求

ppl.llm.serving 可以运行在 x86_64 或 arm64 架构的 Linux 系统上,主要依赖如下:

- GCC >= 9.4.0

- CMake >= 3.18

- Git >= 2.7.0

- CUDA Toolkit >= 11.4 (推荐 11.6,用于 CUDA 支持)

快速开始

以下是使用 ppl.llm.serving 的基本步骤:

- 安装依赖(以 Debian/Ubuntu 为例)

apt-get install build-essential cmake git

- 克隆源代码

git clone https://github.com/openppl-public/ppl.llm.serving.git

- 编译源码

./build.sh -DPPLNN_USE_LLM_CUDA=ON -DPPLNN_CUDA_ENABLE_NCCL=ON -DPPLNN_ENABLE_CUDA_JIT=OFF -DPPLNN_CUDA_ARCHITECTURES="'80;86;87'" -DPPLCOMMON_CUDA_ARCHITECTURES="'80;86;87'"

注意:如果使用多 GPU,需要启用 NCCL。

- 导出模型

请参考 ppl.pmx 的相关说明导出模型。

- 运行服务器

./ppl-build/ppl_llama_server /path/to/server/config.json

服务器配置示例可以在 src/models/llama/conf 目录下找到。运行服务器前,需要正确设置以下配置:

model_dir: ppl.pmx 导出的模型路径model_param_path: 模型参数文件路径,通常为$model_dir/params.jsontokenizer_path: sentencepiece tokenizer 文件路径

- 运行客户端

./ppl-build/client_sample 127.0.0.1:23333

客户端通过 gRPC 向服务器发送��请求并获取模型推理结果。更多详细信息可以参考 tools/client_sample.cc。

性能测试

ppl.llm.serving 提供了性能测试工具:

./ppl-build/client_qps_measure --target=127.0.0.1:23333 --tokenizer=/path/to/tokenizer/path --dataset=tools/samples_1024.json --request_rate=inf

--request_rate 参数用于设置每秒请求数,设为 inf 表示以最快速度发送所有请求。更多信息请参考 tools/client_qps_measure.cc。

离线推理

ppl.llm.serving 也支持离线推理:

./ppl-build/offline_inference /path/to/server/config.json

详细信息请参考 tools/offline_inference.cc。

项目贡献

ppl.llm.serving 是一个开源项目,欢迎社区贡献。目前项目有 122 个星标和 13 个分支,主要使用 C++(93.2%)、CMake(6.6%) 和 Shell(0.2%) 开发。

如果您对项目感兴趣,可以通过以下方式参与:

总结

ppl.llm.serving 为大语言模型提供了高性能的推理服务框架。它不仅支持多种模型,还在性能优化方面做了大量工作。无论是构建��生产级服务还是进行学术研究,ppl.llm.serving 都是一个值得考虑的选择。我们期待看到更多开发者和研究者加入到项目中来,共同推动大语言模型服务技术的发展。

🚀 如果您对大语言模型感兴趣,不妨尝试使用 ppl.llm.serving 来部署和服务您的模型。同时也欢迎为项目贡献代码,一起让这个强大的框架变得更好!

编辑推荐精选

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作��、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

Refly.AI

最适合小白的AI自动化工作流平台

无需编码,轻松生成可复用、可变现的AI自动化工作流

酷表ChatExcel

大模型驱动的Excel数据处理工具

基于大模型交互的表格处理系统,允许用户通过对话方式完成数据整理和可视化分析。系统采用机器学习算法解析用户指令,自动执行排序、公式计算和数据透视等操作,支持多种文件格式导入导出。数据处理响应速度保持在0.8秒以内,支持超过100万行数据的即时分析。

TRAE编程

AI辅助编程,代码自动修复

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

AIWritePaper论文写作

AI论文写作指导平台

AIWritePaper论文写作是一站式AI论文写作辅助工具,简化了选题、文献检索至论文撰写的整个过程。通过简单设定,平台可快��速生成高质量论文大纲和全文,配合图表、参考文献等一应俱全,同时提供开题报告和答辩PPT等增值服务,保障数据安全,有效提升写作效率和论文质量。

博思AIPPT

AI一键生成PPT,就用博思AIPPT!

博思AIPPT,新一代的AI生成PPT平台,支持智能生成PPT、AI美化PPT、文本&链接生成PPT、导入Word/PDF/Markdown文档生成PPT等,内置海量精美PPT模板,涵盖商务、教育、科技等不同风格,同时针对每个页面提供多种版式,一键自适应切换,完美适配各种办公场景。

潮际好麦

AI赋能电商视觉革命,一站式智能商拍平台

潮际好麦深耕服装行业,是国内AI试衣效果最好的软件。使用先进AIGC能力为电商卖家批量提供优质的、低成本的商拍图。合作品牌有Shein、Lazada、安踏、百丽等65个国内外头部品牌,以及国内10万+淘宝、天猫、京东等主流平台的品牌商家,为卖家节省将近85%的出图成本,提升约3倍出图效率,让品牌能够快速上架。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号