Google开源最小的端侧模型,只有2B参数手机运行无延迟,又衍生出很多好场景可以落地

Gemma 是 Google 推出的轻量级、最先进的开放模型系列,采用与创建Gemini模型相同的研究和技术构建而成。

Google 在今年的6月27日发布了 Gemma 2 的 9B 和 27B 模型。

自首次亮相以来,27B 模型迅速成为 LMSYS Chatbot Arena排行榜 上排名最高的开放模型之一,在真实对话中的表现甚至超过了其大小两倍以上的热门模型。

但是 Google 对于轻量级LLM追求的还不止于此,不久前又发布了 Gemma 2 的 2B 版本,势必要在轻量级这一个道路上走到极致。

项目简介

Google承诺Gemma不仅仅注重性能,还建立在负责任的 AI 基础上,优先考虑安全性和可访问性。

为了支持这一承诺,Google最新宣布Gemma 2系列新增三款产品,分别是 Gemma 2 2B、ShieldGemma 和 Gemma Scope。让我们一一进行介绍。

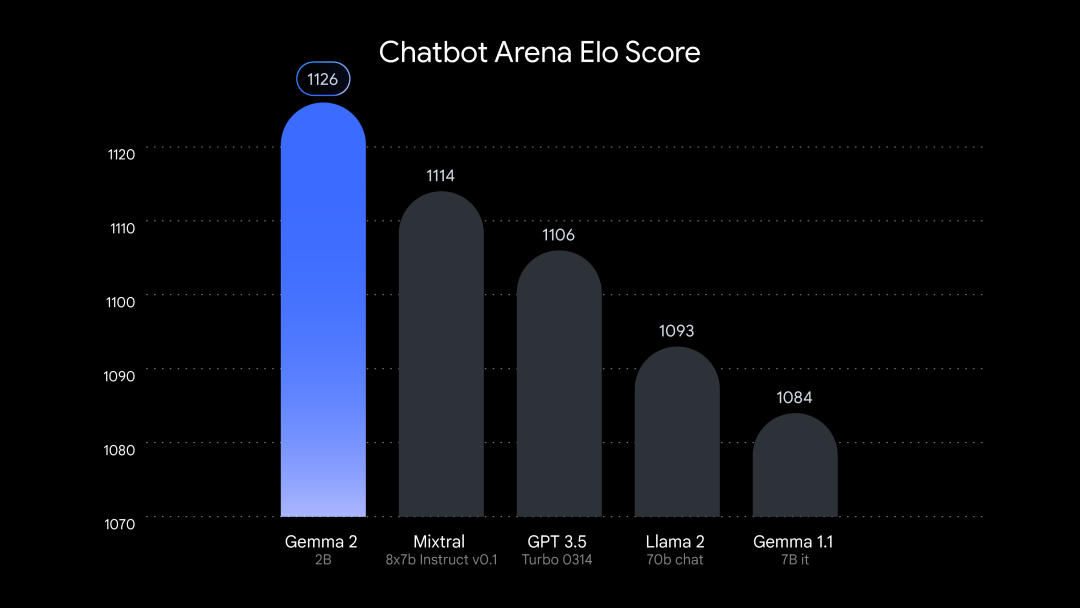

首先来看2B模型,Gemma 2 2B 的参数大小只有 20亿,但是Gemma 2 2B在 Chatbot Arena 上超越了所有 GPT-3.5模型,以其尺寸提供同类最佳的性能,超越同类产品中的其他开放式型号。

除了功能强大以外,Gemma 2 2B 还可以在各种硬件上高效运行。从边缘设备和笔记本电脑到具有Vertex AI和Google Kubernetes Engine (GKE)的强大云部署。

为了进一步提高速度,它使用NVIDIA TensorRT-LLM库进行了优化,并以NVIDIA NIM的形式提供。此优化针对各种部署,包括数据中心、云、本��地工作站、PC和边缘设备,使用NVIDIA RTX、NVIDIA GeForce RTX GPU 或NVIDIA Jetson模块进行边缘 AI。

此外,Gemma 2 2B 还可以与Keras、JAX、Hugging Face、NVIDIA NeMo、Ollama、Gemma.cpp 以及即将推出的MediaPipe无缝集成,以简化开发。

因为Gemma 2 2B足够小,甚至可以在Google Colab 的 T4 GPU免费层上运行,使实验和开发比以往更加简单。

再看第二个产品 ShieldGemma。

ShieldGemma是一系列最先进的安全分类器,旨在检测和缓解AI模型输入和输出中的有害内容。

ShieldGemma专门针对四个危害领域:仇恨言论、骚扰、色情内容、危险内容。

这些开放分类器是对负责任 AI 工具包中现有安全分类器套件的补充,其中包括一种使用有限数量的数据点构建针对特定策略的分类器的方法,以及通过 API 提供的现有Google Cloud现成分类器。

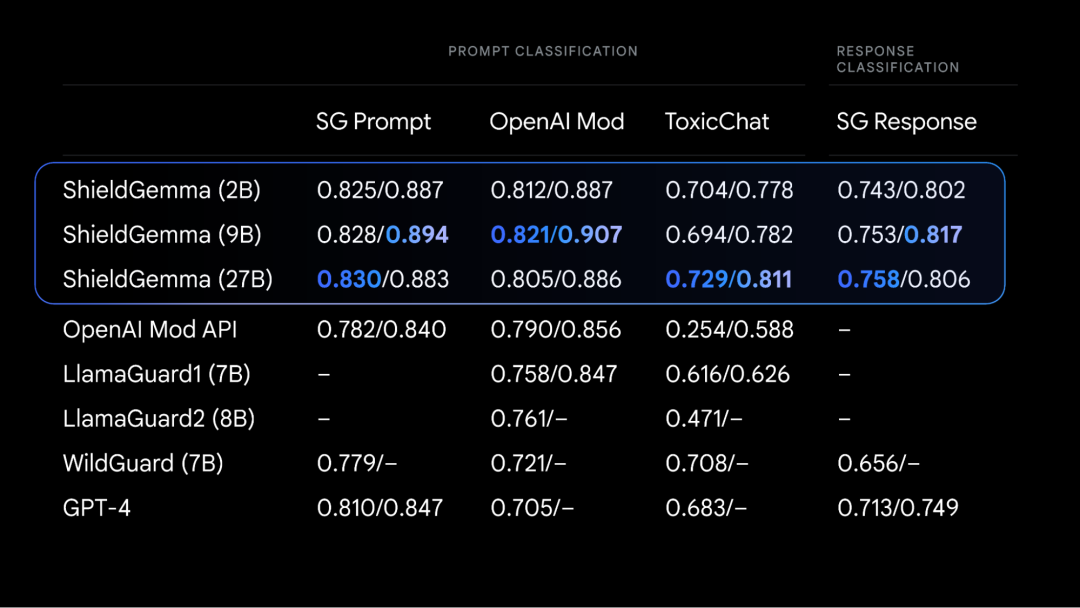

ShieldGemma同样有不同版本的模型。

2B模型非常适合在线分类任务,而9B和27B版本则为不太关心延迟的离线应用程序提供了更高的性能。

所有尺寸都利用NVIDIA速度优化来实现跨硬件的高效性能。

基于最佳 F1(左)/AU-PRC(右)的评估结果,越高越好。

Google使用 𝛼=0 和 T = 1 来计算概率。ShieldGemma (SG) Prompt 和 SG Response 是Google的测试数据集,OpenAI Mod/ToxicChat 是外部基准。

再来看看最后一个产品 Gemma Scope。

Gemma Scope为研究人员和开发人员提供了前所未有的透明度,让他们能够了解Gemma 2模型的决策过程。

Gemma Scope使用稀疏自动编码器(SAE)放大模型中的特定点,使Gemma 2模型内部工作原理更易于解释。

该产品有超过400个免费SAE,涵盖 Gemma 2 2B和9B的所有层。

这些 SAE 是专门的神经网络,可帮助我们解析Gemma 2处理的密集复杂信息,将其扩展为更易于分析和理解的形式。

通过研究这些扩展的视图,研究人员可以获得有关Gemma 2如何识别模式、处理信息并最终做出预测的宝贵见解。

而且通过交互式演示让我们无需在Neuronpedia上编写代码即可探索 SAE 特性并分析模型行为。

总结

Google的 Gemma 2 模型以2B的参数量能达到这么好的效果,让我想起了前些日子 Mistral Large 2与Meta Lllama 3.1...

编辑推荐精选

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告�写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

Refly.AI

最适合小白的AI自动化工作流平台

无需编码,轻松生成可复用、可变现的AI自动化工作流

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号