AI也能刷短视频了?!清华大学最新发布短视频理解模型,含图像文本音频多模态理解

AI已经出现在大众的视野中好久了,你告诉我AI会写文章、会作图甚至会算数我都不会太过于震惊。

但是让我万万没想到的是,AI居然能像人一样刷短视频了!还能理解短视频的内容甚至能捕捉到视频中的笑点。

短视频我们并不陌生,但是AI想要理解短视频可不是一件简单的事情,首先要做到理解图像内容、文本内容和音频内容,还要将这些内容进行串联。

近期在ICML 2024上发表的论文《video- salmon: Speech-Enhanced Audio-Visual Large Language Models》就是首个集齐视频中所有音视频元素(自然图像、文字、语音、音频事件、音乐)的大模型。

扫码加入AI交流群

获得更多技术支持和交流

(请注明自己的职业)

项目简介

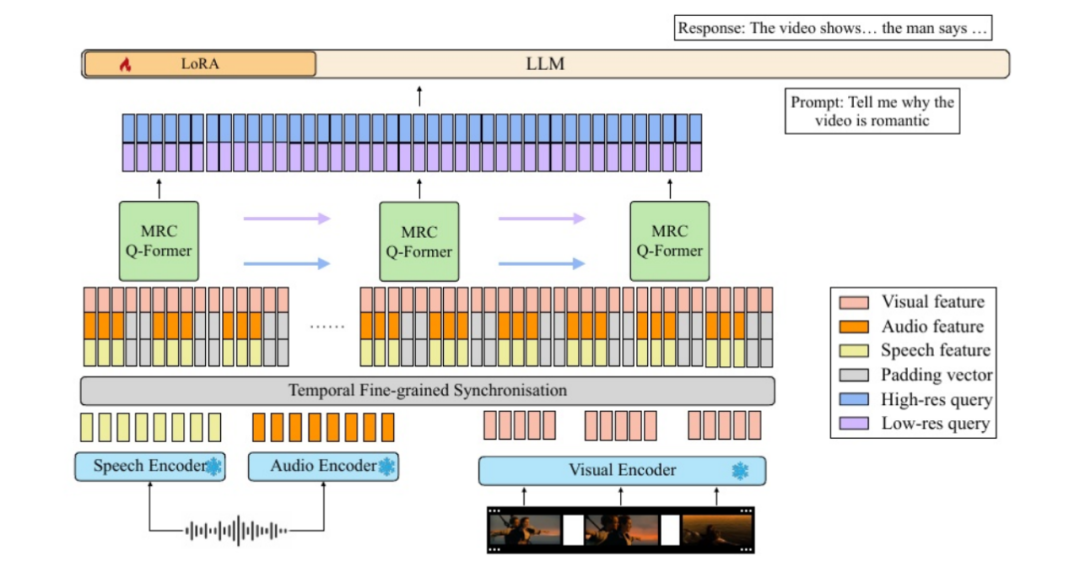

video- salmon的核心是一个多分辨率因果 (MRC) Q-Former结构,该结构将时间同步的视听输入特征与三种不同时间尺度的文本表示空间对齐,满足依赖不同视频元素的任务要求。

为了加强连续视频帧之间事件的时间因果关系,在MRC Q-Former中包含了一个具有特殊因果掩模的因果自注意结构。

此外,为了避免视频中的特定帧或单一模态占主导地位,video- salmon使用提出的多样性损失和新的不成对视听混合策略�进行训练。

那具体效果如何呢,让我们来看看官方给出的实例。

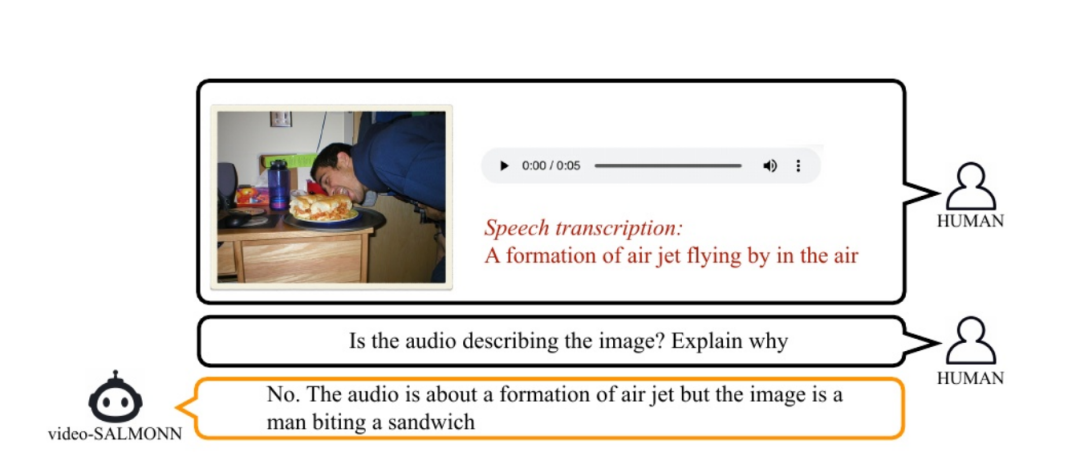

首先将声音的描述与图片内容不符的视频上传给video- salmon,然后对它进行提问,它能够准确地告诉我们这个声音描述与图像内容的是不相符的。

然后就是给出经典的影视视频,看video- salmon能否理解视频的正确含义。

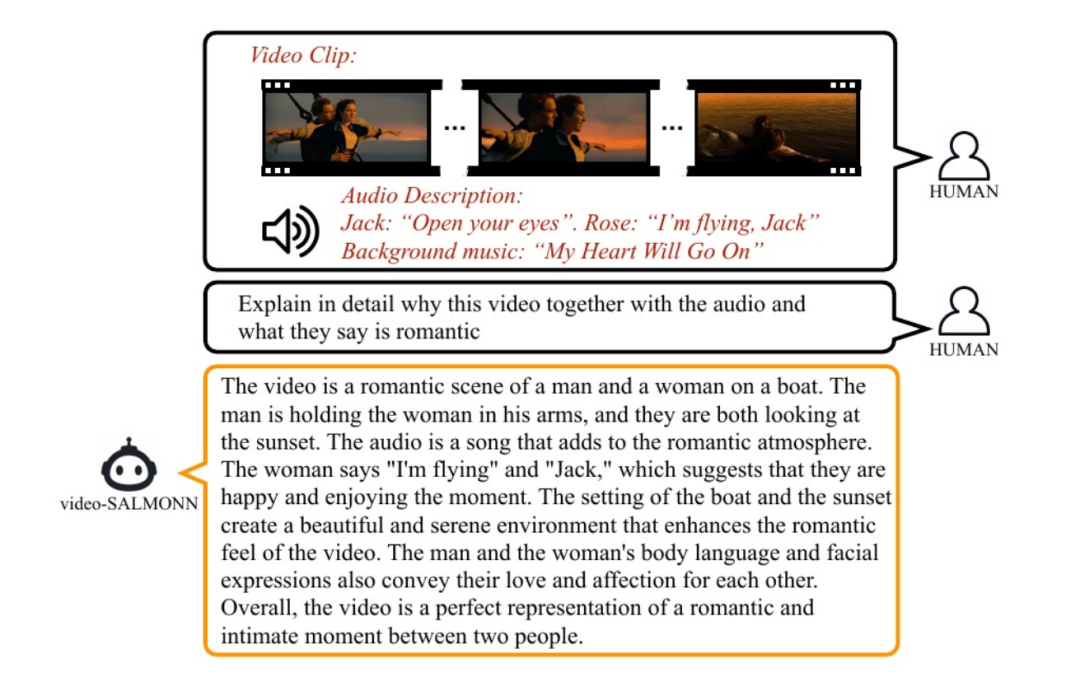

第一个是**《泰坦尼克号》杰克和露丝站在甲板上相拥的片段,问video- salmon**为什么觉得这个片段浪漫。

video- salmon回答说视频中男人把女人拥在怀里,两人一起看着日落。背景音乐是一首歌,增添了浪漫的气氛。

女人说「我在飞」和「杰克」,这表明他们很幸福,享受这一刻。船和日落的背景创造了一个美丽宁静的环境,增强了视频的浪漫感觉。

男女的肢体语言和面部表情也传达了他们对彼此的爱和深情。总的来说,这段视频完美地展现了两人之间浪漫而亲密的时刻。

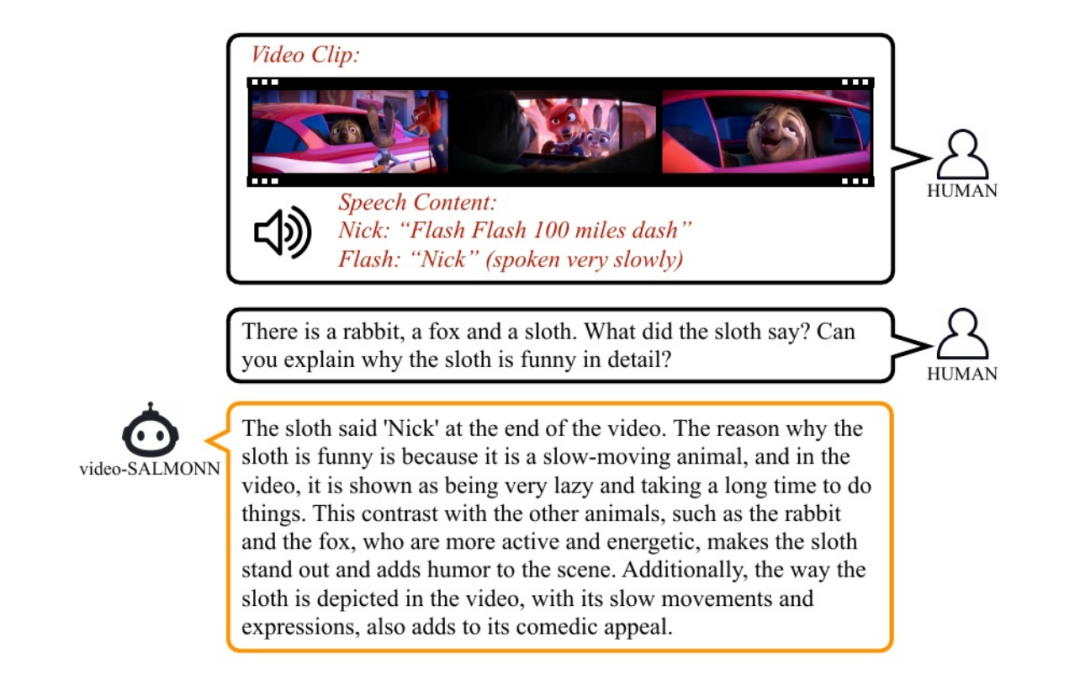

第二个片段是**《疯狂动物城》中闪电开车的搞笑场景。将这个视频上传给video- salmon,然后问它树懒说了什么话**,为什么这段视频搞笑。

video- salmon回答说树懒在视频结尾时说了**“Nick”**。

而树懒之所以搞笑�,是因为它是一种动作缓慢的动物,在视频中表现得非常懒散,做事情花了很长时间。

这与其他动物(如兔子和狐狸)的活跃和充满活力形成了鲜明对比,使树懒显得尤为突出,增加了幽默感。

此外,视频中树懒的慢动作和表情也增加了它的喜剧效果。

总结

通过上述给出的例子我们可以看到,video- salmon还是能比较不错地将视频中的音频、文本和图像进行结合,也能较好的回答有关视频的内容。

但是我们也能很明显地看出video- salmon的回答并不太符合正常人说话的习惯和风格。

而且video- salmon在回答时是无法联网查询视频的上下文内容的,这也造成了video- salmon在回答时的局限。

如**《疯狂动物城》片段的搞笑有很大一部分原因并不是与活泼形成了对比,而是因为树懒的名字叫闪电但是做事说话却很慢**。

期待以后能做到自动查找上下文并结合回答,那将会实现真正意义上的像人一样的刷短视频。

而且如果这种技术实现进一步的升级,能够实现长视频的识别,那我们以后就可以将时间较长的网课上传给AI,让它来告诉我们网课讲了什么,可能会更加节省我们的时间。

论文链接:

https://openreview.net/pdf?id=nYsh5GFIqX

关注「向量光年」公众号,获取更多AI资讯。

编辑推荐精选

GPT Image 2中文站

AI 图片生成平台

GPT Image 2 是面向用户的 AI 图片生成平台,支持文生图、图生图及多模型创意工作流。

Nano Banana Pro 中文站

AI 图片生成工具

输入简单文字,生成想要的图片。支持Nano Banana/gptimage-2等最新模型。

Vecbase

你的AI Agent团队

Vecbase 是专为 AI 团队打造的智能工作空间,将数据管理、模型协作与知识沉淀整合于一处。算法、产品与业务在同一平台无缝协同,让从数据到 AI 应用的落地更快一步。

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

QoderWork

阿里Qoder团队推出的桌面端AI智能体

QoderWork 是阿里推出的本地优先桌面 AI 智能体,适配 macOS14+/Windows10+,以自然语言交互实现文件管理、数据分析、AI 视觉生成、浏览器自动化等办公任务,自主拆解执行复杂工作流,数据本地运行零上传,技能市场可无限扩展,是高效的 Agentic 生产力办公助手。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提��升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号