多模态强化学习精选资源

这是一个**多模态强化学习(MMRL)**研究论文的集合。 该仓库将持续更新以跟踪MMRL的前沿进展。 某些论文可能与强化学习无关,但我们仍然将它们包含在内,因为它们可能对MMRL的研究有用。

欢迎关注和点赞!

简介

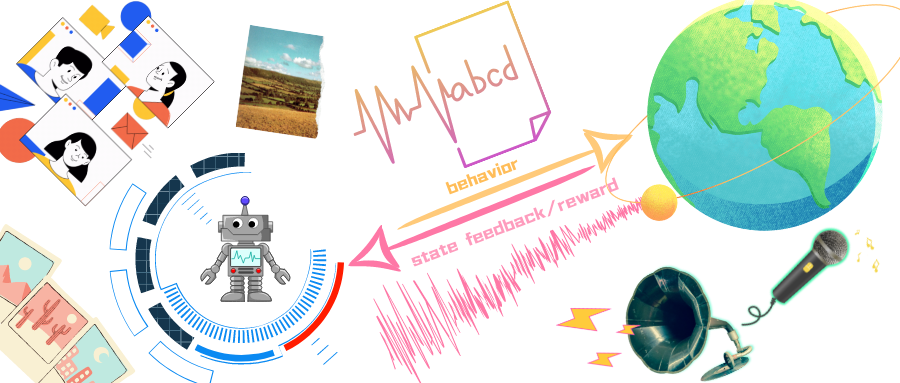

多模态强化学习智能体专注于从视频(图像)、语言(文本)或两者同时学习,就像人类一样。我们认为,让智能体直接从图像或文本中学习非常重要,因为这些数据可以轻松从互联网获取。

目录

论文

格式:

- [标题](论文链接) [相关链接]

- 作者。

- 关键词。

- 实验环境。

ICLR 2024

-

- Guowei Xu, Ruijie Zheng, Yongyuan Liang, Xiyao Wang, Zhecheng Yuan, Tianying Ji, Yu Luo, Xiaoyu Liu, Jiaxin Yuan, Pu Hua, Shuzhen Li, Yanjie Ze, Hal Daumé III, Furong Huang, Huazhe Xu

- 关键词:视觉强化学习;休眠比率

- 实验环境:DeepMind控制套件,Meta-world,Adroit

-

- Jianshu Hu, Yunpeng Jiang, Paul Weng

- 关键词:强化学习、数据增强

- 实验环境:DeepMind控制套件

-

- Guozheng Ma, Lu Li, Sen Zhang, Zixuan Liu, Zhen Wang, Yixin Chen, Li Shen, Xueqian Wang, Dacheng Tao

- 关键词:可塑性、视觉强化学习、深度强化学习、样本效率

- 实验环境:DeepMind控制套件,Atari

-

- Dan Haramati, Tal Daniel, Aviv Tamar

- 关键词:深度强化学习、视觉强化学习、以对象为中心、机器人对象操作、组合泛化

- 实验环境:IsaacGym

ICLR 2023

-

PaLI:联合缩放的多语言语言-图像模型(<font color="red">杰出论文前5%</font>)

- Xi Chen, Xiao Wang, Soravit Changpinyo, AJ Piergiovanni, Piotr Padlewski, Daniel Salz, Sebastian Goodman, Adam Grycner, Basil Mustafa, Lucas Beyer, Alexander Kolesnikov, Joan Puigcerver, Nan Ding, Keran Rong, Hassan Akbari, Gaurav Mishra, Linting Xue, Ashish Thapliyal, James Bradbury, Weicheng Kuo, Mojtaba Seyedhosseini, Chao Jia, Burcu Karagol Ayan, Carlos Riquelme, Andreas Steiner, Anelia Angelova, Xiaohua Zhai, Neil Houlsby, Radu Soricut

- 关键词:惊人的零样本学习、语言组件和视觉组件

- 实验环境:无

-

- Yunfan Jiang, Agrim Gupta, Zichen Zhang, Guanzhi Wang, Yongqiang Dou, Yanjun Chen, Li Fei-Fei, Anima Anandkumar, Yuke Zhu, Linxi Fan. NeurIPS 研讨会 2022

- 关键词:多模态提示、基于 Transformer 的通用智能体模型、大规模基准测试

- 实验环境:VIMA-Bench, VIMA-Data

-

- Ruibo Liu, Jason Wei, Shixiang Shane Gu, Te-Yen Wu, Soroush Vosoughi, Claire Cui, Denny Zhou, Andrew M. Dai

- 关键词:语言到物理世界、推理能力

- 实验环境:MuJoCo

ICLR 2022

- CLIP 能在多大程度上改善视觉语言任务?

- Sheng Shen, Liunian Harold Li, Hao Tan 等。 ICLR 2022

- 关键词:视觉语言、CLIP

- 实验环境:无

ICLR 2021

-

- Austin W. Hanjie, Victor Zhong, Karthik Narasimhan. ICML 2021

- 关键词:多模态注意力

- 实验环境:Messenger

-

- Danijar Hafner, Timothy Lillicrap, Mohammad Norouzi 等。

- 关键词:世界模型

- 实验环境:Atari

-

- Adam Stooke, Kimin Lee, Pieter Abbeel 等。

- 关键词:表示学习、无监督学习

- 实验环境:DeepMind Control, Atari, DMLab

ICLR 2019

- 学习目标条件策略的可操作表示

- Dibya Ghosh, Abhishek Gupta, Sergey Levine.

- 关键词:可操作表示学习

- 实验环境:2D 导航(2D 墙壁、2D 房间、轮式、轮式房间、蚂蚁、推动)

NeurIPS 2023

-

- Shaohan Huang, Li Dong, Wenhui Wang, Yaru Hao 等。

- 关键词:多模态感知、世界建模

- 实验环境:IQ50

NeurIPS 2022

-

- Linxi Fan, Guanzhi Wang, Yunfan Jiang 等。

- 关键词:多模态数据集、MineClip

- 实验环境:Minecraft

-

- Bowen Baker, Ilge Akkaya, Peter Zhokhov 等。

- 关键词:逆动力学模型

- 实验环境:minerl

NeurIPS 2021

-

SOAT:用于视觉语言导航的场景和物体感知 Transformer

- Abhinav Moudgil, Arjun Majumdar, Harsh Agrawal 等。

- 关键词:视觉语言导航

- 实验环境:Room-to-Room, Room-Across-Room

-

- Max Schwarzer, Nitarshan Rajkumar, Michael Noukhovitch 等。

- 关键词:潜在动力学建模、无监督强化学习

- 实验环境:Atari

NeurIPS 2018

ICML 2022

-

- Wenlong Huang, Pieter Abbeel, Deepak Pathak等

- 关键词:大规模语言模型、具身智能体

- 实验环境:VirtualHome

-

- Younggyo Seo, Kimin Lee, Stephen L James等

- 关键词:无动作预训练、视频

- 实验环境:Meta-world、DeepMind Control Suite

ICML 2019

- 从像素学习潜在动力学以进行规划

- Danijar Hafner, Timothy Lillicrap, Ian Fischer等

- 关键词:潜在动力学模型、像素观察

- 实验环境:DeepMind Control Suite

ICML 2017

- 基于多任务深度强化学习的零样本任务泛化

- Junhyuk Oh, Satinder Singh, Honglak Lee, Pushmeet Kohli

- 关键词:未见指令、顺序指令

- 实验环境:Minecraft

CVPR 2022

-

- Paul Hongsuck Seo, Arsha Nagrani, Anurag Arnab, Cordelia Schmid

- 关键词:多模态视频字幕、使用未来话语的预训练、多模态视频生成式预训练

- 实验环境:HowTo100M

-

- Shizhe Chen, Pierre-Louis Guhur, Makarand Tapaswi, Cordelia Schmid, Ivan Laptev

- 关键词:双尺度图转换器、可供性检测

- 实验环境:无

-

- Tete Xiao, Ilija Radosavovic, Trevor Darrell等 ArXiv 2022

- 关键词:自监督学习、运动控制

- 实验环境:Isaac Gym

CoRL 2022

-

LM-Nav:使用语言、视觉和动作的大型预训练模型进行机器人导航

- Dhruv Shah, Blazej Osinski, Brian Ichter, Sergey Levine

- 关键词:机器人导航、目标条件、未标注大型数据集、CLIP、ViNG、GPT-3

- 实验环境:无

-

[使用掩蔽视觉预训练进行真实世界机器人学习](https://arxiv.org/abs/2210.03109)

- Ilija Radosavovic, Tete Xiao, Stephen James, Pieter Abbeel, Jitendra Malik, Trevor Darrell

- 关键词:真实世界机器人任务

- 实验环境:无

-

- Suraj Nair, Aravind Rajeswaran, Vikash Kumar等

- 关键词:Ego4D人��类视频数据集、预训练视觉表示

- 实验环境:MetaWorld、Franka Kitchen, Adroit

其他

-

非结构化数据上的语言条件模仿学习 RSS 2021

- Corey Lynch, Pierre Sermanet

- 关键词:开放世界环境

- 实验环境:无

-

从"野外"人类视频中学习可泛化的机器人奖励函数 RSS 2021

- Annie S. Chen, Suraj Nair, Chelsea Finn

- 关键词:奖励函数、"野外"人类视频

- 实验环境:无

-

使用潜在空间模型的离线图像强化学习 L4DC 2021

- Rafael Rafailov, Tianhe Yu, Aravind Rajeswaran 等

- 关键词: 潜在空间模型

- 实验环境: DeepMind Control, Adroit Pen, Sawyer Door Open, Robel D'Claw Screw

-

交叉注意力是否优于自注意力用于多模态情感识别? ICASSP 2022

- Vandana Rajan, Alessio Brutti, Andrea Cavallaro

- 关键词: 多模态情感识别, 交叉注意力

- 实验环境: 无

ArXiv

-

- Boyuan Chen, Zhuo Xu, Sean Kirmani, Brian Ichter, Danny Driess, Pete Florence, Dorsa Sadigh, Leonidas Guibas, Fei Xia

- 关键词: 视觉问答, 3D空间推理

- 实验环境: 空间�视觉问答数据集

-

M2CURL: 通过自监督表示学习实现样本高效的多模态强化学习用于机器人操作

- Fotios Lygerakis, Vedant Dave, Elmar Rueckert

- 关键词: 机器人操作, 自监督表示学习

- 实验环境: Gym

-

- M. Nomaan Qureshi, Ben Eisner, David Held

- 关键词: 策略输出的多模态性, 动作头切换

- 实验环境: MetaWorld

-

- Yuyang Xia, Shuncheng Liu, Quanlin Yu, Liwei Deng, You Zhang, Han Su, Kai Zheng

- 关键词: 自动驾驶, 强化学习中的图神经网络

- 实验环境: CARLA

-

使用强化学习中的图卷积网络进行对话代理的上下文实时多模态情感识别

- Fathima Abdul Rahman, Guang Lu

- 关键词: 情感识别, 强化学习中的图神经网络

- 实验环境: IEMOCAP

-

- Zhizheng Zhang, Wenxuan Xie, Xiaoyi Zhang, Yan Lu

- 关键词: 大语言模型, 通用UI任务自动化API

- 实验环境: RicoSCA, MoTIF

-

- Long Chen, Oleg Sinavski, Jan Hünermann, Alice Karnsund, Andrew James Willmott, Danny Birch, Daniel Maund, Jamie Shotton

- 关键词: 自动驾驶中的大语言模型, 对象级多模态大语言模型

- 实验环境: RicoSCA, MoTIF

-

- Juan Del Aguila Ferrandis, João Moura, Sethu Vijayakumar

- 关键词: 多模态探索方法

- 实验环境: KUKA iiwa机器人臂

-

- Wujun Wen, Jinrong Zhang, Shenglan Liu, Yunheng Li, Qifeng Li, Lin Feng

- 关键词: 时序动作分割, 视频分析中的强化学习

- 实验环境: EGTEA

-

- Shangfei Zheng, Hongzhi Yin, Tong Chen, Quoc Viet Hung Nguyen, Wei Chen, Lei Zhao

- 关键词: 多跳推理, 多模态知识图谱, 归纳式设置, 自适应强化学习

- 实验环境: 无

-

- Afagh Mehri Shervedani, Siyu Li, Natawut Monaikul, Bahareh Abbasi, Barbara Di Eugenio, Milos Zefran

- 关键词: 稳健和深思熟虑的决策, 端到端训练, 重要性增强, 相似性, 改进多模态强化学习领域的逆强化学习训练过程

- 实验环境: 无

-

- Maria Attarian, Advaya Gupta, Ziyi Zhou, Wei Yu, Igor Gilitschenski, Animesh Garg

- 关键词: 认知规划, 语言引导的视频预测

- 实验环境: 无

-

- Boyuan Chen, Fei Xia, Brian Ichter, Kanishka Rao, Keerthana Gopalakrishnan, Michael S. Ryoo, Austin Stone, Daniel Kappler

- 关键词: 目标检测, 现实世界, 机器人任务

- 实验环境: Say Can

-

- Michael Ahn, Anthony Brohan, Noah Brown, Yevgen Chebotar, Omar Cortes, Byron David, Chelsea Finn, Chuyuan Fu, Keerthana Gopalakrishnan, Karol Hausman, Alex Herzog, Daniel Ho, Jasmine Hsu, Julian Ibarz, Brian Ichter, Alex Irpan, Eric Jang, Rosario Jauregui Ruano, Kyle Jeffrey, Sally Jesmonth, Nikhil J Joshi, Ryan Julian, Dmitry Kalashnikov, Yuheng Kuang, Kuang-Huei Lee, Sergey Levine, Yao Lu, Linda Luu, Carolina Parada, Peter Pastor, Jornell Quiambao, Kanishka Rao, Jarek Rettinghouse, Diego Reyes, Pierre Sermanet, Nicolas Sievers, Clayton Tan, Alexander Toshev, Vincent Vanhoucke, Fei Xia, Ted Xiao, Peng Xu, Sichun Xu, Mengyuan Yan, Andy Zeng

- 关键词:真实世界,自然语言

- 实验环境:Say Can

贡献

我们的目标是使这个仓库变得更好。如果您有兴趣贡献,请参考这里的贡献指南。

许可证

Awesome 多模态强化学习在 Apache 2.0 许可下发布。

编辑推荐精选

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视��频的AI工具

Refly.AI

最适合小白的AI自动化工作流平台

无需编码,轻松生成可复用、可变现的AI自动化工作流

酷表ChatExcel

大模型驱动的Excel数据处理工具

基于大模型交互的表格处理系统,允许用户通过对话方式完成数据整理和可视化分析。系统采用机器学习算法解析用户指令,自动执行排序、公式计算和数据透视等操作,支持多种文件格式导入导出。数据处理响应速度保持在0.8秒以内,支持超过100万行数据的即时分析。

TRAE编程

AI辅助编程,代码自动修复

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

AIWritePaper论文写作

AI论文写作指导平台

AIWritePaper论文写作是一站式AI论文写作辅助工具,简化了选题、文献检索至论文撰写的整个过程。通过简单设定,平台可快速生成高质量论文大纲和全文,配合图表、参考文献等一应俱全,同时提供开题报告和答辩PPT等增值服务,保障数据安全,有效提升写作效率和论文质量。

博思AIPPT

AI一键生成PPT,就用博思AIPPT!

博思AIPPT,新一代的AI生成PPT平台,支持智能生成PPT、AI美化PPT、文本&链接生成PPT、导入Word/PDF/Markdown文档生成PPT等,内置海量精美PPT模板,涵盖商务、教育、科技等不同风格,同时针对每个页面提供多种版式,一键自适应切换,完美适配各种办公场景。

潮际好麦

AI赋能电商视觉革命,一站式智能商拍平台

潮际好麦深耕服装行业,是国内AI试衣效果最好的软件。使用先进AIGC能力为电商卖家批量提供优质的、低成本的商拍图。合作品牌有Shein、Lazada、安踏、百丽等65个国内外头部品牌,以及国内10万+淘宝、天猫、京东等主流平台的品牌商家,为卖家节省将近85%的出图成本,提升约3倍出图效率,让品牌能够快速上架。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号