法线深度扩散模型:一个通用的法线深度扩散模型。

如果您熟悉中文,可以阅读中文版本的README。

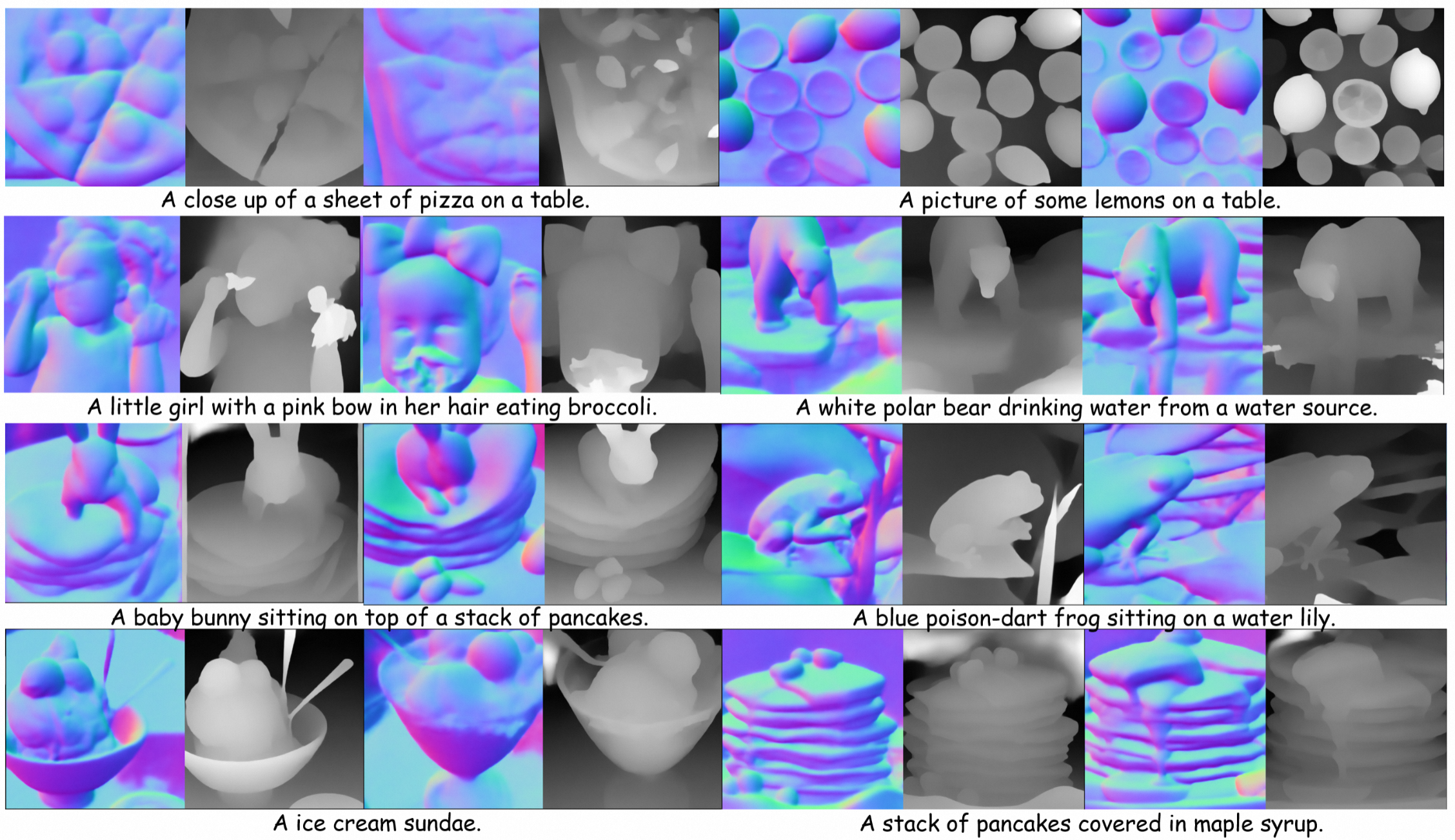

文本到法线深度

文本到多视角法线深度

<img src="https://yellow-cdn.veclightyear.com/835a84d5/8e0f9bee-4898-4e2a-92cf-51d8672a6995.jpg" alt="image" width="atuo" height="auto">项目页面 | 论文 | YouTube

- 推理代码

- 训练代码

- 预训练模型:ND、ND-MV、Albedo-MV

- 预训练模型:ND-MV-VAE

- Objaverse数据集的渲染多视角图像

新闻

- 2023-12-25:我们通过阿里云OSS服务发布了训练数据集mvs_objaverse。我们还提供了一个方便的多线程脚本用于快速下载。

- 2023-12-11:推理代码和预训练模型已发布。我们正在努力改进ND-Diffusion Model,敬请期待!

3D生成

- 本仓库仅包含RichDreamer论文中的扩散模型和2D图像生成代码�。

- 对于3D生成,请查看RichDreamer。

推理准备

- 使用以下脚本安装依赖项。

conda create -n nd conda activate nd pip install -r requirements.txt pip install git+https://github.com/openai/CLIP.git pip install git+https://github.com/CompVis/taming-transformers.git pip install webdataset pip install img2dataset

我们还提供了一个dockerfile来构建docker镜像。

sudo docker build -t mv3dengine_22.04:cu118 -f docker/Dockerfile .

- 下载预训练权重。

我们还提供了一个下载脚本。

python tools/download_models/download_nd_models.py

推理(采样)

我们提供了一个用于采样的脚本

sh demo_inference.sh

或使用以下详细说明:

文本到法线深度采样

# dmp求解器

python ./scripts/t2i.py --ckpt $ckpt_path --prompt $prompt --dpm_solver --n_samples 2 --save_dir $save_dir

# plms求解器

python ./scripts/t2i.py --ckpt $ckpt_path --prompt $prompt --plms --n_samples 2 --save_dir $save_dir

# ddim求解器

python ./scripts/t2i.py --ckpt $ckpt_path --prompt $prompt --n_samples 2 --save_dir $save_dir

文本到多视角法线深度采样

# nd-mv

python ./scripts/t2i_mv.py --ckpt_path $ckpt_path --prompt $prompt --num_frames 4 --model_name nd-mv --save_dir $save_dir

# nd-mv带VAE(即将推出)

python ./scripts/t2i_mv.py --ckpt_path $ckpt_path --prompt $prompt --num_frames 4 --model_name nd-mv-vae --save_dir $save_dir

文本到多视角反照率采样

python ./scripts/td2i_mv.py --ckpt_path $ckpt_path --prompt $prompt --depth_file $ depth_file --num_frames 4 --model_name albedo-mv --save_dir $save_dir

训练准备

- 下载Laion-2B-en-5-AES(训练ND模型所需)

从parquet下载laion-2b数据集

然后,将parquet文件放入./laion2b-dataset-5-aes

cd ./tools/download_dataset bash ./download_2b-5_aes.sh cd -

- 下载单目先验模型权重(训练ND模型所需)

- NormalBae scannet.pt

- Midas3.1 dpt_beit_large512.pt

# 将scannet.pt移动到normalbae先验模型 mv scannet.pt ./libs/ControlNet-v1-1-nightly/annotator/normalbae/scannet.pt # 将dpt_beit_large512.pt移动到./libs/omnidata_torch/pretrained_models/dpt_beit_large_512.pt mv dpt_beit_large512.pt ./libs/omnidata_torch/pretrained_models/dpt_beit_large_512.pt

- 下载Objaverse数据集的渲染多视角图像(训练ND-MV和Albedo-MV模型所需)

- 使用准备好的脚本下载我们的渲染数据集

wget https://virutalbuy-public.oss-cn-hangzhou.aliyuncs.com/share/aigc3d/valid_paths_v4_cap_filter_thres_28.json # 示例:python ./scripts/data/download_objaverse.py ./mvs_objaverse ./valid_paths_v4_cap_filter_thres_28.json 50 python ./scripts/data/download_objaverse.py /保存数据的路径 /valid_paths_v4_cap_filter_thres_28.json的路径 线程数(例如 10) # 如果将数据保存在其他位置,请设置一个链接 ln -s /保存数据的路径 mvs_objaverse # 说明文件 wget https://virutalbuy-public.oss-cn-hangzhou.aliyuncs.com/share/aigc3d/text_captions_cap3d.json

训练

训练法线深度VAE模型

- 下载在ImageNet上预训练的VAE权重。

- 修改

configs/autoencoder_normal_depth/autoencoder_normal_depth.yaml中的配置文件,设置model.ckpt_path=/预训练VAE权重的路径

# 训练VAE数据集 bash ./scripts/train_vae/train_nd_vae/train_rgbd_vae_webdatasets.sh \ model.params.ckpt_path=${预训练VAE权重} \ data.params.train.params.curls='path_laion/{00000..${:5 end_id}}.tar' \ --gpus 0,1,2,3,4,5,6,7

训练法线深度扩散模型

在训练并获得法线深度VAE模型后,或者您可以从ND-VAE下载

# 第一步 export SD-MODEL-PATH=/sd-1.5的路径 bash scripts/train_normald_sd/txt_cond/web_datasets/train_normald_webdatasets.sh --gpus 0,1,2,3,4,5,6,7 \ model.params.first_stage_ckpts=${法线深度VAE} model.params.ckpt_path=${SD-MODEL-PATH} \ data.params.train.params.curls='path_laion/{00000..${:5 end_id}}.tar' # 第二步 在./configs/stable-diffusion/normald/sd_1_5/txt_cond/web_datasets/laion_2b_step2.yaml中修改您的step_weights路径 bash scripts/train_normald_sd/txt_cond/web_datasets/train_normald_webdatasets_step2.sh --gpus 0,1,2,3,4,5,6,7 \ model.params.first_stage_ckpts=${法线深度VAE} \ model.params.ckpt_path=${预训练步骤权重} \ data.params.train.params.curls='path_laion/{00000..${:5 end_id}}.tar'

训练多视角法线深度扩散模型

在训练并获得法线深度扩散模型后,或者您可以从ND下载,

我们提供两个版本的多视角法线深度扩散模型

a. 不带VAE去噪 b. 带VAE去噪

在当前版本中,我们提供不带VAE去噪的版本

# a. 训练不带VAE版本 bash ./scripts/train_normald_sd/txt_cond/objaverse/objaverse_finetune_wovae_mvsd-4.sh --gpus 0,1,2,3,4,5,6,7, \ model.params.ckpt_path=${法线深度扩散} # b. 训练带VAE版本 bash ./scripts/train_normald_sd/txt_cond/objaverse/objaverse_finetune_mvsd-4.sh --gpus 0,1,2,3,4,5,6,7, \ model.params.ckpt_path=${法线深度扩散}

训练多视角深度条件反照率扩散模型

在训练并获得法线深度扩散模型后,或者您可以从ND下载,

bash scripts/train_abledo/objaverse/objaverse_finetune_mvsd-4.sh --gpus 0,1,2,3,4,5,6,7, model.params.ckpt_path=${法线深度扩散}

致谢

我们大量借鉴了以下代码库。非常感谢这些作者分享他们的代码。

引用

@article{qiu2023richdreamer,

title={RichDreamer: A Generalizable Normal-Depth Diffusion Model for Detail Richness in Text-to-3D},

author={Lingteng Qiu and Guanying Chen and Xiaodong Gu and Qi zuo and Mutian Xu and Yushuang Wu and Weihao Yuan and Zilong Dong and Liefeng Bo and Xiaoguang Han},

year={2023},

journal = {arXiv preprint arXiv:2311.16918}

}

编辑推荐精选

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

Refly.AI

最适合小白的AI自动化工作流平台

无需编码,轻松生成可复用、可变现的AI自动化工作流

酷表ChatExcel

大模型驱动的Excel数据处理工具

基于大模型交互的表格处理系统,允许用户通过对话方式完成数据整理和可视化分析。系统采用机器学习算法解析用户指令,自动执行排序、公式计算和数据透视等操作,支持多种文件格式导入导出。数据处理响应速度保持在0.8秒以内,支持超过100万行数据的即时分析。

TRAE编程

AI辅助编程,代码自动修复

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

AIWritePaper论文写作

AI论文写作指导平台

AIWritePaper论文写作是一站式AI论文写作辅助工具,简化了选题、文献检索至论文撰写的整个过程。通过简单设定,平台可快速生成高质量论文大纲和全文,配合图表、参考文献等一应俱全,同时提供开题报告和答辩PPT等增值服务,保障数据安全,有效提升写作效率和论文质量。

博思AIPPT

AI一键生成PPT,就用博思AIPPT!

博思AIPPT,新一代的AI生成PPT平台,支持智能生成PPT、AI美化PPT、文本&链接生成PPT、导入Word/PDF/Markdown文档生成PPT等,内置海量精美PPT模板,涵盖商务、教育、科技等不同风格,同时针对每个页面提供多种版式,一键自适应切换,完美适配各种办公场景。

潮际好麦

AI赋能电商视觉革命,一站式智能商拍平台

潮际好麦深耕服装行业,是国内AI试衣效果最好的软件。使用先进AIGC能力为电商卖家批量提供优质的、低成本的商拍图。合作品牌有Shein、Lazada、安踏、百丽等65个国内外头部品牌,以及国内10万+淘宝、天猫、京东等主流平台的品牌商家,为卖家节省将近85%的出图成本,提升约3倍出图效率,让品牌能够快速上架。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号