llrt

为Serverless应用打造的高性能JavaScript运行时

LLRT是专为Serverless应用设计的轻量级JavaScript运行时。基于QuickJS引擎,LLRT在AWS Lambda上实现了比其他JavaScript运行时高达10倍的启动速度和2倍的成本降低。它支持ES2023标准,集成多个AWS SDK客户端,为Serverless开发提供高性能和兼容性。

LLRT(Low Latency Runtime,低延迟运行时)是一个轻量级JavaScript运行时,旨在满足对快速高效的无服务器应用程序日益增长的需求。与在AWS Lambda上运行的其他JavaScript运行时相比,LLRT的启动速度最高可提升10倍,总体成本最多可降低2倍。

它使用Rust构建,采用QuickJS作为JavaScript引擎,确保高效的内存使用和快速启动。

[!警告] LLRT是一个实验性包。它可能会发生变化,仅供评估使用。

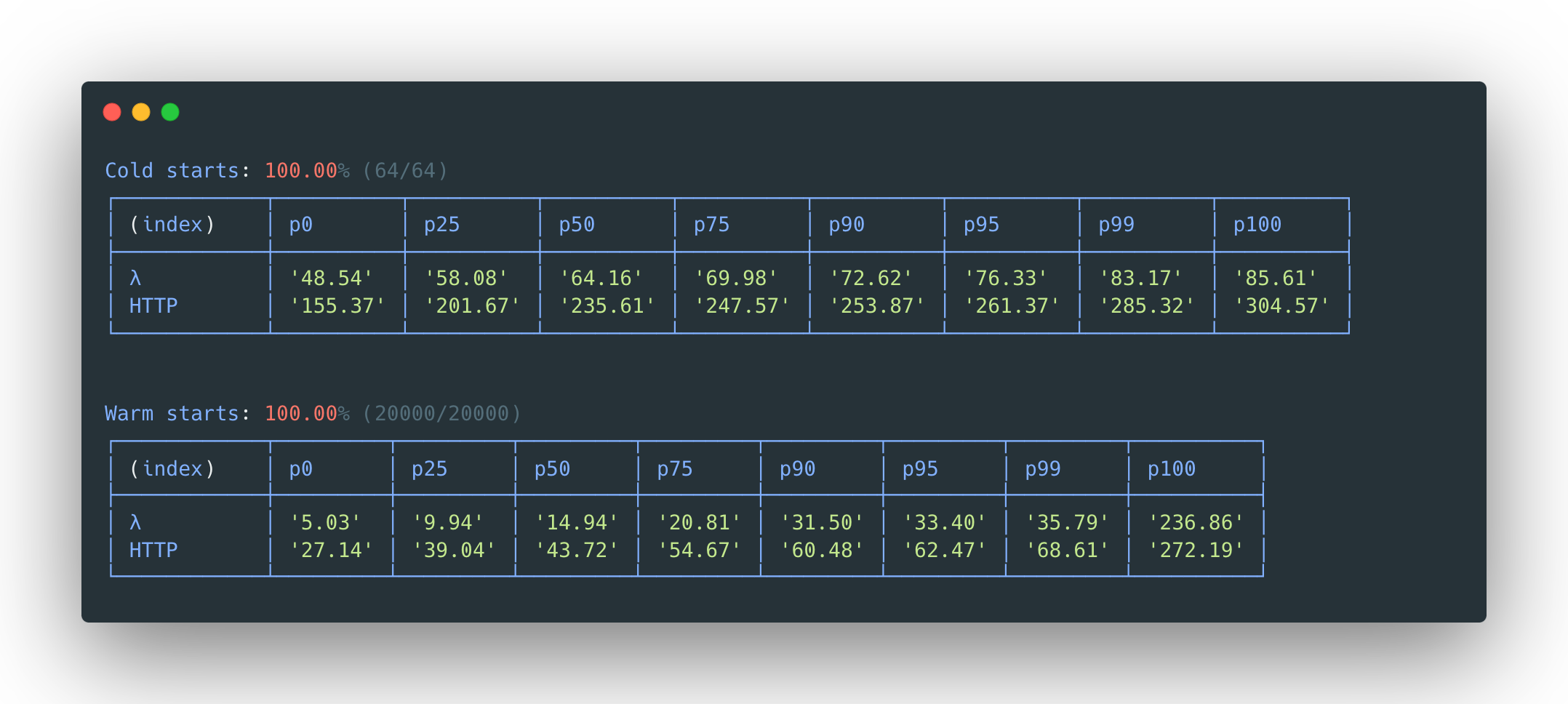

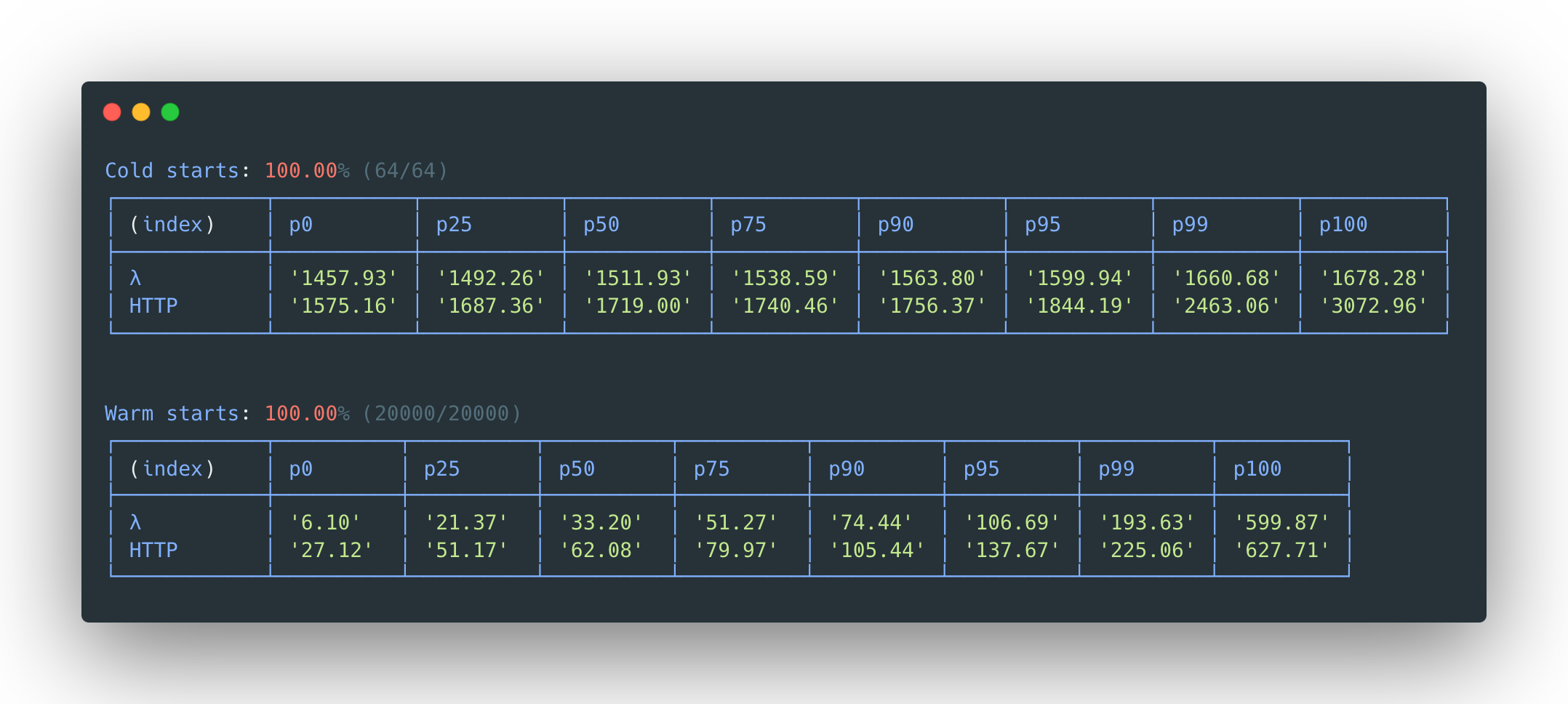

<sub>LLRT - DynamoDB Put, ARM, 128MB:<sub>

<sub>Node.js 20 - DynamoDB Put, ARM, 128MB:<sub>

HTTP基准测试以冷启动的往返时间为单位(原因请参见为什么?)

配置Lambda函数以使用LLRT

从 https://github.com/awslabs/llrt/releases 下载最新的LLRT版本

选项1:自定义运行时(推荐)

选择"Amazon Linux 2023上的自定义运行时",并将LLRT的bootstrap二进制文件与您的JS代码一起打包�。

选项2:使用层

选择"Amazon Linux 2023上的自定义运行时",上传llrt-lambda-arm64.zip或llrt-lambda-x64.zip作为层,并添加到您的函数中。

选项3:将LLRT打包到容器镜像中

参见我们的AWS SAM示例或:

FROM busybox WORKDIR /var/task/ COPY app.mjs ./ ADD https://github.com/awslabs/llrt/releases/latest/download/llrt-container-arm64 /usr/bin/llrt RUN chmod +x /usr/bin/llrt ENV LAMBDA_HANDLER "app.handler" CMD [ "llrt" ]

选项4:AWS SAM

以下示例项目设置了一个包含llrt运行时层的lambda函数。

选项5:AWS CDK

您可以使用cdk-lambda-llrt构造库通过AWS CDK部署LLRT Lambda函数。

import { LlrtFunction } from "cdk-lambda-llrt"; const handler = new LlrtFunction(this, "Handler", { entry: "lambda/index.ts", });

有关更多详情�,请参阅Construct Hub和其示例。

就是这样 🎉

[!重要] 尽管LLRT支持ES2023,但它不是Node.js的直接替代品。请参阅兼容性矩阵和API了解更多详情。 所有依赖项都应该为

browser平台打包,并将包含的@aws-sdk包标记为外部依赖。

测试和确保兼容性

确保您的代码与LLRT兼容的最佳方法是编写测试并使用内置的测试运行器执行它们。测试运行器目前支持Jest/Chai断言。您可以创建两种主要类型的测试:

单元测试

- 用于独立验证特定模块和函数

- 允许集中测试单个组件

端到端(E2E)测试

- 验证与AWS SDK的整体兼容性和WinterCG合规性

- 测试所有组件之间的集成

- 确认从最终用户角度的预期行为

有关E2E测试的更多信息及如何运行它们,请参见此处。

测试运行器

测试运行器使用轻量级的Jest风格API,并支持Jest/Chai断言。有关如何为LLRT实现测试的示例,请参见本仓库的/tests文件夹。

要运行测试,请执行llrt test命令。LLRT会扫描当前目录及子目录中以*.test.js或*.test.mjs结尾的文件。您也可以使用llrt test -d <directory>选项指定要扫描的特定测试目录。

测试运行器还支持过滤器。使用过滤器非常简单,只需添加额外的命令行参数,例如:llrt test crypto将只运行文件名包含crypto的测试。

兼容性矩阵

[!注意] LLRT仅支持Node.js API的一小部分。它不是Node.js的直接替代品,也永远不会是。以下是部分支持的API和模块的高级概述。更多详情请参阅API文档 | | Node.js | LLRT ⚠️ | | ------------- | ------- | ------- | | buffer | ✔︎ | ✔︎️ | | streams | ✔︎ | ✔︎* | | child_process | ✔︎ | ✔︎⏱ | | net:sockets | ✔︎ | ✔︎⏱ | | net:server | ✔︎ | ✔︎ | | tls | ✔︎ | ✘⏱ | | fetch | ✔︎ | ✔︎ | | http | ✔︎ | ✘⏱** | | https | ✔︎ | ✘⏱** | | fs/promises | ✔︎ | ✔︎ | | fs | ✔︎ | ✘⏱ | | path | ✔︎ | ✔︎ | | timers | ✔︎ | ✔︎ | | crypto | ✔︎ | ✔︎ | | process | ✔︎ | ✔︎ | | encoding | ✔︎ | ✔︎ | | console | ✔︎ | ✔︎ | | events | ✔︎ | ✔︎ | | zlib | ✔︎ | ✔︎ | | ESM | ✔︎ | ✔︎ | | CJS | ✔︎ | ✔︎ | | async/await | ✔︎ | ✔︎ | | Other modules | ✔︎ | ✘ |

⚠️ = LLRT 部分支持 ⏱ = 计划部分支持 * = 非原生 ** = 请使用 fetch 替代

在 LLRT 中使用 node_modules(依赖项)

由于 LLRT 旨在用于性能关键的应用程序,因此不建议在没有打包、压缩和树摇优化的情况下部署 node_modules。

LLRT 可以与任何您选择的打包工具一起使用。以下是一些流行打包工具的配置:

[!警告] LLRT 实现了与以下外部包在很大程度上兼容的原生模块。 通过在打包工具的别名函数中实现以下转换,您的应用程序可能会更快,但我们建议您进行彻底测试,因为它们并非完全兼容。

| Node.js | LLRT |

|---|---|

| fast-xml-parser | llrt:xml |

| uuid | llrt:uuid |

ESBuild

esbuild index.js --platform=node --target=es2023 --format=esm --bundle --minify --external:@aws-sdk --external:@smithy

Rollup

import resolve from "@rollup/plugin-node-resolve"; import commonjs from "@rollup/plugin-commonjs"; import terser from "@rollup/plugin-terser"; export default { input: "index.js", output: { file: "dist/bundle.js", format: "esm", sourcemap: true, target: "es2023", }, plugins: [resolve(), commonjs(), terser()], external: ["@aws-sdk", "@smithy"], };

Webpack

import TerserPlugin from "terser-webpack-plugin"; import nodeExternals from "webpack-node-externals"; export default { entry: "./index.js", output: { path: "dist", filename: "bundle.js", libraryTarget: "module", }, target: "web", mode: "production", resolve: { extensions: [".js"], }, externals: [nodeExternals(), "@aws-sdk", "@smithy"], optimization: { minimize: true, minimizer: [ new TerserPlugin({ terserOptions: { ecma: 2023, }, }), ], }, };

在 LLRT 中使用 AWS SDK (v3)

LLRT 在运行时中包含了许多 AWS SDK 客户端和工具,它们已内置到可执行文件中。这些 SDK 客户端经过专门优化,以提供最佳性能,同时不影响兼容性。LLRT 用原生实现替换了 AWS SDK 使用的一些 JavaScript 依赖项,如哈希计算和 XML 解析。 下面列表中未包含的 V3 SDK 包需要与您的源代码一起打包。有关如何使用未包含的 SDK 的示例,请参阅此示例构建脚本 (buildExternalSdkFunction)

| 已打包的 AWS SDK 包 |

|---|

| @aws-sdk/client-cloudwatch-events |

| @aws-sdk/client-cloudwatch-logs |

| @aws-sdk/client-cognito-identity |

| @aws-sdk/client-cognito-identity-provider |

| @aws-sdk/client-dynamodb |

| @aws-sdk/client-eventbridge |

| @aws-sdk/client-kms |

| @aws-sdk/client-lambda |

| @aws-sdk/client-s3 |

| @aws-sdk/client-secrets-manager |

| @aws-sdk/client-ses |

| @aws-sdk/client-sfn |

| @aws-sdk/client-sns |

| @aws-sdk/client-sqs |

| @aws-sdk/client-ssm |

| @aws-sdk/client-sts |

| @aws-sdk/client-xray |

| @aws-sdk/credential-providers |

| @aws-sdk/lib-dynamodb |

| @aws-sdk/lib-storage |

| @aws-sdk/s3-presigned-post |

| @aws-sdk/s3-request-presigner |

| @aws-sdk/util-dynamodb |

| @aws-sdk/util-user-agent-browser |

| @smithy |

| @aws-crypto |

[!重要] LLRT 目前不支持从 SDK 响应中返回流。请使用

response.Body.transformToString();或response.Body.transformToByteArray();,如下所示。const response = await client.send(command); // 或 'transformToByteArray()' const str = await response.Body.transformToString();

在 LLRT 中运行 TypeScript

使用 TypeScript 时适用与依赖项相同的原则。TypeScript 必须打包并转译为 ES2023 JavaScript。

[!注意] LLRT 不会支持在不进行转译的情况下运行 TypeScript。这是出于性能考虑而设计的。转译需要 CPU 和内存,这会在执行过程中增加延迟和成本。如果在部署期间提前完成,就可以避免这种情况。

理由

鉴于现有的选项如 Node.js、Bun 和 Deno,是什么原因证明引入另一个 JavaScript 运行时是合理的? Node.js、Bun和Deno是性能卓越的JavaScript运行时。然而,它们�设计初衷是用于通用应用场景。这些运行时并非专门为短暂运行实例的Serverless环境需求而定制。它们都依赖于即时编译器(JIT)在执行过程中进行动态代码编译和优化。尽管JIT编译提供了显著的长期性能优势,但它也带来了计算和内存开销。

相比之下,LLRT的独特之处在于不包含JIT编译器,这一策略性决定带来了两个重要优势:

A) JIT编译是一项非常复杂的技术组件,增加了系统复杂性,并显著增加了运行时的整体大小。

B) 没有JIT开销,LLRT可以节省CPU和内存资源,这些资源可以更有效地分配给代码执行任务,从而缩短应用启动时间。

局限性

在许多情况下,LLRT相比支持JIT的运行时表现出明显的性能劣势,比如大规模数据处理、蒙特卡洛模拟或执行数十万乃至数百万次迭代的任务。LLRT最适用于较小的Serverless函数,专注于数据转换、实时处理、AWS服务集成、授权、验证等任务。它旨在补充现有组件,而非全面替代一切。值得注意的是,由于其支持的API基于Node.js规范,切换回其他解决方案只需进行最小的代码调整。

从源码构建

克隆代码并进入目录

git clone git@github.com:awslabs/llrt.git --recursive

cd llrt

如果您没有使用--recursive克隆仓库,请安装git子模块

git submodule update --init

安装rust

curl --proto '=https' --tlsv1.2 -sSf https://sh.rustup.rs | bash -s -- -y

source "$HOME/.cargo/env"

安装依赖

# MacOS

brew install zig make cmake zstd node corepack

# Ubuntu

sudo apt -y install make zstd

sudo snap install zig --classic --beta

# Windows WSL2

sudo apt -y install cmake g++ gcc make zip zstd

sudo snap install zig --classic --beta

# Windows WSL2 (如果尚未安装Node.js)

sudo curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/master/install.sh | bash

nvm install --lts

安装Node.js包

corepack enable

yarn

生成库并设置rust目标和工具链

make stdlib && make libs

[!注意] 如果这些命令退出时报错"can't cd to zstd/lib", 说明您没有递归克隆此仓库。运行

git submodule update --init下载子模块,然后重新运行上述命令。

为Lambda构建发布版本

make release-arm64

# 或者对于x86-64,使用

make release-x64

可选地为您的本地机器(Mac或Linux)构建

make release

现在您应该得到了llrt-lambda-arm64.zip或llrt-lambda-x64.zip。您可以手动上传这个文件作为Lambda层,或通过基础设施即代码管道使用它。

运行Lambda模拟器

请注意,要运行示例,您需要:

- 通过

~/.aws/credentials或环境变量提供有效的AWS凭证。

export AWS_ACCESS_KEY_ID=XXX export AWS_SECRET_ACCESS_KEY=YYY export AWS_REGION=us-east-1

- 在

us-east-1区域有一个DynamoDB表(以id作为分区键) - 对该表有

dynamodb:PutItemIAM权限。您可以使用这个策略(别忘了修改<YOUR_ACCOUNT_ID>):

{ "Version": "2012-10-17", "Statement": [ { "Sid": "putItem", "Effect": "Allow", "Action": "dynamodb:PutItem", "Resource": "arn:aws:dynamodb:us-east-1:<YOUR_ACCOUNT_ID>:table/quickjs-table" } ] }

在单独的终端中启动lambda-server.js

node lambda-server.js

然后运行llrt:

make run

环境变量

LLRT_EXTRA_CA_CERTS=file

从PEM编码文件加载额外的证书颁发机构

LLRT_GC_THRESHOLD_MB=value

设置垃圾回收的内存阈值(单位:MB)。默认阈值为20MB

LLRT_HTTP_VERSION=value

限制HTTP请求使用特定版本。默认启用HTTP 1.1和2。将此变量设置为1.1只使用HTTP 1.1

LLRT_LOG=[target][=][level][,...]

按目标模块、级别或两者(使用=)过滤日志输出。日志级别不区分大小写,并且会启用任何更高优先级的日志。

日志级别按降序优先级排列:

ErrorWarn | WarningInfoDebugTrace

过滤器示例:

warn将启用所有警告和错误日志llrt_core::vm=trace将启用llrt_core::vm模块中的所有日志warn,llrt_core::vm=trace将启用llrt_core::vm模块中的所有日志,以及其他模块中的所有警告和错误日志

LLRT_NET_ALLOW="host[ ...]"

允许网络连接的主机或套接字路径的空格分隔列表。不在此列表中的任何主机或套接字路径的网络连接将被拒绝。设置空列表以拒绝所有连接

LLRT_NET_DENY="host[ ...]"

应被拒绝网络连接的�主机或套接字路径的空格分隔列表

LLRT_NET_POOL_IDLE_TIMEOUT=value

设置保持活动状态的空闲套接字的超时时间(单位:秒)。默认超时时间为15秒

LLRT_TLS_VERSION=value

设置用于网络连接的TLS版本。默认仅启用TLS 1.2。也可以通过将此变量设置为1.3来启用TLS 1.3

基准测试方法

尽管Lambda报告的初始化时长常用于理解冷启动对整体请求延迟的影响,但这个指标不包括将代码复制到Lambda沙箱所需的时间。

初始化时长的技术定义(来源):

对于第一个处理的请求,运行时加载函数并运行处理程序方法之外的代码所需的时间。 测量往返请求时长可以更全面地了解用户面对的冷启动延迟情况。

Lambda调用结果(标有λ的行)报告的是初始化时长和函数执行时长的总和。

安全

有关更多信息,请参阅贡献指南。

许可证

本库采用Apache-2.0许可证授权。详情请见许可证文件。

编辑推荐精选

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

Refly.AI

最适合小白的AI自动化工作流平台

无需编码,轻松生成可复用、可变现的AI自动化工作流

酷表ChatExcel

大模型驱动的Excel数据处理工具

基于大模型交互的表格处理系统,允许用户通过对话方式完成数据整理和可视化分析。系统采用机器学习算法解析用户指令,自动执行排序、公式计算和数据透视等操作,支持多种文件格式导入导出。数据处理响应速度保持在0.8秒以内,支持超过100万行数据的即时分析。

TRAE编程

AI辅助编程,代码自动修复

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

AIWritePaper论文写作

AI论文写作指导平台

AIWritePaper论文写作是一站式AI论文写作辅助工具,简化了选题、文献检索至论文撰写的整个过程。通过简单设定,平台可快速生成高质量论文大纲和全文,配合图表、参考文献等一应俱全,同时提供开题报告和答辩PPT等增值服务,保障数据安全,有效提升写作效率和论文质量。

博思AIPPT

AI一键生成PPT,就用博思AIPPT!

博思AIPPT,新一代的AI生成PPT平台,支持智能生成PPT、AI美化PPT、文本&链接生成PPT、导入Word/PDF/Markdown文档生成PPT等,内置海量精美PPT模板,涵盖商务、教育、科技等不同风格,同时针对每个页面提供多种版式,一键自适应切换,完美适配各种办公场景。

潮际好麦

AI赋能电商视觉革命,一站式智能商拍平台

潮际好麦深耕服装行业,是国内AI试衣效果最好的软件。使用先进AIGC能力为电商卖家批量提供优质的、低成本的商拍图。合作品牌有Shein、Lazada、安踏、百丽等65个国内外头部品牌,以及国内10万+淘宝、天猫、京东等主流平台的品牌商家,为卖家节省将近85%的出图成本,提升约3倍出图效率,让品牌��能够快速上架。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号