AniTalker

面部动画生成技术通过解耦身份和运动编码实现多样化表现

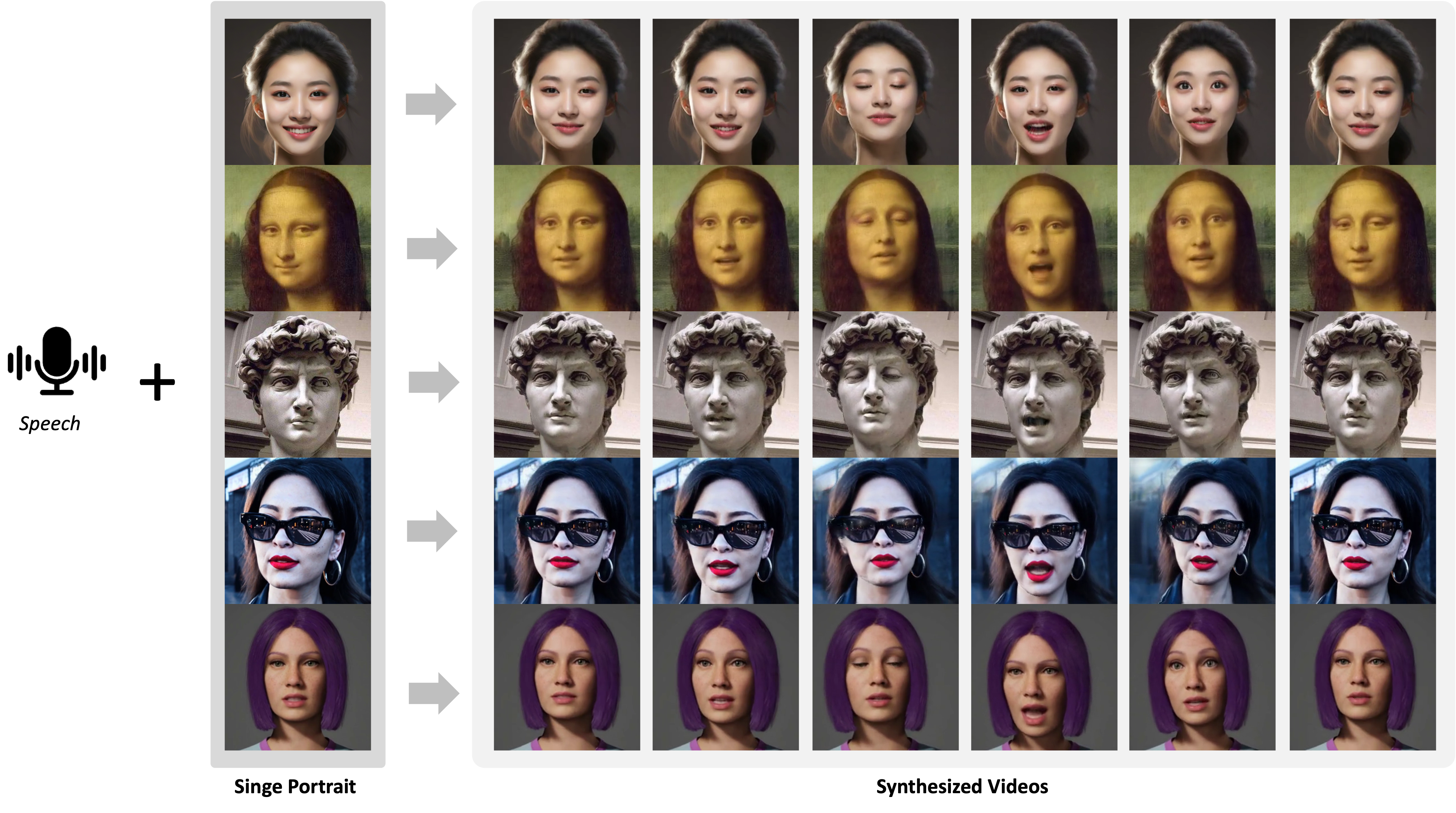

AniTalker是一个面部动画生成项目,通过解耦身份和面部运动编码实现多样化的说话面部动画。该技术根据音频和图像生成说话头像,支持控制头部姿态、位置和缩放。项目提供多个预训练模型,包括基于Hubert和MFCC的音频特征提取,适用于不同场景。AniTalker为创作和研究提供了生成说话面部动画的工具。

<a href="https://trendshift.io/repositories/10102" target="_blank"><img src="https://trendshift.io/api/badge/repositories/10102" alt="X-LANCE%2FAniTalker | Trendshift" style="width: 250px; height: 55px;" width="250" height="55"/></a>

AniTalker

通过身份解耦的面部运动编码实现生动多样的会说话的面孔动画

<div align="center"> <!-- <a href='LICENSE' target="_blank"><img src='https://img.shields.io/badge/license-MIT-yellow'></a> --> <a href='https://arxiv.org/abs/2405.03121' target="_blank"><img src='https://img.shields.io/badge/arXiv-AniTalker-red'></a> <a href='https://x-lance.github.io/AniTalker/' target="_blank"><img src='https://img.shields.io/badge/Project-AniTalker-green'></a> <a href='https://huggingface.co/spaces/Delik/Anitalker'><img src='https://img.shields.io/badge/%F0%9F%A4%97%20Hugging%20Face-Spaces-blue'></a> <a href="https://colab.research.google.com/github/yuhanxu01/AniTalker/blob/main/AniTalker_demo.ipynb" target="_blank"><img src="https://yellow-cdn.veclightyear.com/ab5030c0/72756424-2878-4595-a36b-17f9239cf8fc.svg"></a> <a href="https://github.com/X-LANCE/AniTalker" target="_blank"><img src="https://img.shields.io/github/stars/X-LANCE/AniTalker"></a> </div> <br>

论文的更新版本将稍后上传

</div>更新

- [2024.08.10] Windows教程更新(由newgenai79提供)

- [2024.08.10] MacOS教程更新(由airwzz999提供)

- [2024.08.09] Huggingface Space更新(由Delik提供)

- [2024.08.02] Web界面更新(由yuhanxu01提供)

- [2024.08.01] Codelab更新(由yuhanxu01提供)

- [2024.08.01] Windows视频教程(由nitinmukesh贡献)

- [2024.07.31] 添加了Hubert特征提取代码和环境设置说明

环境安装

conda create -n anitalker python==3.9.0 conda activate anitalker conda install pytorch==1.8.0 torchvision==0.9.0 torchaudio==0.8.0 cudatoolkit=11.1 -c pytorch -c conda-forge pip install -r requirements.txt

Windows教程(由newgenai79提供)

模型库

请从此链接下载检查点并将它们放入ckpts文件夹

[中文用户] 对于中国用户,我们建议您访问这里下载。

ckpts/

├── chinese-hubert-large

├──── config.json

├──── preprocessor_config.json

├──── pytorch_model.bin

├── stage1.ckpt

├── stage2_pose_only_mfcc.ckpt

├── stage2_full_control_mfcc.ckpt

├── stage2_audio_only_hubert.ckpt

├── stage2_pose_only_hubert.ckpt

└── stage2_full_control_hubert.ckpt

模型描述:

| 阶段 | 模型名称 | 仅音频推理 | 额外控制信号 |

|---|---|---|---|

| 第一阶段 | stage1.ckpt | - | 动作编码器和图像渲染器 |

| 第二阶段(Hubert) | stage2_audio_only_hubert.ckpt | 是 | - |

| 第二阶段(Hubert) | stage2_pose_only_hubert.ckpt | 是 | 头部姿态 |

| 第二阶段(Hubert) | stage2_full_control_hubert.ckpt | 是 | 头部姿态/位置/缩放 |

| 第二阶段(MFCC) | stage2_pose_only_mfcc.ckpt | 是 | 头部姿态 |

| 第二阶段(MFCC) | stage2_full_control_mfcc.ckpt | 是 | 头部姿态/位置/缩放 |

stage1.ckpt在单图像视频数据集上训练,旨在学习动作的迁移。训练后,它利用动作编码器(用于提取与身份无关的动作)和图像渲染器。- 以

stage2开头的模型在带有音频的视频数据集上训练,除非另有说明,均从头开始训练。 stage2_audio_only_hubert.ckpt输入音频特征为Hubert,没有任何控制信号。适用于面部朝前的场景,相比可控制模型,需要较少的参数调整即可获得满意结果。[我们建议从这个��模型开始]stage2_pose_only_hubert.ckpt与stage2_pose_only_mfcc.ckpt类似,区别在于音频特征为Hubert。与仅音频模型相比,它包含姿态控制信号。stage2_more_controllable_hubert.ckpt与stage2_more_controllable_mfcc.ckpt类似,但使用Hubert作为音频特征。stage2_pose_only_mfcc.ckpt输入音频特征为MFCC,并包含姿态控制信号(偏航、俯仰、翻滚角度)。[MFCC模型性能较差,不建议使用。]stage2_more_controllable_mfcc.ckpt输入音频特征为MFCC,除姿态外还添加了面部位置和面部缩放的控制信号。chinese-hubert-large用于提取音频特征。

快速指南:

- 考虑到可用性和模型性能,我们推荐使用

stage2_audio_only_hubert.ckpt。 - 如果您需要更多控制,请使用带有可控制后缀的模型。可控制模型通常表现力更强,但需要更多参数调整。

- 所有stage2模型在禁用控制标志的情况下也可以仅通过音频生成。

运行演示

主要推理脚本(Hubert,更好的结果 💪)- 推荐

python ./code/demo.py \

--infer_type 'hubert_audio_only' \

--stage1_checkpoint_path 'ckpts/stage1.ckpt' \

--stage2_checkpoint_path 'ckpts/stage2_audio_only_hubert.ckpt' \

--test_image_path 'test_demos/portraits/monalisa.jpg' \

--test_audio_path 'test_demos/audios/monalisa.wav' \

--test_hubert_path 'test_demos/audios_hubert/monalisa.npy' \

--result_path 'outputs/monalisa_hubert/'

-

您只需配置两项:

test_image_path(您想驱动的图像)和test_audio_path(用于驱动图像的音频)。其他参数如姿态和眨眼都由模型自行采样! -

生成的示例视频将保存到 outputs/monalisa_hubert/monalisa-monalisa.mp4。

-

对于只控制姿势的Hubert案例,请参见 more_hubert_cases_pose_only。

-

对于控制姿势/面部的Hubert案例,请参见 more_hubert_cases_more_control。

| 单张肖像 | 结果 |

|---|---|

| <img src="https://yellow-cdn.veclightyear.com/ab5030c0/53b02911-f5b1-4d5f-9a5c-102b8b7ec13b.jpg" width="200" ></img> | <img src="https://yellow-cdn.veclightyear.com/ab5030c0/f7f8091a-890c-4f9f-94bb-db4cab9d7a1b.gif" width="200" ></img> |

用户提交画廊

<table class="center"> <tr> <th width=30% style="border: none">肖像</th> <th width=30% style="border: none">结果 (256*256)</th> <th width=25% style="border: none">结果 (512*512)</th> <th width=5% style="border: none">脚本</th> </tr> <tr> <td width=30% style="border: none"> <img src="https://yellow-cdn.veclightyear.com/ab5030c0/35a649a9-ef42-465f-9767-d51fff37ad70.png" width="200" ></img> </td> <td width=30% style="border: none"> <video controls loop src="https://github.com/user-attachments/assets/1b84abb3-c553-4c5b-a969-36843b186dbe" muted="false"></video> </td> <td width=25% style="border: none"> <video controls loop src="https://github.com/user-attachments/assets/3776d05a-b23e-482c-b466-cfc12feea9eb" muted="false"></video> </td> <td width=5% style="border: none"> <a href="https://github.com/X-LANCE/AniTalker/issues/20"> 链接</a> </td> </tr>您可以通过issue提交您的演示。

</table>主要推理脚本 (MFCC,更快 🚀) - 不推荐

[注意] Hubert模型是我们的默认模型。为了环境方便,我们提供了一个MFCC版本,但我们发现Hubert模型的使用率不高,人们仍然更多地使用MFCC。MFCC的效果较差。这违背了我们的初衷,所以我们已经弃用了这个模型。我们建议您从hubert_audio_only模型开始测试。谢谢。

[早期用户升级] 重新下载带有Hubert模型的检查点到ckpts目录,并额外安装 pip install transformers==4.19.2。当代码未检测到Hubert路径时,它会自动提取并提供如何解决遇到的任何错误的额外说明。

面部超分辨率(可选)

目的是将分辨率从256提升到512,并解决模糊渲染的问题。

请在此安装额外的环境:

pip install facexlib

pip install tb-nightly -i https://mirrors.aliyun.com/pypi/simple

pip install gfpgan

# 忽略以下警告:

# espnet 202301 需要 importlib-metadata<5.0,但你有 importlib-metadata 7.1.0,这是不兼容的。

然后在脚本中启用 --face_sr 选项。第一次运行将下载gfpgan的权重。

最佳实践

<details><summary>1. 使用与肖像相似的姿势</summary> [此建议仅适��用于具有姿势控制的模型] 为避免潜在的变形问题(主要由2D包裹引起),建议保持生成的面部角度接近原始肖像角度,或仅允许轻微的角度变化。例如,如果肖像中的面部最初向左旋转,建议使用向左旋转的面部以获得最佳结果。具体来说,向左旋转的面部相当于将yaw值调整到-1和0之间(代表-90到0度的yaw变化)。特别是对于HDTF数据集,建议将pose_yaw、pose_pitch和pose_roll保持在0,因为该数据集主要由正面面孔组成。 </details> <details><summary>2. 保持头部在画面中居中</summary> 我们的模型在训练时首先检测面部,然后估计头部位置,大多数头部位于画面中心。因此,请尽可能保持头部居中(这与面部对齐不同)。参考[面部裁剪代码](https://github.com/liutaocode/talking_face_preprocessing?tab=readme-ov-file#facial-part-cropping)中的具体裁剪位置。将头部放在其他位置或面部过大可能会导致一些失真。 </details> <details><summary>3. 使用英语语音</summary> 我们的模型主要在英语语音内容上训练,对其他语言的接触很少。因此,最佳实践之一是使用英语音频来驱动模型。如果使用其他语言,我们观察到生成的嘴唇轻微移动或导致图像扭曲和变形等问题。 </details> <details><summary>4. 增强沉浸感</summary> 我们发现直视前方可以大大增强生成视频的沉浸感。由于我们的模型不对目光建模,有时会导致空洞或无焦点的眼神,这可能导致沉浸感较差。我们建议控制信号以确保目光尽可能朝向前方。此外,参考一些目光建模算法可能有所帮助,例如[vasa-1](https://www.microsoft.com/en-us/research/project/vasa-1/)和[PD-FGC](https://github.com/Dorniwang/PD-FGC-inference),这是由[tanshuai0219](https://github.com/tanshuai0219)推荐的,可能对目光建模有潜在的改进。 </details>待办事项

- 考虑为第一帧添加自动校准,考虑到初始面部位置和形状对结果有一定影响。

我们欢迎对仓库的任何贡献。

问题

<details><summary>1. MFCC和Hubert特征有什么区别?</summary> `MFCC`和`Hubert`都是用于语音分析的前端特征,用于从音频信号中提取特征。`Hubert`特征虽然稳健,但需要大量的环境依赖,并消耗相当多的磁盘空间。因此,为了效率和确保所有用户都能快速访问推理,我们用更轻量级的`MFCC`替代了`Hubert`特征。虽然`MFCC`特征更容易收敛,但表达能力较弱,在跨语言推理方面的表现不如`Hubert`。此外,在文本到语音(TTS)音频和静音片段中可能出现抖动、过度平滑或过度夸张的表情等伪影。 </details> <details><summary>2. 如何应用于更高分辨率?</summary> 我们生成输出的基本分辨率仅为256×256。如果您需要更高的分辨率(例如512×512),可以参考<a href="https://github.com/OpenTalker/SadTalker">SadTalker</a>中的超分辨率模块。通过在上述管道末端整合超分辨率模块,您可以实现更高分辨率的输出。我们也在我们的代码中集成了这个模块。 </details> <details><summary>3. 如何自动提取或控制其他面部角度?</summary> 如果需要自动控制面部,您可以使用姿态提取算法来实现,例如提取另一个人的姿态来驱动肖像。提取流程的算法已经开源,可以在<a href="https://github.com/liutaocode/talking_face_preprocessing?tab=readme-ov-file#face-orientation-angles">这个链接</a>找到。 </details> <details><summary>4. 未来会发布其他资源吗?</summary> 由于逼真模型可能带来的风险和伦理问题,我们目前决定不分发额外资源,如训练脚本和其他检查点。对于这一决定可能造成的不便,我们深表歉意。 </details>模型偏差/局限性

关于本库提供的检查点,我们在测试各种音频剪辑和图像时遇到的问题揭示了模型偏差。这些偏差主要是由训练数据集或模型容量造成的,包括但不限于以下几点:

- 数据集处理面部及其周围区域,不涉及全身或上半身。

- 数据集主要包含英语,非英语或方言的实例有限。

- 数据集在处理时使用相对理想的条件,不考虑剧烈变化。

- 数据集主要关注正常说话速度的语音内容,不考虑不同语速或非语音场景。

- 数据集仅接触特定人群,可能对不同种族或年龄群体产生偏见。

- 渲染模型无法建模多视角对象。有时无法将人物与背景分离,特别是无法有效分离人物的配饰和发型。

请根据上述考虑因素谨慎生成内容。

引用

@misc{liu2024anitalker,

title={AniTalker: Animate Vivid and Diverse Talking Faces through Identity-Decoupled Facial Motion Encoding},

author={Tao Liu and Feilong Chen and Shuai Fan and Chenpeng Du and Qi Chen and Xie Chen and Kai Yu},

year={2024},

eprint={2405.03121},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

感谢所有贡献者的努力

我们希望更多人能参与进来,我们将及时处理拉取请求。目前还有一些任务需要帮助,比如处理裁剪流程、创建网页界面以及翻译工作等。

特别贡献者

-

nitinmukesh 提交了Windows安装教程。他的Youtube频道有许多精彩的数字人教程。欢迎订阅他的频道!

-

https://github.com/tanshuai0219/EDTalk 提供了图像自动裁剪代码

访问计数:

<div align="center">致谢

我们衷心感谢众多先前的工作为AniTalker的开发奠定了基础。

第一阶段主要集中在训练运动编码器和渲染模块,严重依赖LIA的资源。第二阶段的扩散训练建立在diffae和espnet的基础上。对于互信息损失的计算,我们实现了CLUB的方法,并在身份网络的训练中使用了AAM-softmax。此外,我们利用了TencentGameMate提供的预训练Hubert模型和MFCC的mfcc特征。

另外,我们使用3DDFA_V2提取头部姿态,使用torchlm获取面部特征点,用于计算面部位置和比例。我们已经在talking_face_preprocessing开源了这些预处理步骤的代码使用。我们认识到在现有知识基础上构建的重要性,并致力于通过分享我们的发现和代码来回馈研究社区。

免责声明

1. 本库代码并非正式产品,我们并未测试所有使用场景,因此不能直接提供给最终服务客户。

2. 公开我们的代码的主要目的是为了便于学术演示和交流。严禁使用此代码传播有害信息。

3. 请在遵守许可文件中指定条款的情况下使用本库,避免不当使用。

4. 使用代码时,请遵循并遵守当地法律法规。

5. 在使用本代码期间,您将承担相应责任。我们公司(思必驰科技股份有限公司)对生成的结果不承担责任。

编辑推荐精选

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

QoderWork

阿里Qoder团队推出的桌面端AI智能体

QoderWork 是阿里推出的本地优先桌面 AI 智能体,适配 macOS14+/Windows10+,以自然语言交互实现文件管理、数据分析、AI 视觉生成、浏览器自动化等办公任务,自主拆解执行复杂工作流,数据本地运行零上传,技能市场可无限扩展,是高效的 Agentic 生产力办公助手。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号