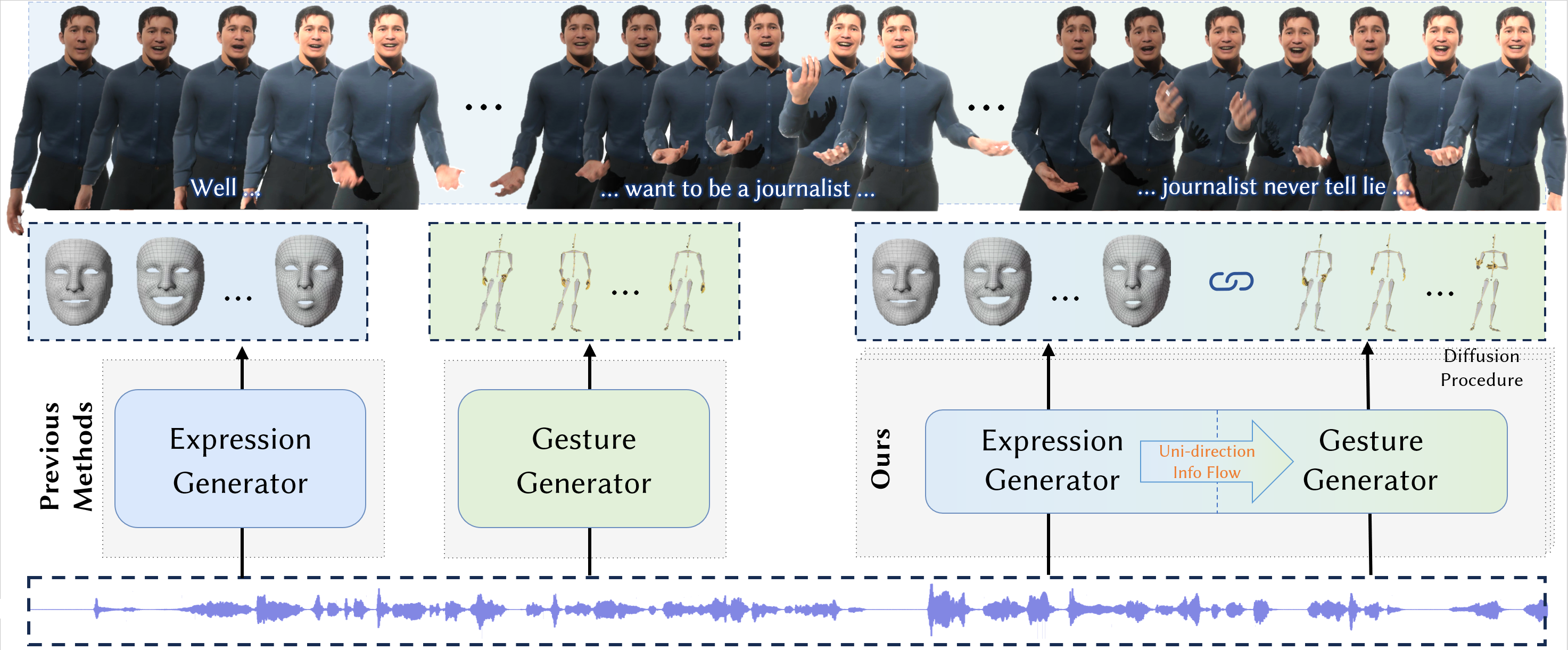

<b>DiffSHEG</b>:基于扩散的实时语音驱动整体3D表情和手势生成方法

(CVPR 2024 官方代码库)

陈俊铭<sup>†1,2</sup>,刘云飞<sup>2</sup>,王嘉楠<sup>2</sup>,曾爱玲<sup>2</sup>,李煜<sup>*2</sup>,陈启峰<sup>*1</sup>

<p><sup>1</sup>香港科技大学 <sup>2</sup>国际数字经济研究院(IDEA) <br><sup>*</sup>通讯作者 <sup>†</sup>此工作在IDEA实习期间完成<p>项目主页 · 论文 · 视频

</div>

环境配置

我们在Ubuntu 18.04和20.04上进行了测试。

cd assets

- 选项1:使用conda安装

conda env create -f environment.yml

conda activate diffsheg

- 选项2:使用pip安装

conda create -n "diffsheg" python=3.9

conda activate diffsheg

pip install -r requirements.txt

pip install torch==1.13.1+cu117 torchvision==0.14.1+cu117 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu117

- 解压data.tar.gz以获取数据统计信息

tar zxvf data.tar.gz

mv data ../

检查点

自定义音频推理

首先在以下提到的bash文件中指定'--test_audio_path'参数为您的测试音频路径。请注意,音频应为.wav文件。

- 使用在BEAT数据集上训练的模型:

bash inference_custom_audio_beat.sh

- 使用在SHOW数据集上训练的模型:

bash inference_custom_audio_talkshow.sh

训练

<details><summary>在BEAT数据集上训练</summary>PYTHONPATH="$(dirname $0)/..":$PYTHONPATH \

OMP_NUM_THREADS=10 CUDA_VISIBLE_DEVICES=0,1,2,3,4 python -u runner.py \

--dataset_name beat \

--name beat_diffsheg \

--batch_size 2500 \

--num_epochs 1000 \

--save_every_e 20 \

--eval_every_e 40 \

--n_poses 34 \

--ddim \

--multiprocessing-distributed \

--dist-url 'tcp://127.0.0.1:6666'

PYTHONPATH="$(dirname $0)/..":$PYTHONPATH \

OMP_NUM_THREADS=10 CUDA_VISIBLE_DEVICES=0,1,2,3,4 python -u runner.py \

--dataset_name talkshow \

--name talkshow_diffsheg \

--batch_size 950 \

--num_epochs 4000 \

--save_every_e 20 \

--eval_every_e 40 \

--n_poses 88 \

--classifier_free \

--multiprocessing-distributed \

--dist-url 'tcp://127.0.0.1:6667' \

--ddim \

--max_eval_samples 200

测试

<details><summary>在BEAT数据集上测试</summary>PYTHONPATH="$(dirname $0)/..":$PYTHONPATH \

OMP_NUM_THREADS=10 CUDA_VISIBLE_DEVICES=0,1,2,3,4,5,6,7 python -u runner.py \

--dataset_name talkshow \

--name talkshow_GesExpr_unify_addHubert_encodeHubert_mdlpIncludeX_condRes_LN_ClsFree \

--PE pe_sinu \

--n_poses 88 \

--multiprocessing-distributed \

--dist-url 'tcp://127.0.0.1:8889' \

--classifier_free \

--cond_scale 1.25 \

--ckpt ckpt_e2599.tar \

--mode test_arbitrary_len \

--ddim \

--timestep_respacing ddim25 \

--overlap_len 10

PYTHONPATH="$(dirname $0)/..":$PYTHONPATH \

OMP_NUM_THREADS=10 CUDA_VISIBLE_DEVICES=0,1,2,3,4,5,6,7 python -u runner.py \

--dataset_name talkshow \

--name talkshow_GesExpr_unify_addHubert_encodeHubert_mdlpIncludeX_condRes_LN_ClsFree \

--PE pe_sinu \

--n_poses 88 \

--multiprocessing-distributed \

--dist-url 'tcp://127.0.0.1:8889' \

--classifier_free \

--cond_scale 1.25 \

--ckpt ckpt_e2599.tar \

--mode test_arbitrary_len \

--ddim \

--timestep_respacing ddim25 \

--overlap_len 10

可视化

在测试或自定义音频测试模式下运行后,手势和表情结果将保存在./results目录中。

BEAT

- 在本地计算机上使用最新版本的Blender打开

assets/beat_visualize.blend。 - 在Blender的脚本中指定音频、BVH(用于手势)、JSON(用于表情)和视频保存路径。

- (可选)点击窗口 --> 切换系统控制台以查看可视化进度。

- 在Blender中运行脚本。

SHOW

请参考TalkSHOW代码以可视化我们生成的动作。

致谢

我们的实现部分基于BEAT、TalkSHOW和MotionDiffuse。

引用

如果您使用我们的代码或发现此代码库有用,请考虑引用我们的论文:

@inproceedings{chen2024diffsheg,

title = {DiffSHEG: A Diffusion-Based Approach for Real-Time Speech-driven Holistic 3D Expression and Gesture Generation},

author = {Chen, Junming and Liu, Yunfei and Wang, Jianan and Zeng, Ailing and Li, Yu and Chen, Qifeng},

booktitle = {CVPR},

year = {2024}

}

编辑推荐精选

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP�或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

Refly.AI

最适合小白的AI自动化工作流平台

无需编码,轻松生成可复用、可变现的AI自动化工作流

酷表ChatExcel

大模型驱动的Excel数据处理工具

基于大模型交互的表格处理系统,允许用户通过对话方式完成数据整理和可视化分析。系统采用机器学习算法解析用户指令,自动执行排序、公式计算和数据透视等操作,支持多种文件格式导入导出。数据处理响应速度保持在0.8秒以内,支持超过100万行数据的即时分析。

TRAE编程

AI辅助编程,代码自动修复

Trae是一种自适应的集成开发环境(IDE),通过自动化和多元协作改变开发流程。利用Trae,团队能够更快速、精确地编写和部署代码,从而提高编程效率和项目交付速度。Trae具备上下文感知和代码自动完成功能,是提升开发效率的理想工具。

AIWritePaper论文写作

AI论文写作指导平台

AIWritePaper论文写作是一站式AI论文写作辅助工具,简化了选题、文献检索至论文撰写的整个过程。通过简单设定,平台可快速生成高质量论文大纲和全文,配合图表、参考文献等一应俱全,同时提供开题报告和答辩PPT等增值服务,保障数据安全,有效提升写作效率和论文质量。

博思AIPPT

AI一键生成PPT,就用博思AIPPT!

博思AIPPT,新一代的AI生成PPT平台,支持智能生成PPT、AI美化PPT、文本&链接生成PPT、导入Word/PDF/Markdown文档生成PPT等,内置海量精美PPT模板,涵盖商务、教育、科技等不同风格,同时针对每个页面提供多种版式,一键自适应切换,完美适配各种办公场景。

潮际好麦

AI赋能电商视觉革命,一站式智能商拍平台

潮际好麦深耕服装行业,是国内AI试衣效果最好的软件。使用先进AIGC能力为电商卖家批量提供优质的、低成本的商拍图。合作品牌有Shein、Lazada、安踏、百丽等65个国内外头部品牌,以及国内10万+淘宝、天猫、京东等主流平台的品牌商家,为卖家节省将近85%的出图成本,提升约3倍出图效率,让品牌能够快速上架。

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号