Ollama 应用

一个现代化且易于使用的 Ollama 客户端。在保持一切隐私和本地网络的同时,获得最佳体验。

|  |  |  |

|---|

[!重要] 此应用程序不在设备上托管 Ollama 服务器,而是连接到一个服务器并使用其 API 端点。 你不知道 Ollama 是什么?在 ollama.com 了解更多。

安装

你可以在发布标签下找到 Ollama 应用的最新推荐版本。下载 APK 并安装到你的 Android 设备上。就这么简单,现在继续初始设置。

或者,你也可以从以下任何一个商店下载应用:

初始设置

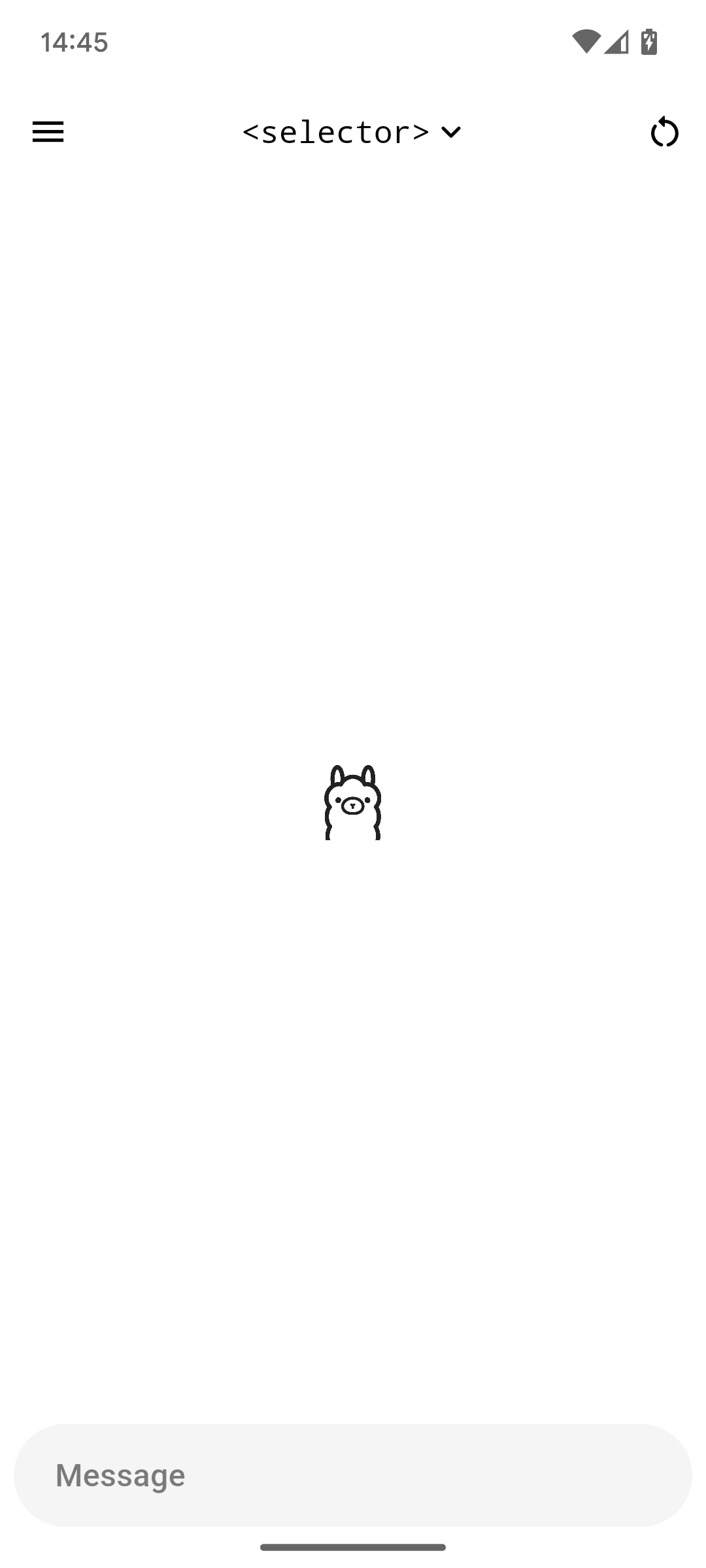

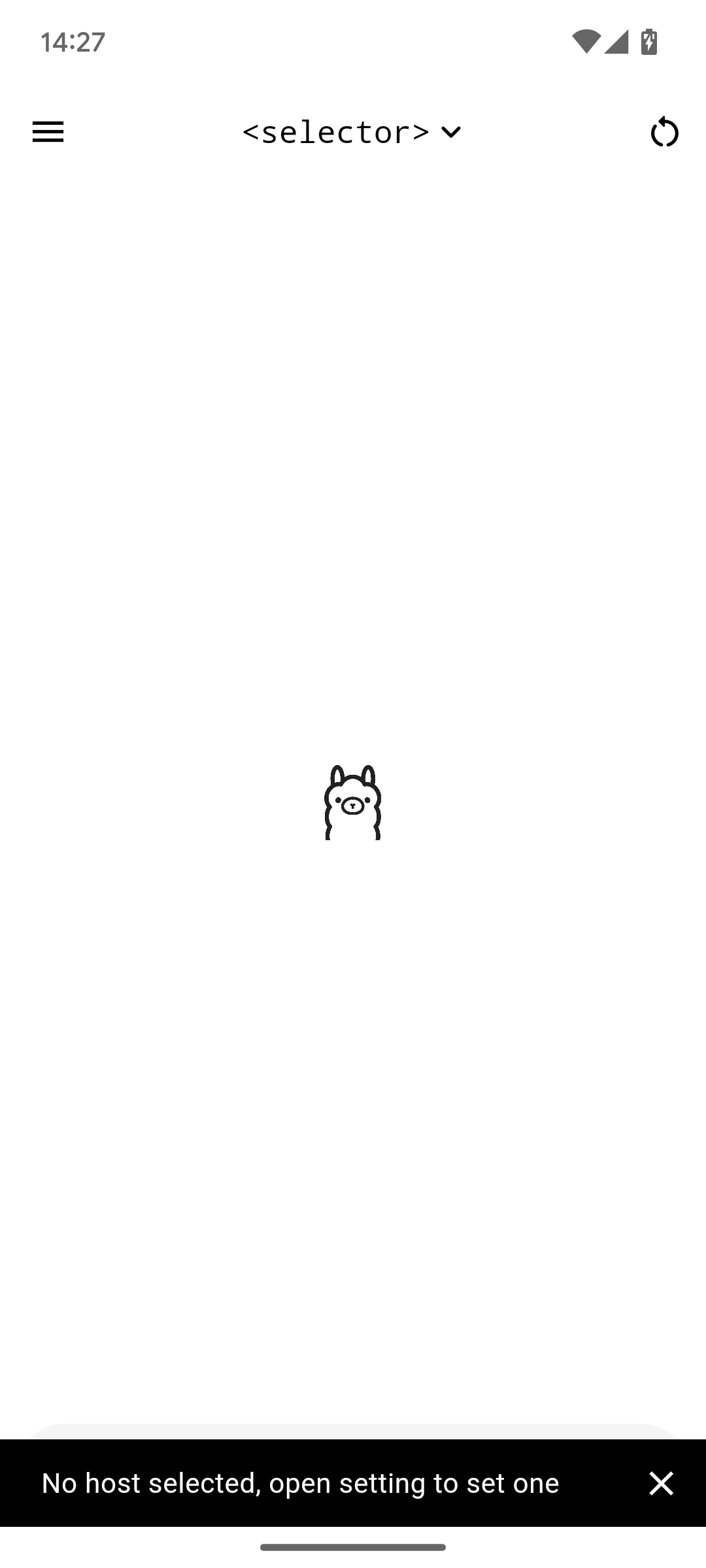

安装应用并首次打开后,你会看到这个弹出窗口:

<img src="https://yellow-cdn.veclightyear.com/ab5030c0/ff008a0e-1ece-4507-91f8-92045fb486a3.png" alt="欢迎说明" height="720" />一步一步浏览欢迎对话框,你应该阅读其内容,但不是必须的。

|  |  |

|---|

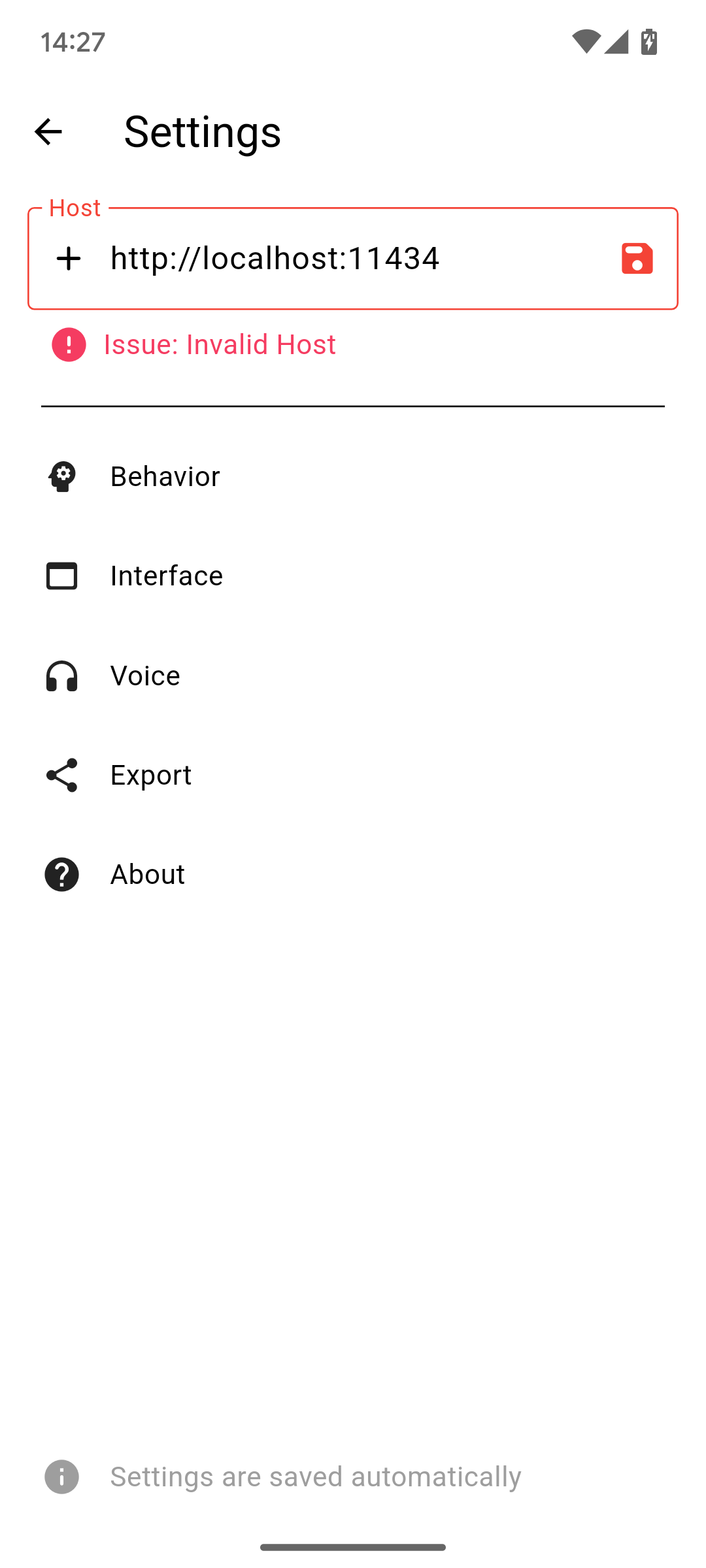

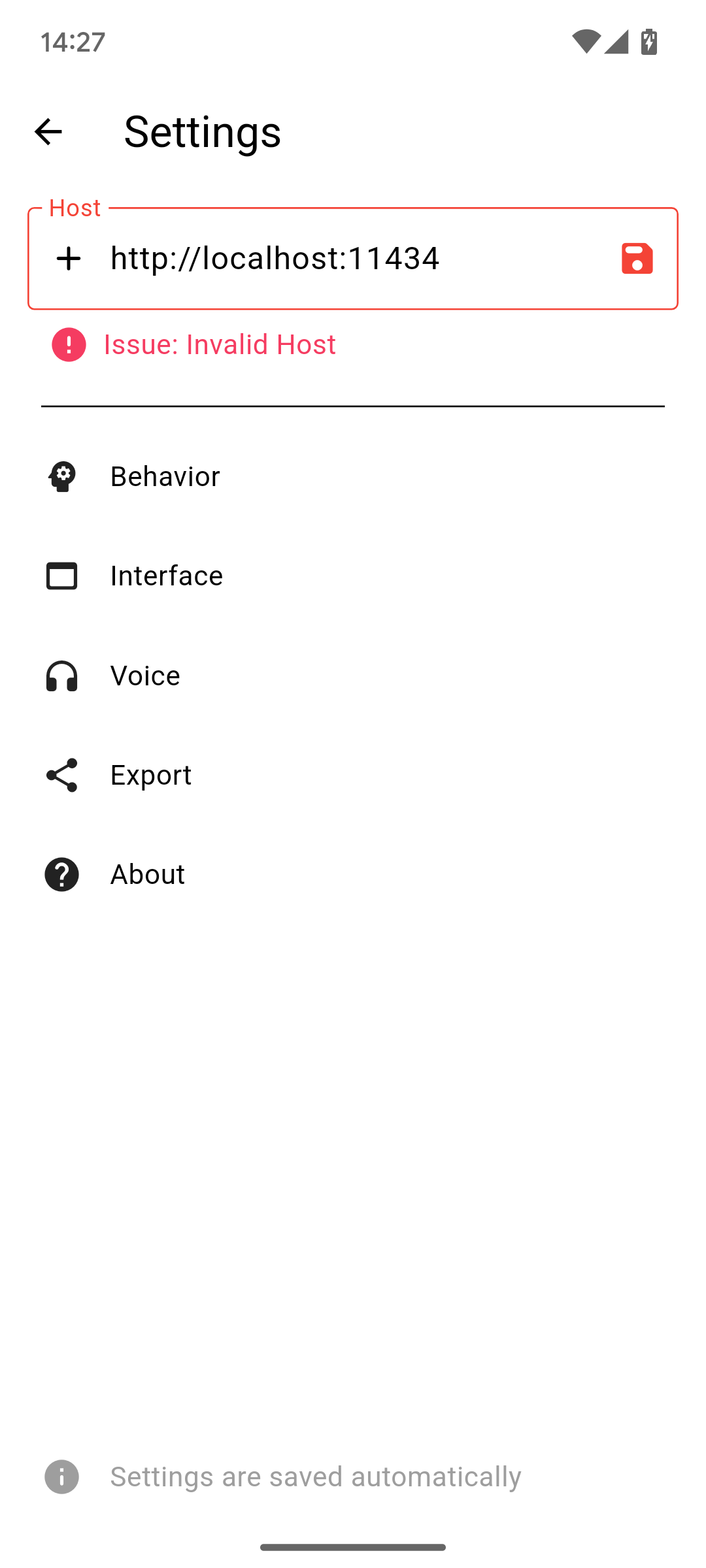

浏览完后,你会看到一个小的提示栏通知你需要设置主机。为此,打开侧边栏(从左向右滑动或点击左上角的图标)并点击设置。在那里你会找到所有与应用相关的设置,你应该浏览一遍,但对于初始设置,只有第一个是重要的。

在大的主机文本字段中,你必须输入你的实例的基本 URL。除非端口号与协��议匹配(HTTPS 为 443 或 HTTP 为 80),否则需要端口。之后,点击文本字段旁边的保存图标。

要了解更多关于主机设置的信息,请访问设置

[!重要] Ollama 服务器需要额外的步骤才能从本地机器外部访问。要了解更多信息,请访问 issue #5

就是这样,现在你可以直接聊天了。在底部的框中输入一条消息,然后点击发送图标。

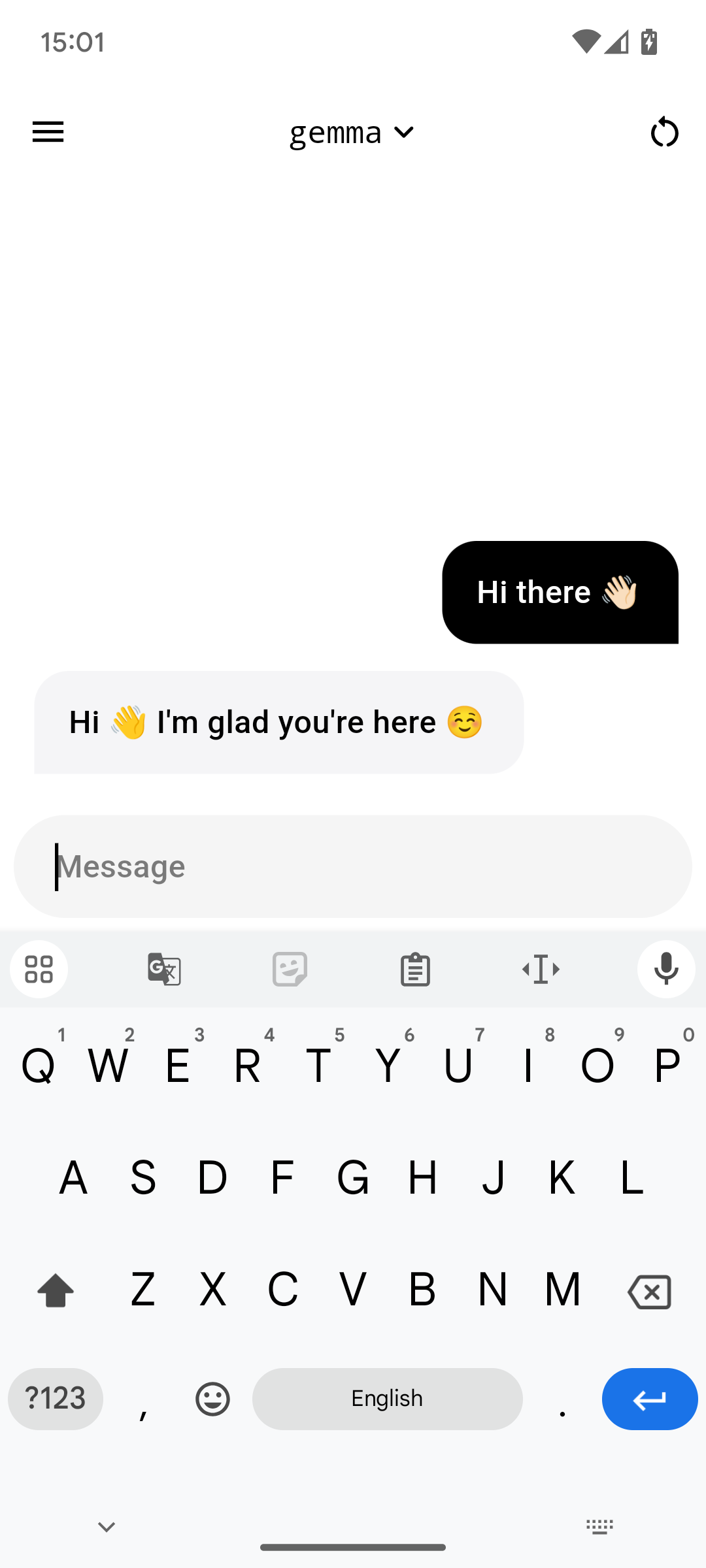

聊天界面

这是应用的主界面,简单而且最重要的是能正常工作。

[!注意] 要开始聊天,你首先需要在模型选择器中选择一个模型。先做这个,然后再回到这里。

聊天模式很简单。只需写一条消息,等待片刻,答案就会发送到聊天中。

聊天界面默认已经包含了一些有用的功能。可以通过双击你想从世界上抹去的消息来删除消息,包括该消息本身在内的所有自此发送的消息都会被删除。

编辑消息也几乎一样简单。在界面设置中启用消息编辑后,只需长按一条消息,就会打开一个弹出窗口,询问新的内容。

<img src="https://yellow-cdn.veclightyear.com/ab5030c0/b4129798-7371-454e-bd02-85e653f96222.png" alt="消息编辑对话框" height="720" />[!提示] 消息(几乎)完全支持 Markdown 语法。这意味着 AI 将能够以 Markdown 格式接收和发送消息。

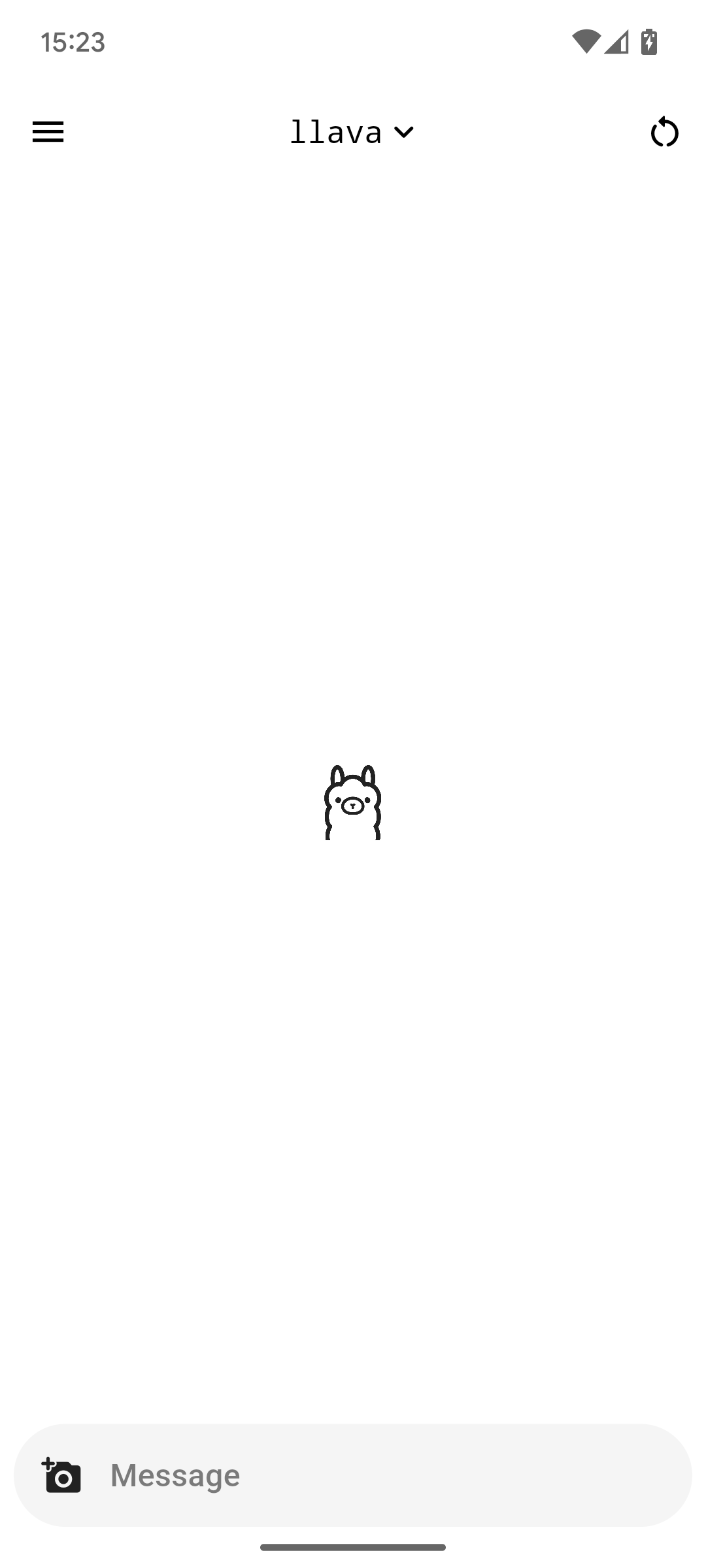

多模态输入

Ollama 应用支持多模态模型,即支持通过图像输入的模型。在模型选择器中,支持该技术的模型名称旁边会标有图像图标。

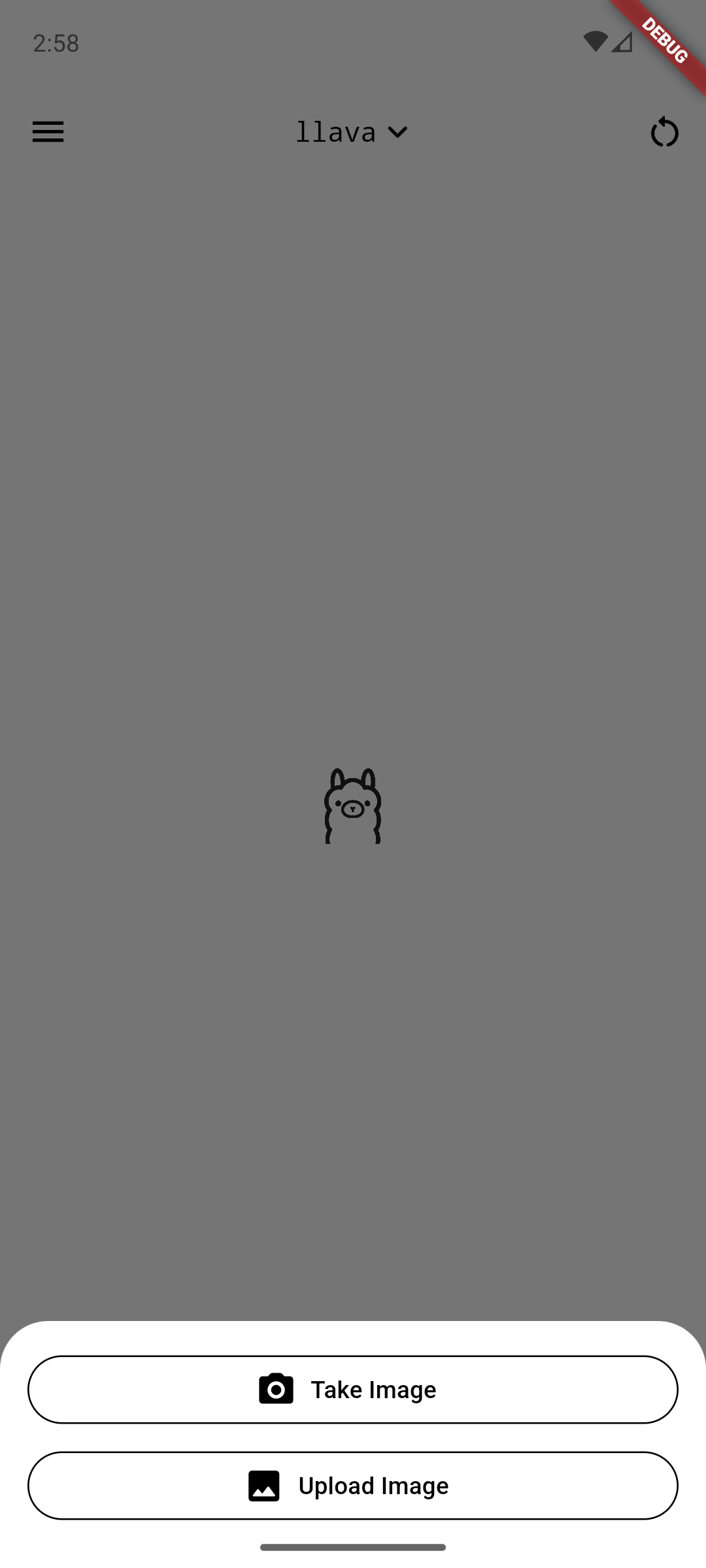

选择多模态模型后,消息栏左下角会出现一个新图标:相机图标。点击它会显示以下底部表单:

|  |  |

|---|

选择其中一个,拍摄或选择你的照片,它就会被添加到聊天中。允许添加多张图片,只需重复这些步骤。

即使图像在发送后就会出现在聊天中,它们也不会被提交给 AI,直到发送新的文本消息。当你发送消息时,AI 会在考虑图像的情况下回答消息。

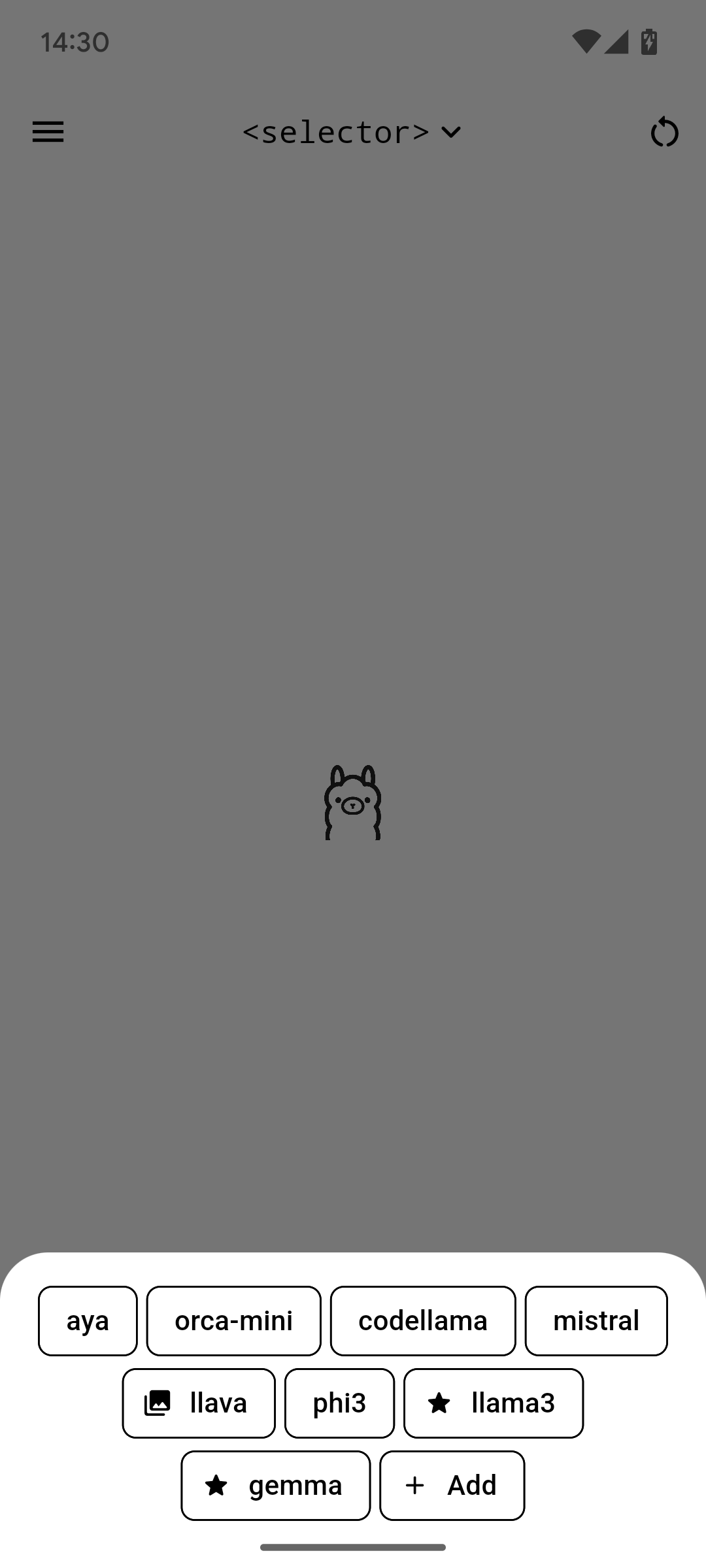

模型选择器

你可以通过点击顶部中间的 <selector> 文本或同一位置当前选定的模型名称来访问模型选择器。然后你会看到以下弹出对话框:

这将显示当前安装在你的 Ollama 服务器实例上的所有模型。

名称旁边带星号的模型是推荐模型。它们是由我(嘿嘿)选择列为推荐的。在自定义构建下阅读更多内容。

添加按钮目前不起作用,它只是打开一个列出如何向实例添加模型的步骤的提示栏。出于安全原因,我没有在应用中直接添加通过名称添加模型的功能。

支持多模态输入的模型在其名称旁边标有图像图标,如上图中的 llava。

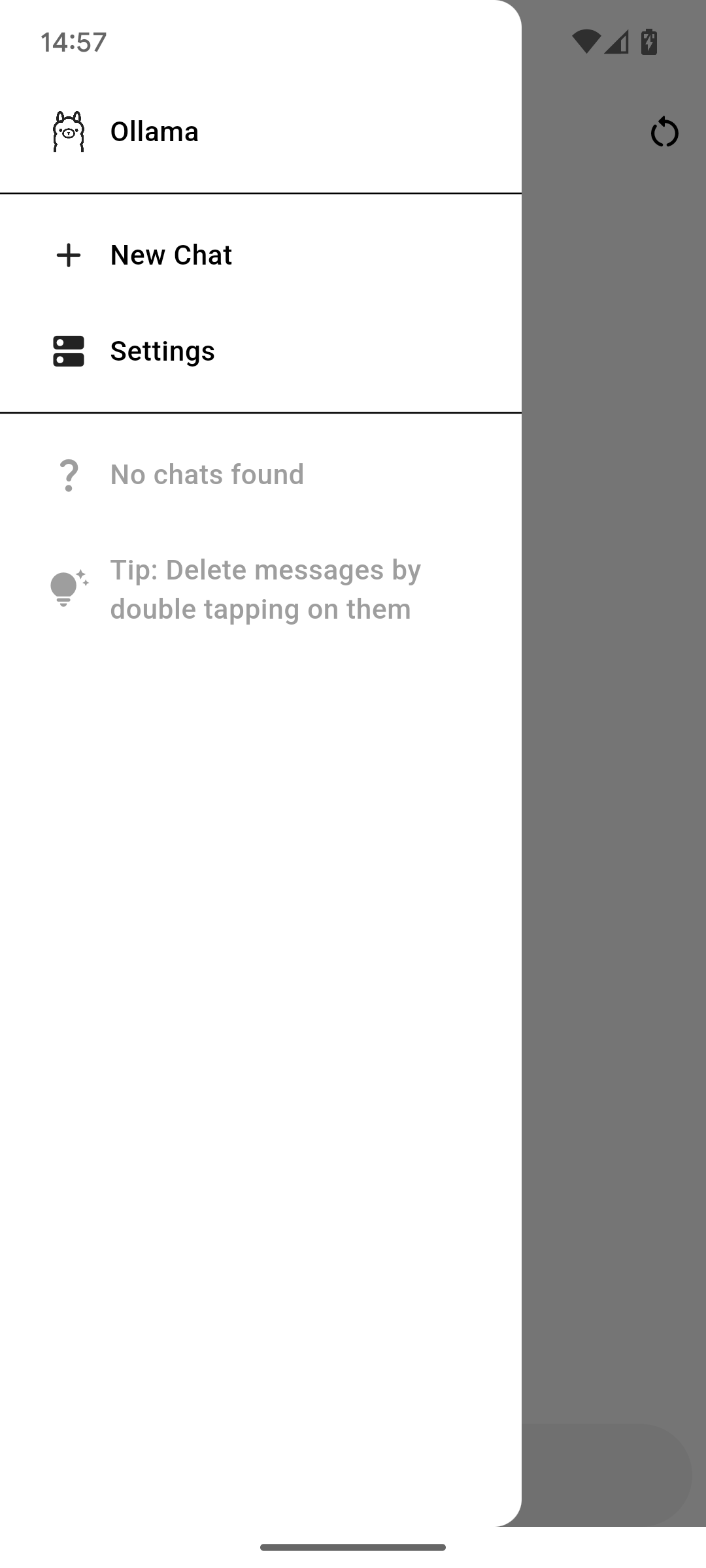

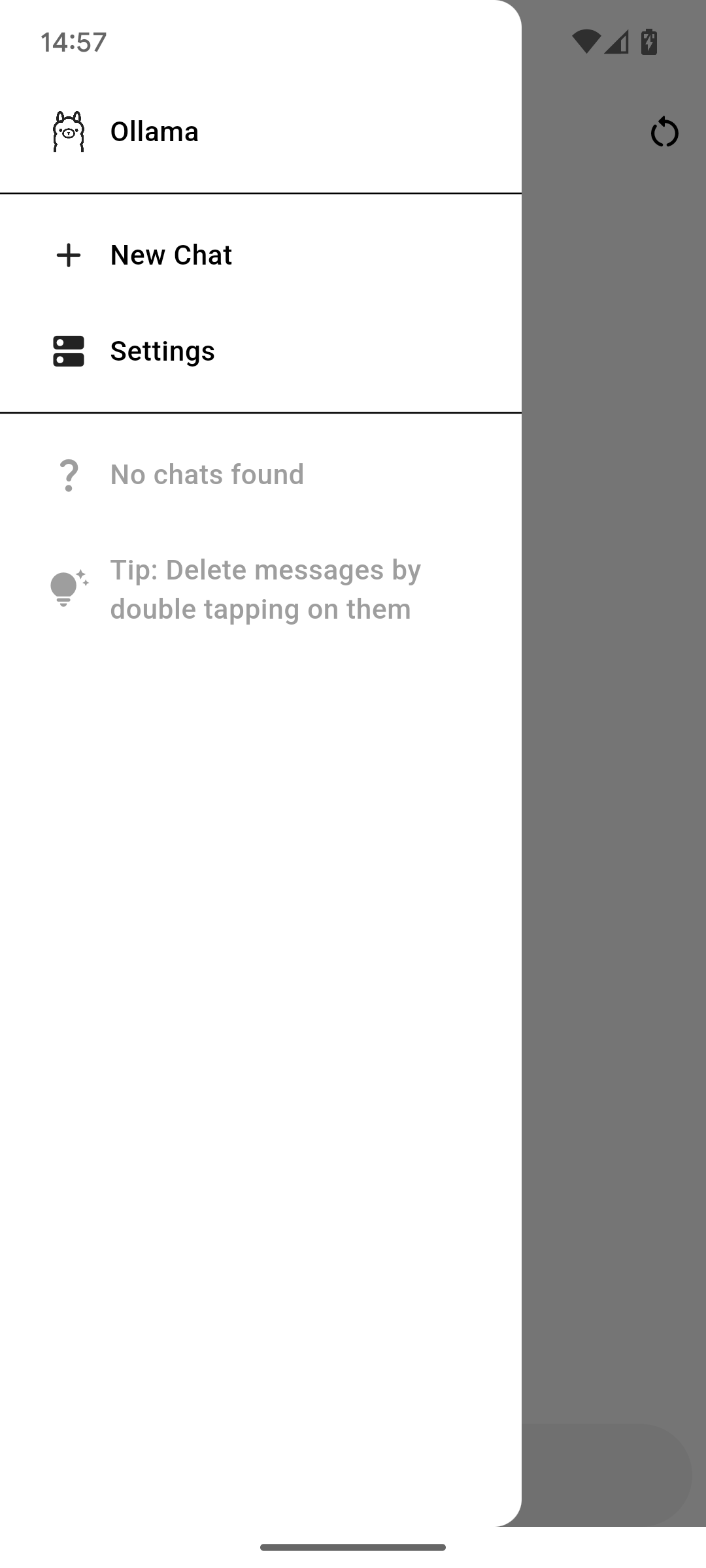

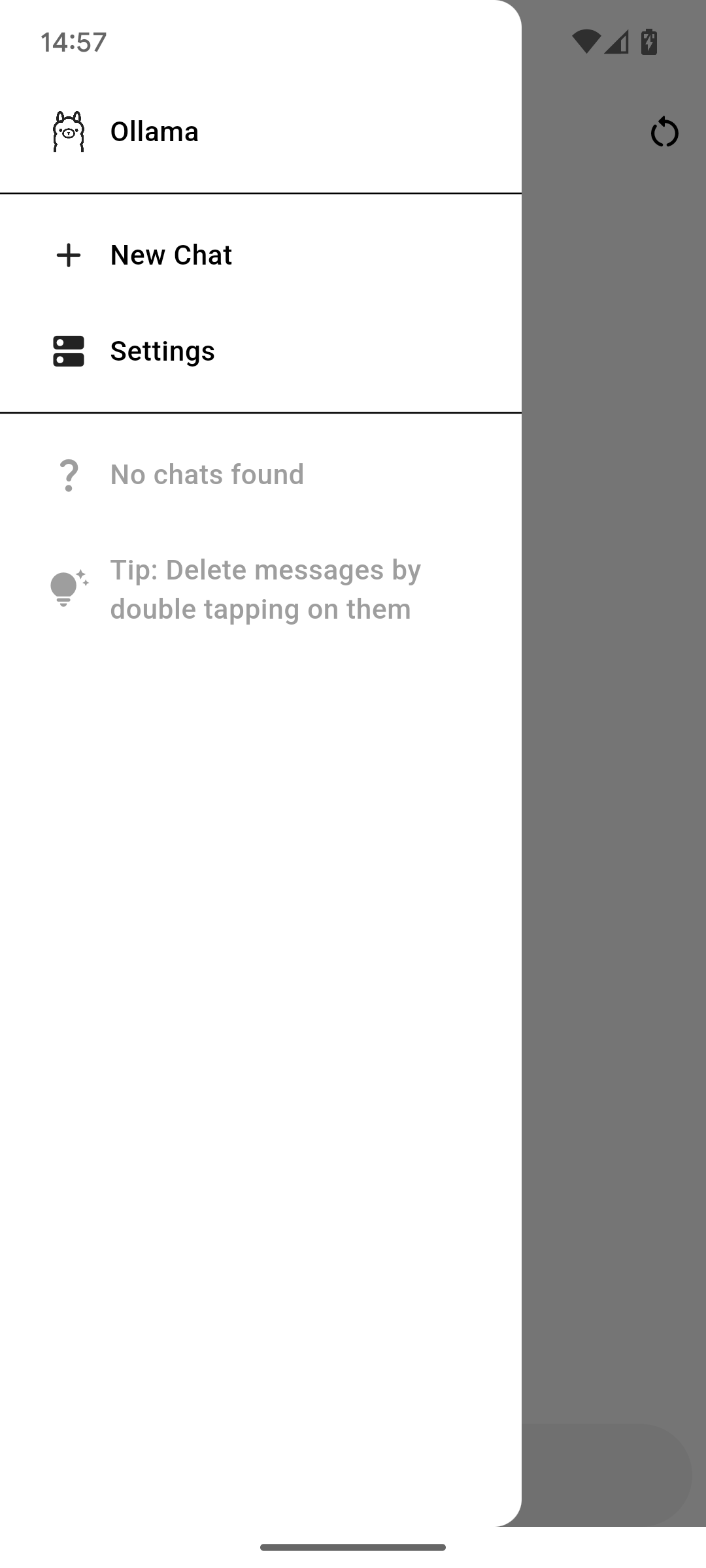

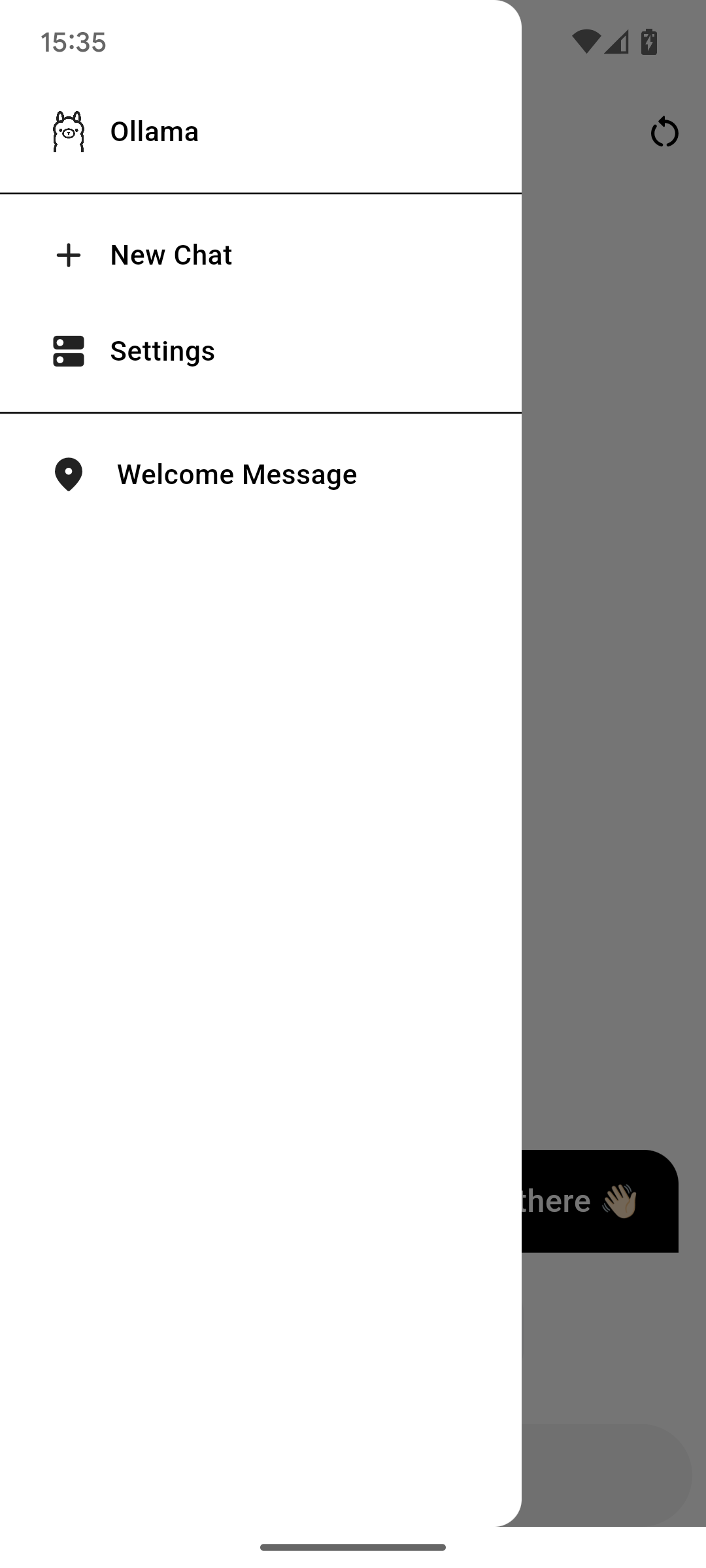

侧边菜单

左上角的按钮打开菜单。在其中,你有两个选项:新建聊天和设置。第一个选项创建一个新的聊天,第二个选项打开设置,你可以在其中更改一切的工作方式。

下面是所有的聊天。要删除一个,从左向右滑动。要重命名聊天,点击并按住直到出现弹出对话框。在其中,你可以更改标题或点击闪光图标让 AI 为你找一个。这不受"生成标题"设置的影响。

|  |  |

|---|

[!注意] 右上角的按钮删除聊天。它的效果与在侧边栏中滑动聊天相同。

设置

Ollama 应用提供了许多配置选项。我们将逐一介绍每个选项。

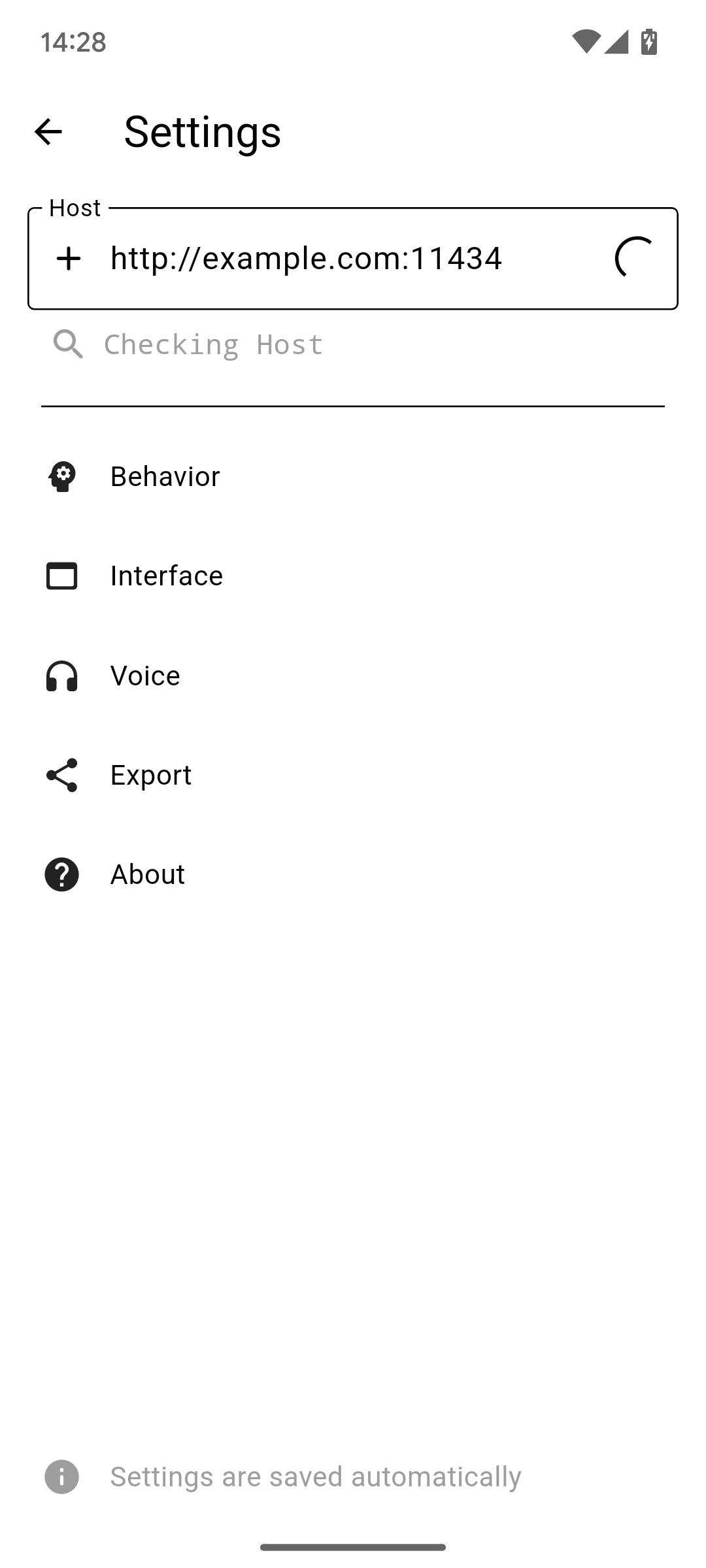

主机

主机是你的 Ollama 服务器的主要地址。它可能包括端口、协议和主机名。不建议使用路径。

|  |  |

|---|

除非端口号与协议匹配(HTTPS 为 443 或 HTTP 为 80),否则需要端口。之后,点击文本字段旁边的保存图标来设置主机。

主机地址将被检查,所以不用担心输入错误的地址。如果你设置了主机,而你的服务器离线,请求将失败,但如果你不自己更改,主机将保持保存。要更改,只需进入侧边菜单并打开设置即可。

自定义标头

<img src="https://yellow-cdn.veclightyear.com/ab5030c0/914dc5e0-4e9a-4081-a1db-22626cd6fa73.png" alt="设置屏幕" height="720" />Ollama 应用支持添加自定义标头。如果你想用身份验证或类似方式保护你的实例,这可能很有用。只需按主机输入旁边的加号图标,并将其设置为 JSON 对象。例如:

{ "Authorization": "Bearer <token>" }

行为

<img src="https://yellow-cdn.veclightyear.com/ab5030c0/3681a251-debf-4c89-837f-ddddff5ce1e3.png" alt="设置屏幕" height="720" />行为设置包括与系统提示相关的设置。它们只有在你创建新�的聊天后才会应用。

系统提示在对话开始时发送给助手。它引导助手朝某个方向发展,它会按照你在这条消息中告诉它的方式说话。要将系统提示重置为默认值,清空其值,点击保存图标并关闭屏幕。

禁用 Markdown 的选项并不安全,助手仍然可能在其响应中添加 Markdown。

界面

<img src="https://yellow-cdn.veclightyear.com/ab5030c0/2c99b1bc-918c-491a-9598-f3d97d380677.png" alt="设置界面" height="720" />界面设置主要集中在Ollama应用的界面上,正如其名称所暗示的那样。以下列表将详细说明所有选项:

- 针对模型选择器:

- 在模型选择器中显示模型标签。如果你安装了同一模型的多个版本,这可能会很有用

- 更换模型时清除聊天记录。强烈建议启用此选项,禁用可能导致意外行为

- 用于聊天视图:

- 设置请求模式。推荐使用流式传输,但有时可能不可用,此时选择"请求"

- 是否使用Ollama AI生成聊天标题。可能会增加潜在的配额成本

- 是否长按消息打开编辑对话框

- 是否在删除聊天前询问。如果聊天中可能存储重要数据,这很有用

- 是否在主侧边栏显示提示

- 后端加载选项:

- 始终保持模型加载状态(

keep_alive设为-1) - 不保持模型加载状态(

keep_alive设为0) - 保持模型活跃的时间

- 始终保持模型加载状态(

- 外观设置:

- 是否启用触觉反馈

- 是否以最大化窗口启动(仅限桌面版)

- 应用主题

- 跟随设备主题/颜色

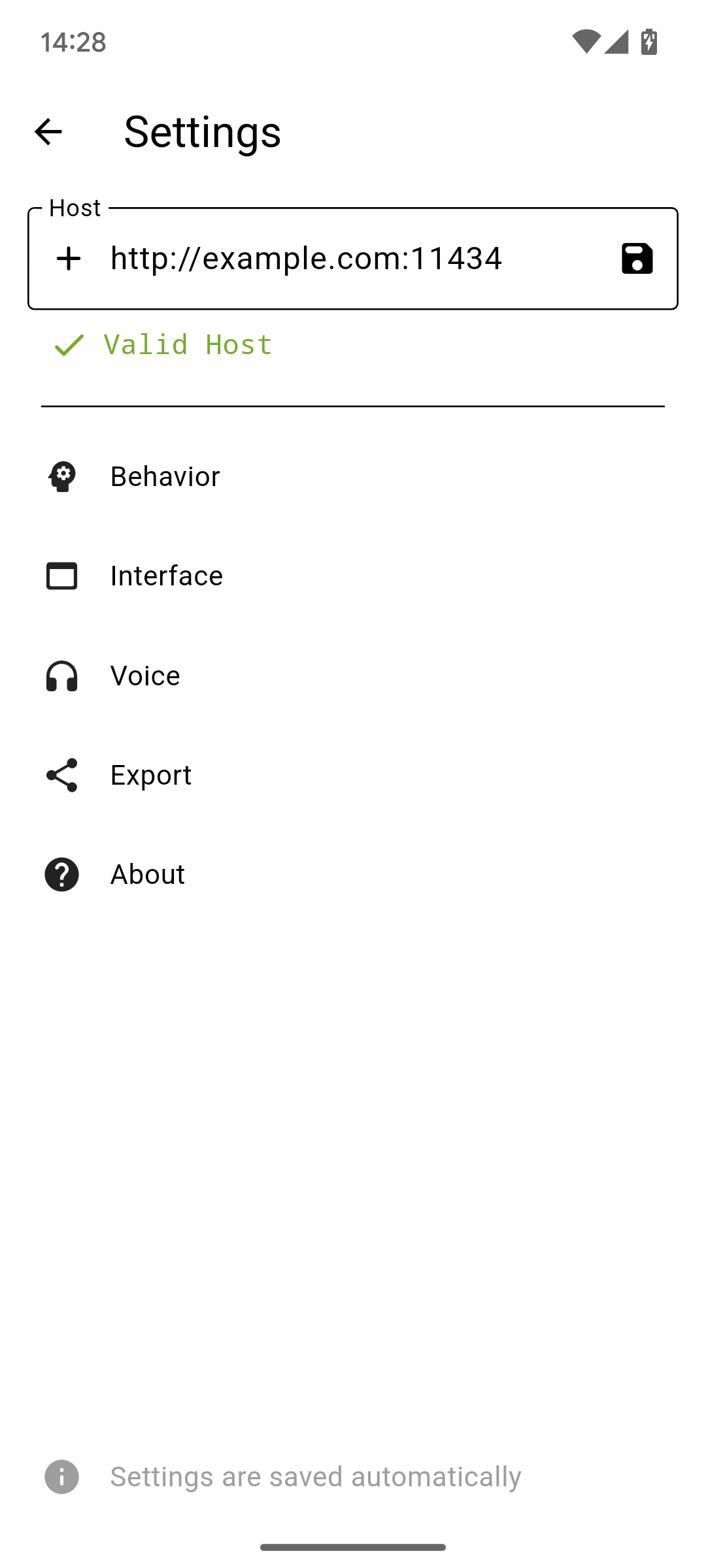

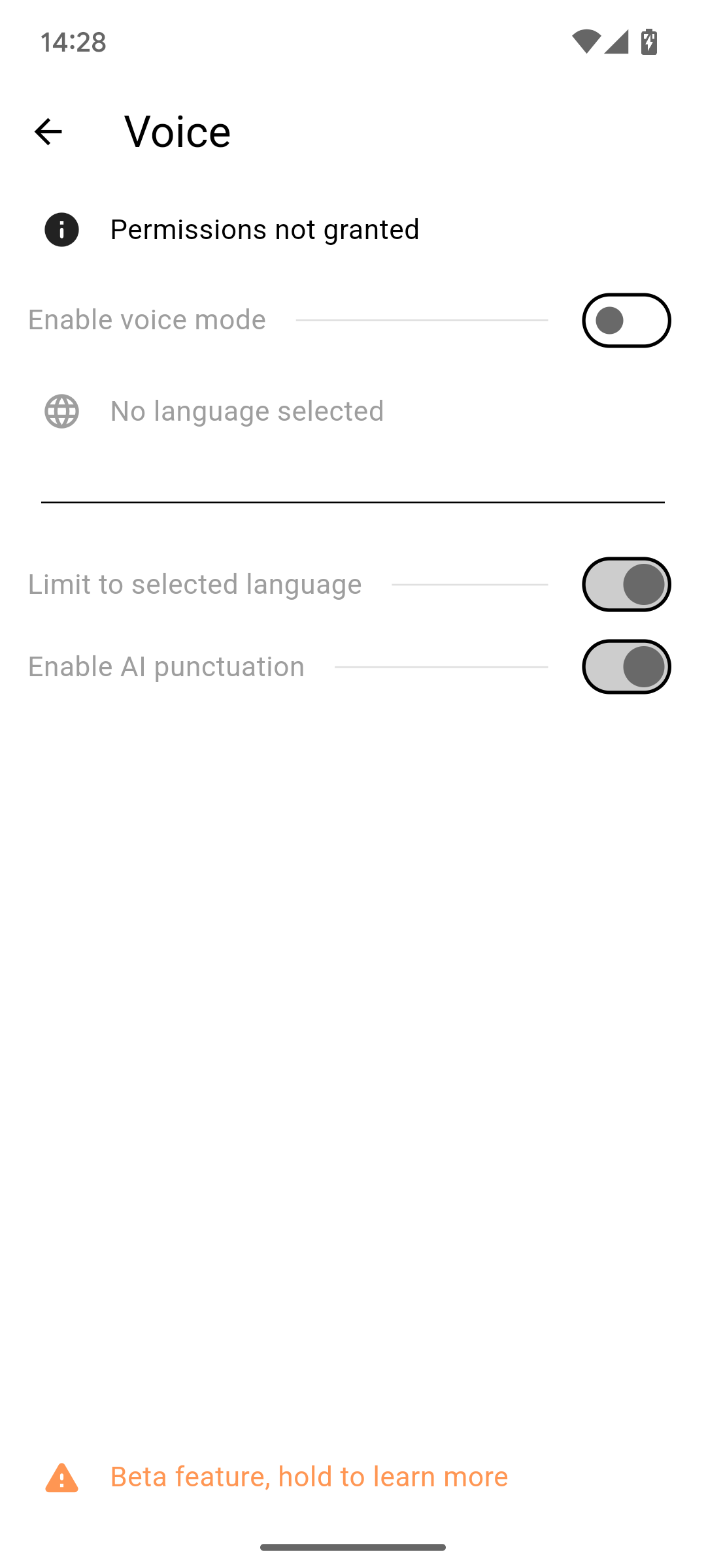

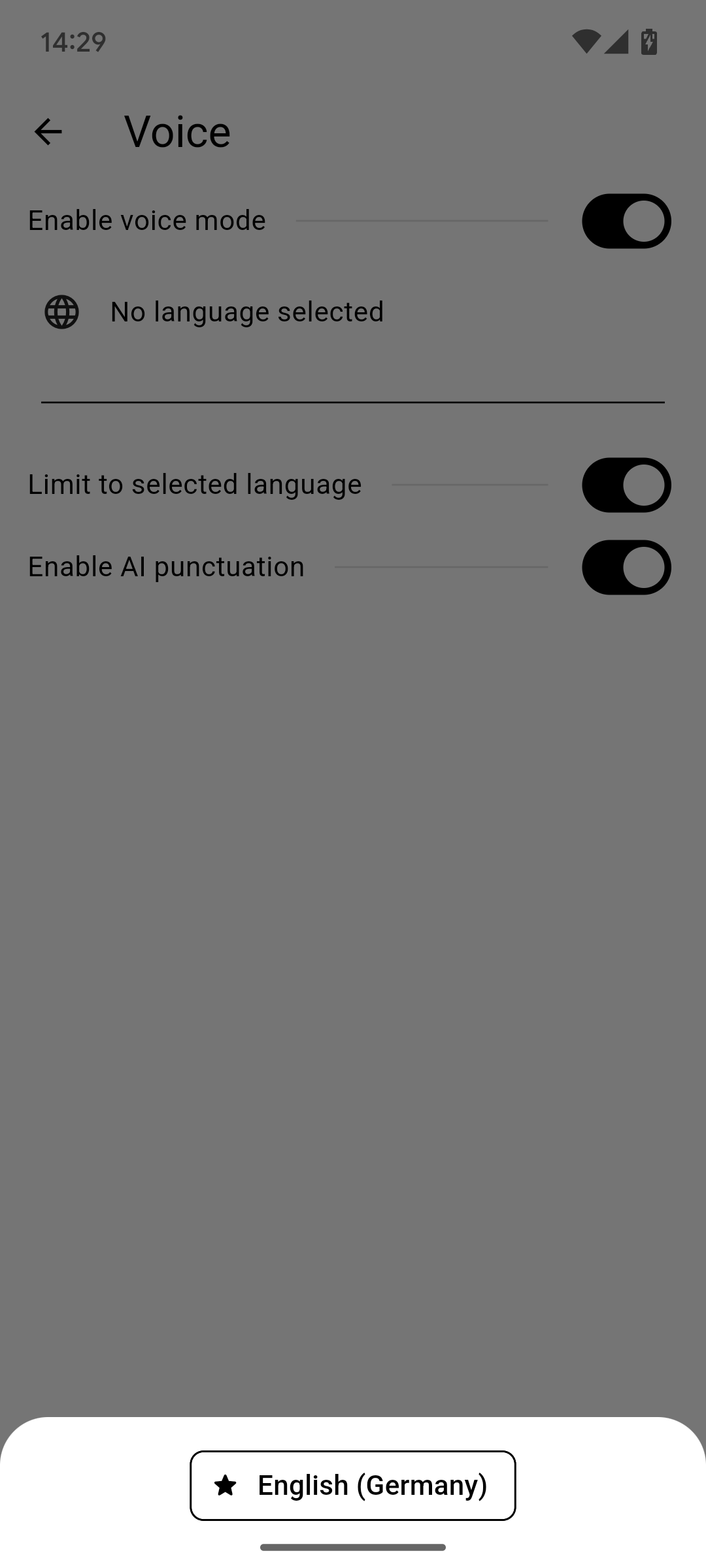

语音

[!警告] 这仍是一项实验性功能!某些功能可能无法按预期工作!

|  |  |

|---|

点击"未授予权限"按钮以允许所需权限。这些权限是语音转文字功能所必需的。

之后,通过切换开关启用语音模式。要使其正常工作,你现在需要点击"未选择语言"并在语言对话框中选择一种语言。就是这样。

然后,在多模态模型的附件图标位置按下按钮,或按下照片图标和"语音"按钮。

<img src="https://yellow-cdn.veclightyear.com/ab5030c0/6c0fc76d-257a-4b96-838f-b690edf078fd.png" alt="设置界面" height="720" />[!注意] 一旦此功能脱离实验阶段,将会添加适当的文档

导出

<img src="https://yellow-cdn.veclightyear.com/ab5030c0/9f33f549-1c7b-49d6-ac3b-bb0d8935a644.png" alt="设置界面" height="720" />导出功能允许你将所有聊天记录导出并保存到文件中。如果你想备份数据或在设备之间同步数据,这可能非常有用。

[!警告] 导入功能会删除当前保存在磁盘上的所有聊天记录,并用文件中的聊天记录替换它们。此操作无法撤销。

关于(和更新)

<img src="https://yellow-cdn.veclightyear.com/ab5030c0/b5ce6b0e-590e-441c-9a9f-262743351afb.png" alt="设置界面" height="720" />关于界面包含许多有用的信息。

你可以直接从这个界面访问应用的GitHub仓库或问题页面。

另一个有用的功能是更新检查器。它会在仓库中查找更新,并提示你直接从GitHub下载。不过要小心,使用的GitHub API有速率限制。在速率限制生效之前,你只能发送有限数量的请求。

多语言界面

Ollama应用支持多种语言。目前可用的语言有:

- 英语(后备)

- 德语

- 中文(简体)

- 意大利语

- 土耳其语

如果语言已100%翻译完成,则会打勾。这可能不是最新情况,请查看项目页面以获取最新进展。

如果你要找的语言没有列出,可以在Crowdin项目页面上查看开发是否正在进行。如果没有,你随时可以贡献。

自定义构建

现在事情变得有趣了。应用的构建方式使你可以轻松创建自定义构建。目前,可以自定义以下值:

// 是否使用主机,如果为false则显示对话框

const useHost = false;

// ollama的主机,必须从客户端可访问,不带尾斜杠,将始终被视为有效

const fixedHost = "http://example.com:11434";

// 是否使用模型,如果为false则显示选择器

const useModel = false;

// 模型名称字符串,必须是有效的ollama模型!

const fixedModel = "gemma";

// 推荐模型,在模型选择器中以星号显示

const recommendedModels = ["gemma", "llama3"];

// 允许打开设置

const allowSettings = true;

// 允许多个聊天

const allowMultipleChats = true;

这些可以在lib/main.dart的顶部找到。useHost和useModel决定是否要使用fixedHost和fixedModel来控制任何内容。fixedHost和fixedModel决定要使用的值。如果你尝试创建特定于你的实例的应用,这可能会很实用。

recommendedModels是一个在模型选择器中列为推荐的模型列表。它们更像是个人偏好。如果为空,则不会优先考虑任何模型。

allowSettings将禁用设置界面。但它也会禁用首次启动时的欢迎对话框和重命名聊天的能力。

allowMultipleChats简单地从侧边菜单中移除"新建聊天"选项。并在应用启动时加载唯一可用的聊天。

实际构建

但你如何创建自定义构建呢?

首先,按照Flutter安装指南选择Android作为第一个应用类型。然后按照这些步骤操作,直到你获得自定义的key.properties。将其放入项目根目录的android文件夹中。

确保dart可作为命令使用或已添加为.dart的默认程序。然后执行scripts/build.dart并等待处理完成。然后转到build/.output。你会在那里找到所需的一切,包括普通的Android应用和实验性的Windows构建。

编辑推荐精选

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

QoderWork

阿里Qoder团队推出的桌面端AI智能体

QoderWork 是阿里推出的本地优先桌面 AI 智能体,适配 macOS14+/Windows10+,以自然语言交互实现文件管理、数据分析、AI 视觉生成、浏览器自动化等办公任务,自主拆解执行复杂工作流,数据本地运行零上传,技能市场可无限扩展,是高效的 Agentic 生产力办公助手。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的�设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号