<u>:fire:WASM_NVIM:zap:</u>

目标:

编写一个库来实现Lua和wasm之间的接口,以实现插件和Neovim API之间的通信。该库使用Rust语言编写,通过Neovim API使用Lua动态加载,而不是通过RPC路由,这种方式会在两个或多个不同进程之间造成网络瓶颈。这种方法允许单一进程**(NEOVIM)**,同时还允许插件生态系统使用任何可以编译为wasm的编程语言。

性能:

-

第一个测试是一个简单的性能测试实现,模仿了Bram的实现,仅在for循环中对数字进行求和。wasm比LuaJIT快99%,这主要是由于编程语言(在这种情况下是zig)的编译器优化。这主要展示了编译为wasm可能带来的编译优化优势,相比于LuaJIT的即时编译。

-

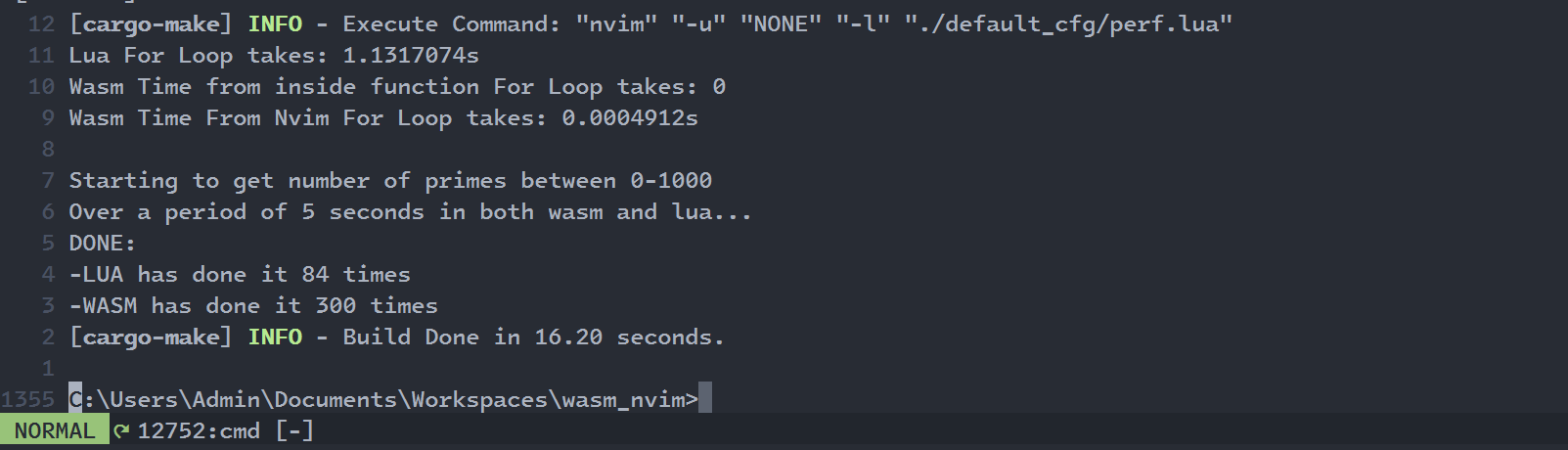

第二个测试尝试获取0-10000之间的素数,并计算在5秒内可以完成的次数。这里没有常量,因此即使是编译成wasm也不应该像第一个测试那样优化掉几乎所有的操作。在这里,wasm比LuaJIT快99%。我没有为每种特定语言优化算法,而是使用了基本结构,并避免在zig/wasm端使用位操作或栈预分配。

-

这张图片展示了测试结果:

-

要运行这个测试,只需执行以下命令:

cargo make perf要求:

cargo-make,可以通过cargo install cargo-make安装。zig需要在系统路径中,可以从Download ⚡ Zig Programming Language (ziglang.org)安装

-

总的来说,wasm在不使用任何特殊优化技术的情况下,平均应该比luajit更快。对于更广泛的luajit vs wasm比较,可以查看这里

注意:当前显示的性能测试结果来自Windows 10 PC。这是我拥有的机器。

阅读:

理论

我们需要在每个wasm模块上实现内存分配和释放函数,这是模块开发者需要自己创建的,因为主机**(这个rust库)**和wasm插件之间目前只能直接共享i32或f32类型的数据,但其他对象如缓冲区、结构体等需要超过32位的数据,因此我们使用内存指针与模块通信,以在主机端访问和操作数据,在适用的情况下,通常涉及JSON。

从发布包安装和设置

-- 从发布包下载共享库,如果你不想从源代码构建 -- 而只想直接使用,可以这样做。警告:仅支持Windows、Linux和macOS require("wasm_nvim_dl").download("windows") -- 将"windows"替换为"linux"或"macos"以适应相应的操作系统。 -- 加载wasm_nvim local wasm = require("wasm_nvim") -- 下一行扫描并将.wasm文件加载到空间中 -- 应该只调用一次,最好在init.lua中 wasm.setup { --debug = true -- 取消注释以查看打印的调试信息,适用于调试问题。 } -- 这里的tests是一个wasm文件,./wasm文件夹中的test.wasm -- 位于neovim运行时路径中。 -- luaExecExample是test.wasm模块暴露的函数示例。 wasm.tests.luaExecExample();

从源代码构建

cargo make build

然后将/target/release/中的共享库(.so或.dll)移动到neovim运行时路径的./lua文件夹中以使用它。

要求:

- Cargo Make

cargo install cargo-make

模块要求

-

一个名为

functionality的函数,需要暴露/导出,以便可以从wasm_nvim库调用。该函数返回一个JSON,定义了导出的函数、它们接受的参数以及返回值。示例:

export fn functionality() u32 { var functions = ArrayList(Functionality).init(aloc); _ = functions.append(CreateFunctionality("hi", "void", "void")) catch undefined; var stringified = ArrayList(u8).init(aloc); json.stringify(functions.items, .{}, stringified.writer()) catch undefined; var unmanaged = stringified.moveToUnmanaged(); // 获取用于设置值的ID const id = get_id(); const addr = get_addr(&unmanaged.items[0]); //设置要作为此函数返回类型使用的值 set_value(id, addr, unmanaged.items.len); return id; }它返回一个ID,映射到由

set_value()函数创建的JSON,该JSON指向一个定义模块导出的函数和参数的JSON字符串。在这种情况下,JSON看起来像这样:[{"name":"hi", "params": "void", "returns": "void"}]-

Params字段:可以是

"void"或其他任何内��容,实际上并不重要。当为"void"时,表示由"name"标记的函数不消耗/接受任何参数。 -

Returns字段:与Params字段情况相同,除"void"以外的任何内容都表示函数返回某些内容,否则返回void。

当wasm模块导出函数时,这些字段是必要的,以便可能调用它们的Lua端能够在函数返回值时获取值,或在函数期望某些值时传递值。

-

使用自定义接口实现Neovim API以获得更多wasm性能

这部分存在的原因是,我们目前无法直接与需要Lua函数作为引用或回调参数的Neovim API交互,因此用户可能需要将他们的wasm回调包装到Lua函数中,并从那一侧作为解决方案调用neovim api。

注意:如果你遇到需要Lua函数或回调作为参数的neovim api,请向./API.MD文件提交PR,将其添加到列表中,或者你也可以创建一个issue。

Wasm_Nvim暴露的可被模块使用的有用函数

以下示例使用zig

-

extern "host" get_id() u32;获取一个唯一的

id,用于在wasm模块和外部世界之间共享数据。 -

extern "host" get_addr(*u8) u32;从主机获取模块内存中的地址

-

extern "host" get_value_addr(id: u32) [*]u8;用于获取从模块外部世界创建的值的位置。这里指向的值由模块管理和释放。 注意:一旦调用,该值就会从外部世界的内存中清除,确保在调用

get_value_size之前调用此函数,以便在调用此函数之前知道长度 -

extern "host" get_value_size(id: u32) u32;给定一个值的id,它返回位于给定id的值的大小。应该在

get_value_addr之前调用,因为那会从内存中清除id。 -

extern "host" set_value(id: u32, loc: u32, size: u32) void;用于从wasm模块返回/设置值到

wasm_nvim库或外部世界。使用此方法的用户应确保放弃指针所指向的任何内容的内存控制权。 -

extern "host" lua_exec(id: u32) void;执行通过

get_id和set_value组合创建并传递给主机的Lua脚本字符串,然后将字符串的id传递给此函数执行。注意:在某些neovim版本(例如Windows上的0.9.1)上,这会将加载的字符串打印到输出。

-

extern "host"lua_eval(id: u32) u32;类似于

lua_exec,但这个函数评估表达式并返回映射到id的值。如果评估的表达式没有返回任何内容,返回的值将显示为"null",否则该值将包含结果的内容。注意:这是用于表达式的,传递给此函数的任何其他内容可能导致未定义的行为

教程

编辑推荐精选

GPT Plus|Pro充值

GPT充值

支持 ChatGPT Plus / Pro 充值服务,支付便捷,自动发货,售后可查。

GPT Image 2中文站

AI 图片生成平台

GPT Image 2 是面向用户的 AI 图片生成平台,支持文生图、图生图及多模型创意工作流。

Vecbase

你的AI Agent团队

Vecbase 是专为 AI 团队打造的智能工作空间,将数据管理、模型协作与知识沉淀整合于一处。算法、产品与业务在同一平台无缝协同,让从数据到 AI 应用的落地更快一步。

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

QoderWork

阿里Qoder团队推出的桌面端AI智能体

QoderWork 是阿里推出的本地优先桌面 AI 智能体,适配 macOS14+/Windows10+,以自然语言交互实现文件管理、数据分析、AI 视觉生成、浏览器自动化等办公任务,自主拆解执行复杂工作流,数据本地运行零上传,技能市场可无限扩展,是高效的 Agentic 生产力办公助手。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中�国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号