T-Eval: 评估大型语言模型工具使用能力的创新方法

T-Eval: 解构大型语言模型的工具使用能力

在人工智能领域,大型语言模型(LLM)的发展一直备受关注。这些模型在各种自然语言处理任务中展现出惊人的性能,并通过工具的辅助进一步拓展了应用范围。然而,如何有效评估和分析LLM的工具使用能力一直是一个有待深入探索的问题。针对这一挑战,研究人员提出了一种创新的评估框架——T-Eval,旨在逐步评估大型语言模型的工具使用能力。

T-Eval的创新之处

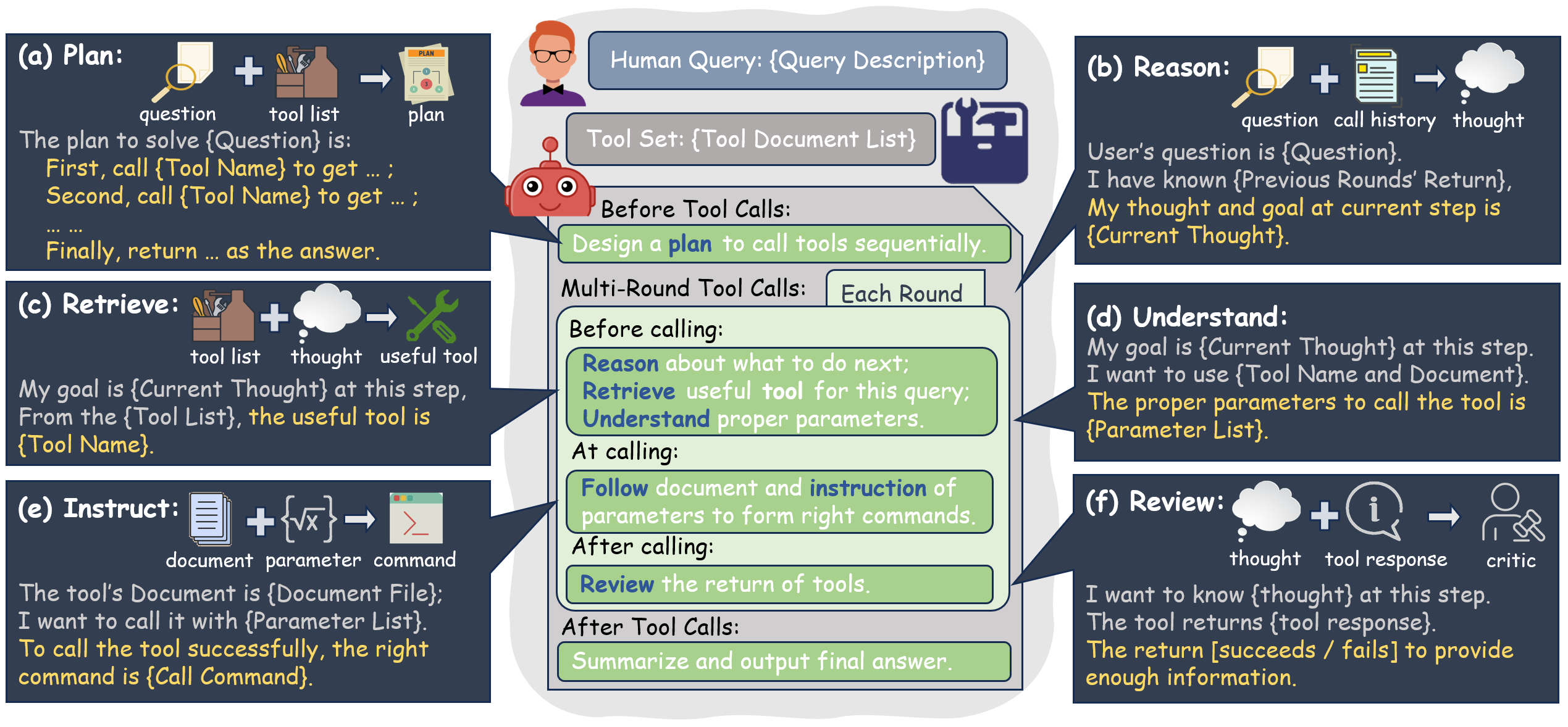

T-Eval的独特之处在于其全面而细致的评估方法。与以往整体评估模型的方法不同,T-Eval将工具使用过程分解为多个子过程,包括指令遵循、规划、推理、检索、理解和审查。这种分解方法使得研究者能够更深入地理解LLM在工具使用各个环节的表现。

通过这种细粒度的评估,T-Eval不仅能够评估模型的整体能力,还能够分析模型在各个子能力上的表现。这为我们提供了一个新的视角,可以更全面地了解LLM的工具使用能力。

T-Eval的实施过程

T-Eval的评估过程采用多轮对话的方式进行。评估者会向模型提供一系列指令和任务,模型需要调用相应的API或工具来完成这些任务。评估过程中,系统会记录模型的每一步操作,包括指令理解、工具选择、参数设置等。

例如,在一个典型的评估场景中,系统可能会要求模型使用Airbnb的搜索API来查找特定城市的房源信息。模型需要正确理解指令,选择合适的API,设置正确的参数,并解释返回的结果。

[ { "role": "system", "content": "You have access to the following API:\n{'name': 'AirbnbSearch.search_property_by_place', 'description': 'This function takes various parameters to search properties on Airbnb.', 'required_parameters': [{'name': 'place', 'type': 'STRING', 'description': 'The name of the destination.'}], 'optional_parameters': [], 'return_data': [{'name': 'property', 'description': 'a list of at most 3 properties, containing id, name, and address.'}]} Please generate the response in the following format:\ngoal: goal to call this action\n\nname: api name to call\n\nargs: JSON format api args in ONLY one line\n" }, { "role": "user", "content": "Call the function AirbnbSearch.search_property_by_place with the parameter as follows: 'place' is 'Berlin'." } ]

这种评估方法不仅测试了模型的基本语言理解能力,还评估了其使用工具的实际操作能力。

T-Eval的技术实现

T-Eval的实现依赖于Lagent和OpenCompass这两个开源工具。研究团队提供了详细的使用说明,包括如何设置环境、准备测试数据、运行评估脚本等。

T-Eval支持对API-based模型和HuggingFace模型进行评估。对于API-based模型,用户需要设置相应的API密钥;对于HuggingFace模型,则需要下载模型到本地并进行相应的配置。

T-Eval的应用价值

T-Eval的提出为LLM的评估带来了新的可能性。它不仅提供了一个标准化的评估框架,还为研究人员和开发者提供了深入分析模型能力的工具。通过T-Eval,我们可以:

- 更精确地定位模型在工具使用过程中的优势和不足

- 为模型的改进提供具体方向

- 比较不同模型在各个子能力上的表现差异

- 为LLM的实际应用场景提供更可靠的性能评估

T-Eval的最新进展

T-Eval项目一直在不断更新和完善。最近的一些重要更新包括:

- 2024年2月22日:发布了新的数据集和1/5子集(包含中英文版本),并优化了推理速度。

- 2024年1月8日:发布了中文评测数据集和榜单。

- 2023年12月22日:相关论文在ArXiv上发布。

这些更新表明T-Eval正在不断扩展其应用范围,并努力提高其评估效率和准确性。

参与T-Eval项目

T-Eval是一个开源项目,欢迎研究者和开发者参与贡献。项目团队提供了详细的使用说明和代码示例,使得参与者可以快速上手。同时,项目还设立了官方排行榜,鼓励研究者提交自己的评估结果,促进了整个领域的交流和进步。

如果您对T-Eval项目感兴趣,可以通过以下方式参与:

- 访问GitHub仓库了解详情

- 下载并使用T-Eval评估您的模型

- 提交评估结果到官方排行榜

- 为项目贡献代码或提出改进建议

结语

T-Eval的出现为大型语言模型的评估带来了新的视角和方法。通过将工具使用能力分解为多个子过程,T-Eval提供了一种更加细致和全面的评估方法。这不仅有助于我们更好地理解LLM的能力,也为未来LLM的改进和应用提供了重要指导。

随着人工智能技术的不断发展,像T-Eval这样的评估工具将在推动LLM技术进步中发挥越来越重要的作用。我们期待看到T-Eval在未来能够产生更广泛的影响,为LLM的研究和应用带来更多创新。

编辑推荐精选

GPT Image 2中文站

AI 图片生成平台

GPT Image 2 是面向用户的 AI 图片生成平台,支持文生图、图生图及多模型创意工作流。

Nano Banana Pro 中文站

AI 图片生成工具

输入简单文字,生成想要的图片。支持Nano Banana/gptimage-2等最新模型。

Vecbase

你的AI Agent团队

Vecbase 是专为 AI 团队打造的智能工作空间,将数据管理、模型协作与知识沉淀整合于一处。算法、产品与业务在同一平台无缝协同,让从数据到 AI 应用的落地更快一步。

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

QoderWork

阿里Qoder团队推出的桌面端AI智能体

QoderWork 是阿里推出的本地优先桌面 AI 智能体,适配 macOS14+/Windows10+,以自然语言交互实现文件管理、数据分析、AI 视觉生成、浏览器自动化等��办公任务,自主拆解执行复杂工作流,数据本地运行零上传,技能市场可无限扩展,是高效的 Agentic 生产力办公助手。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号