LoRA和DoRA:从零开始实现低秩适应技术

LoRA和DoRA:从零开始实现低秩适应技术

在深度学习领域,如何高效地微调大型预训练模型一直是一个热门话题。近年来,低秩适应(Low-Rank Adaptation, LoRA)技术因其出色的参数效率和微调性能而备受关注。最近,研究人员又提出了DoRA(Weight-Decomposed Low-Rank Adaptation)技术,进一步改进了LoRA的性能。本文将深入探讨LoRA和DoRA这两种先进的模型微调方法,并提供从零开始的PyTorch实现代码,帮助读者全面理解这些技术的原理和应用。

LoRA技术简介

LoRA是一种用于高效微调大型预训练模型的技术,特别适用于大型语言模型(LLM)和视觉Transformer等模型。其核心思想是:在微调过程中,不直接更新原始的大型权重矩阵,而是学习一个低秩的更新矩阵。这种方法大大减少了需要更新的参数数量,从而降低了计算成本和内存需求。

具体来说,LoRA的工作原理如下:

- 对于原始的权重矩阵W,LoRA引入两个小的矩阵A和B。

- 更新后的权重矩阵表示为:W' = W + AB

- 矩阵A和B的维度远小于W,因此参数量大大减少。

例如,如果W是一个1000x1000的矩阵,传统微调需要更新100万个参数。而使用LoRA,如果选择秩为2,那么A是1000x2的矩阵,B是2x1000的矩阵,总共只需要更新4000个参数,减少了250倍。

LoRA的PyTorch实现

下面我们来看看如何用PyTorch从零实现LoRA层:

import torch.nn as nn class LoRALayer(nn.Module): def __init__(self, in_dim, out_dim, rank, alpha): super().__init__() std_dev = 1 / torch.sqrt(torch.tensor(rank).float()) self.A = nn.Parameter(torch.randn(in_dim, rank) * std_dev) self.B = nn.Parameter(torch.zeros(rank, out_dim)) self.alpha = alpha def forward(self, x): x = self.alpha * (x @ self.A @ self.B) return x class LinearWithLoRA(nn.Module): def __init__(self, linear, rank, alpha): super().__init__() self.linear = linear self.lora = LoRALayer( linear.in_features, linear.out_features, rank, alpha ) def forward(self, x): return self.linear(x) + self.lora(x)

这里的LoRALayer实现了LoRA的核心功能,而LinearWithLoRA则将LoRA应用到现有的线性层上。

DoRA:LoRA的进阶版本

DoRA(Weight-Decomposed Low-Rank Adaptation)是对LoRA的一种改进。DoRA的核心思想是将预训练权重矩阵分解为幅度向量和方向矩阵,然后仅对方向矩阵应用LoRA更新,同时单独训练幅度向量。

DoRA的工作流程如下:

- 将预训练权重矩阵W分解为幅度向量m和方向矩阵V。

- 对方向矩阵V应用LoRA更新。

- 在训练过程中同时更�新幅度向量m。

DoRA的优势在于:

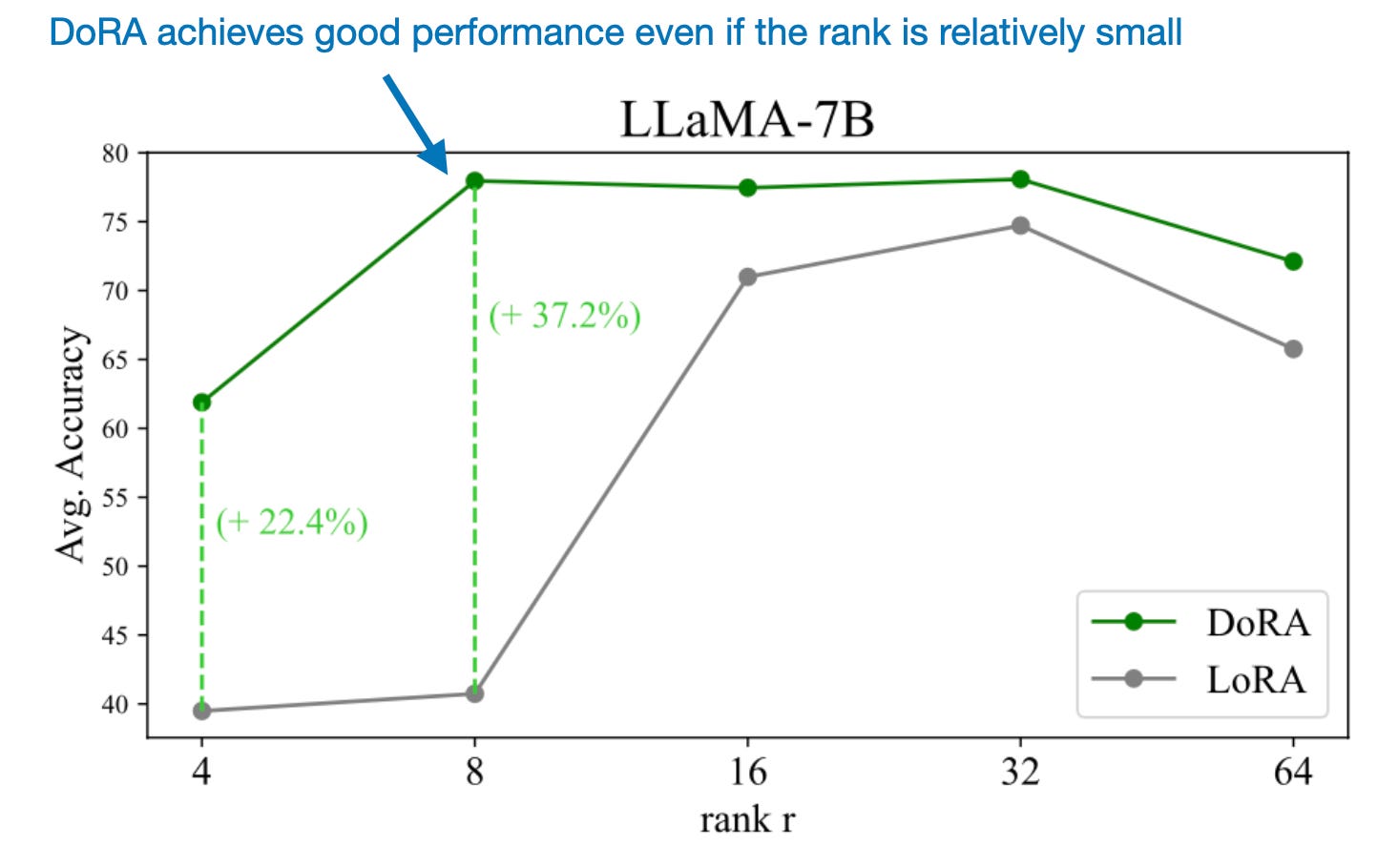

- 性能提升:在多项基准测试中,DoRA的表现优于LoRA。

- 参数效率:即使DoRA的秩减半,其性能仍然可以超过LoRA。

- 对秩参数不敏感:DoRA对秩的选择更加鲁棒,减少了超参数调优的工作量。

DoRA的PyTorch实现

下面是DoRA的PyTorch实现代码:

class LinearWithDoRAMerged(nn.Module): def __init__(self, linear, rank, alpha): super().__init__() self.linear = linear self.lora = LoRALayer( linear.in_features, linear.out_features, rank, alpha ) self.m = nn.Parameter( self.linear.weight.norm(p=2, dim=0, keepdim=True)) def forward(self, x): lora = self.lora.A @ self.lora.B numerator = self.linear.weight + self.lora.alpha*lora.T denominator = numerator.norm(p=2, dim=0, keepdim=True) directional_component = numerator / denominator new_weight = self.m * directional_component return F.linear(x, new_weight, self.linear.bias)

这个实现中,我们首先计算LoRA更新,然后将其应用到原始权重上。接着,我们对更新后的权重进行归一化,得到方向矩阵。最后,我们将方向矩阵与可学习的幅度向量相乘,得到最终的权重矩阵。

实际应用

在实际应用中,我们可以轻松地将现有神经网络中的线性层替换为DoRA层:

model.layers[0] = LinearWithDoRAMerged(model.layers[0], rank=4, alpha=8) model.layers[2] = LinearWithDoRAMerged(model.layers[2], rank=4, alpha=8) model.layers[4] = LinearWithDoRAMerged(model.layers[4], rank=4, alpha=8)

然后,我们可以冻结原始线性层的权重,只训练DoRA层的参数:

def freeze_linear_layers(model): for child in model.children(): if isinstance(child, nn.Linear): for param in child.parameters(): param.requires_grad = False else: freeze_linear_layers(child) freeze_linear_layers(model)

结论

LoRA和DoRA这两种低秩适应技术为大型预训练模型的高效微调提供了强大的工具。它们不仅大大减少了需要更新的参数数量,还在多项任务中展现出优秀的性能。特别是DoRA,通过将权重分解为幅度和方向两个组件,进一步提高了模型的适应能力和参数效率。

这些技术的出现和发展,为AI研究人员和工程师提供了新的可能性,使得在有限的计算资源下微调和部署大型模型变得更加可行。随着这些方法的不断完善和应用,我们可以期待看到更多高效、灵活的AI模型在各个领域发挥作用。

对于那些希望深入了解和实践这些技术的读者,本文提供的PyTorch实现代码可以作为很好的起点。通过亲自动手实现和实验,你将能更好地理解这些方法的工作原理,并在自己的项目中灵活运用��。

参考资源

- LoRA论文: LORA: LOW-RANK ADAPTATION OF LARGE LANGUAGE MODELS

- DoRA论文: DoRA: Weight-Decomposed Low-Rank Adaptation

- GitHub项目: rasbt/dora-from-scratch

通过本文的介绍和代码实现,相信读者已经对LoRA和DoRA这两种先进的模型微调技术有了深入的理解。这些方法不仅在理论上很有趣,在实际应用中也展现出了巨大的潜力。随着深度学习技术的不断发展,我们期待看到更多创新的模型微调方法涌现,进一步推动AI领域的进步。

编辑推荐精选

音述AI

全球首个AI音乐社区

音述AI是全球首个AI音乐社区,致力让每个人都能用音乐表达自我。音述AI提供零门槛AI创作工具,独创GETI法则帮助用户精准定义音乐风格,AI润色功能支持自动优化作品质感。音述AI支持交流讨论、二次创作与价值变现。针对中文用户的语言习惯与文化背景进行专门优化,支持国风融合、C-pop等本土音乐标签,让技术更好地承载人文表达。

QoderWork

阿里Qoder团队推出的桌面端AI智能体

QoderWork 是阿里推出的本地优先桌面 AI 智能体,适配 macOS14+/Windows10+,以自然语言交互实现文件管理、数据分析�、AI 视觉生成、浏览器自动化等办公任务,自主拆解执行复杂工作流,数据本地运行零上传,技能市场可无限扩展,是高效的 Agentic 生产力办公助手。

lynote.ai

一站式搞定所有学习需求

不再被海量信息淹没,开始真正理解知识。Lynote 可摘要 YouTube 视频、PDF、文章等内容。即时创建笔记,检测 AI 内容并下载资料,将您的学习效率提升 10 倍。

AniShort

为AI短剧协作而生

专为AI短剧协作而生的AniShort正式发布,深度重构AI短剧全流程生产模式,整合创意策划、制作执行、实时协作、在线审片、资产复用等全链路功能,独创无限画布、双轨并行工业化工作流与Ani智能体助手,集成多款主流AI大模型,破解素材零散、版本混乱、沟通低效等行业痛点,助力3人团队效率提升800%,打造标准化、可追溯的AI短剧量产体系,是AI短剧团队协同创作、提升制作效率的核心工具。

seedancetwo2.0

能听懂你表达的视频模型

Seedance two是基于seedance2.0的中国大模型,支持图像、视频、音频、文本四种模态输入,表达方式更丰富,生成也更可控。

nano-banana纳米香蕉中文站

国内直接访问,限时3折

输入简单文字,生成想要的图片,纳米香蕉中文站基于 Google 模型的 AI 图片生成网站,支持文字生图、图生图。官网价格限时3折活动

扣子-AI办公

职场AI,就用扣子

AI办公助手,复杂任务高效处理。办公效率低?扣子空间AI助手支持播客生成、PPT制作、网页开发及报告写作,覆盖科研、商业、舆情等领域的专家Agent 7x24小时响应,生活工作无缝切换,提升50%效率!

堆友

多风格AI绘画神器

堆友平台由阿里巴巴设计团队创建,作为一款AI驱动的设计工具,专为设计师提供一站式增长服务。功能覆盖海量3D素材、AI绘画、实时渲染以及专业抠图,显著提升设计品质和效率。平台不仅提供工具,还是一个促进创意交流和个人发展的空间,界面友好,适合所有级别的设计师和创意工作者。

码上飞

零代码AI应用开发平台

零代码AI应用开发平台,用户只需一句话简单描述需求,AI能自动生成小程序、APP或H5网页应用,无需编写代码。

Vora

免费创建高清无水印Sora视频

Vora是一个免费创建高清无水印Sora视频的AI工具

推荐工具精选

AI云服务特惠

懂AI专属折扣关注微信公众号

最新AI工具、AI资讯

独家AI资源、AI项目落地

微信扫一扫关注公众号